精确率-召回率#

精确率-召回率指标的示例,用于评估分类器输出质量。

当类别非常不平衡时,精确率-召回率是衡量预测成功率的有用指标。在信息检索中,精确率是衡量结果相关性的指标,而召回率是衡量返回了多少真正相关结果的指标。

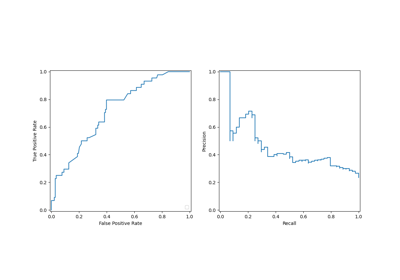

精确率-召回率曲线显示了不同阈值下精确率和召回率之间的权衡。曲线下的面积越大,表示召回率和精确率都越高,其中高精确率对应于低假阳性率,高召回率对应于低假阴性率。两个指标得分都高表明分类器返回了准确的结果(高精确率),并且返回了大多数正结果(高召回率)。

召回率高但精确率低的系统会返回许多结果,但与训练标签相比,其预测标签中的大多数都是错误的。精确率高但召回率低的系统则相反,只返回很少的结果,但与训练标签相比,其预测标签中的大多数都是正确的。一个理想的系统,既有高精确率又有高召回率,会返回许多结果,并且所有结果都被正确标记。

精确率 (\(P\)) 定义为真阳性数 (\(T_p\)) 除以真阳性数加上假阳性数 (\(F_p\))。

\(P = \frac{T_p}{T_p+F_p}\)

召回率 (\(R\)) 定义为真阳性数 (\(T_p\)) 除以真阳性数加上假阴性数 (\(F_n\))。

\(R = \frac{T_p}{T_p + F_n}\)

这些量也与 \(F_1\) 分数相关,它是精确率和召回率的调和平均数。因此,我们可以使用以下公式计算 \(F_1\)

\(F_1 = \frac{2T_p}{2T_p + F_p + F_n}\)

请注意,精确率不会随着召回率的降低而降低。精确率的定义 (\(\frac{T_p}{T_p + F_p}\)) 表明,降低分类器的阈值可能会增加分母,因为返回的结果数量会增加。如果之前的阈值设置过高,则新的结果可能都是真阳性,这将提高精确率。如果之前的阈值恰到好处或过低,则进一步降低阈值将引入假阳性,从而降低精确率。

召回率定义为 \(\frac{T_p}{T_p+F_n}\),其中 \(T_p+F_n\) 不依赖于分类器阈值。这意味着降低分类器阈值可能会通过增加真阳性结果的数量来提高召回率。降低阈值也可能使召回率保持不变,而精确率发生波动。

在图中的阶梯区域可以观察到召回率和精确率之间的关系 - 在这些阶梯的边缘,阈值发生微小变化会大大降低精确率,而召回率只略有提高。

平均精确率 (AP) 将此类图总结为在每个阈值下达成的精确率的加权平均值,其中从前一个阈值开始的召回率增加用作权重

\(\text{AP} = \sum_n (R_n - R_{n-1}) P_n\)

其中 \(P_n\) 和 \(R_n\) 是第 n 个阈值下的精确率和召回率。一对 \((R_k, P_k)\) 被称为工作点。

AP 和工作点下的梯形面积 (sklearn.metrics.auc) 是总结精确率-召回率曲线的两种常用方法,它们会导致不同的结果。在 用户指南 中了解更多信息。

精确率-召回率曲线通常用于二元分类,以研究分类器的输出。为了将精确率-召回率曲线和平均精确率扩展到多类或多标签分类,有必要对输出进行二值化。每个标签可以绘制一条曲线,但也可以通过将标签指示矩阵的每个元素视为二元预测来绘制精确率-召回率曲线(微平均)。

注意

在二元分类设置中#

数据集和模型#

我们将使用线性 SVC 分类器来区分两种类型的鸢尾花。

import numpy as np

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

X, y = load_iris(return_X_y=True)

# Add noisy features

random_state = np.random.RandomState(0)

n_samples, n_features = X.shape

X = np.concatenate([X, random_state.randn(n_samples, 200 * n_features)], axis=1)

# Limit to the two first classes, and split into training and test

X_train, X_test, y_train, y_test = train_test_split(

X[y < 2], y[y < 2], test_size=0.5, random_state=random_state

)

线性 SVC 期望每个特征具有相似的取值范围。因此,我们将首先使用 StandardScaler 对数据进行缩放。

from sklearn.pipeline import make_pipeline

from sklearn.preprocessing import StandardScaler

from sklearn.svm import LinearSVC

classifier = make_pipeline(StandardScaler(), LinearSVC(random_state=random_state))

classifier.fit(X_train, y_train)

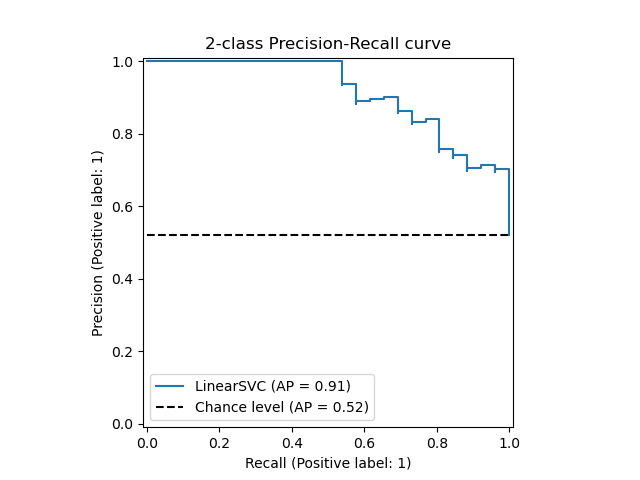

绘制精确率-召回率曲线#

要绘制精确率-召回率曲线,您应该使用 PrecisionRecallDisplay。实际上,根据您是否已经计算了分类器的预测,有两种方法可用。

首先,让我们在没有分类器预测的情况下绘制精确率-召回率曲线。我们使用 from_estimator,它会在绘制曲线之前为我们计算预测。

from sklearn.metrics import PrecisionRecallDisplay

display = PrecisionRecallDisplay.from_estimator(

classifier, X_test, y_test, name="LinearSVC", plot_chance_level=True

)

_ = display.ax_.set_title("2-class Precision-Recall curve")

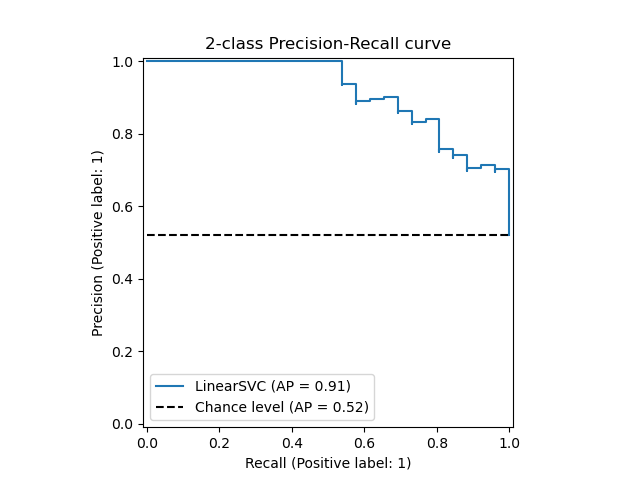

如果我们已经获得了模型的估计概率或分数,那么我们可以使用 from_predictions。

y_score = classifier.decision_function(X_test)

display = PrecisionRecallDisplay.from_predictions(

y_test, y_score, name="LinearSVC", plot_chance_level=True

)

_ = display.ax_.set_title("2-class Precision-Recall curve")

在多标签设置中#

精确率-召回率曲线不支持多标签设置。但是,可以决定如何处理这种情况。我们在下面展示了一个这样的例子。

创建多标签数据,拟合和预测#

我们创建了一个多标签数据集,以说明多标签设置中的精确率-召回率。

from sklearn.preprocessing import label_binarize

# Use label_binarize to be multi-label like settings

Y = label_binarize(y, classes=[0, 1, 2])

n_classes = Y.shape[1]

# Split into training and test

X_train, X_test, Y_train, Y_test = train_test_split(

X, Y, test_size=0.5, random_state=random_state

)

我们使用 OneVsRestClassifier 进行多标签预测。

from sklearn.multiclass import OneVsRestClassifier

classifier = OneVsRestClassifier(

make_pipeline(StandardScaler(), LinearSVC(random_state=random_state))

)

classifier.fit(X_train, Y_train)

y_score = classifier.decision_function(X_test)

多标签设置中的平均精确率得分#

from sklearn.metrics import average_precision_score, precision_recall_curve

# For each class

precision = dict()

recall = dict()

average_precision = dict()

for i in range(n_classes):

precision[i], recall[i], _ = precision_recall_curve(Y_test[:, i], y_score[:, i])

average_precision[i] = average_precision_score(Y_test[:, i], y_score[:, i])

# A "micro-average": quantifying score on all classes jointly

precision["micro"], recall["micro"], _ = precision_recall_curve(

Y_test.ravel(), y_score.ravel()

)

average_precision["micro"] = average_precision_score(Y_test, y_score, average="micro")

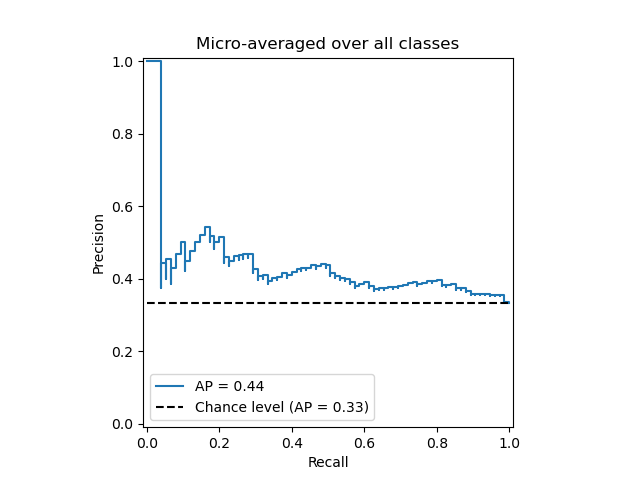

绘制微平均精确率-召回率曲线#

from collections import Counter

display = PrecisionRecallDisplay(

recall=recall["micro"],

precision=precision["micro"],

average_precision=average_precision["micro"],

prevalence_pos_label=Counter(Y_test.ravel())[1] / Y_test.size,

)

display.plot(plot_chance_level=True)

_ = display.ax_.set_title("Micro-averaged over all classes")

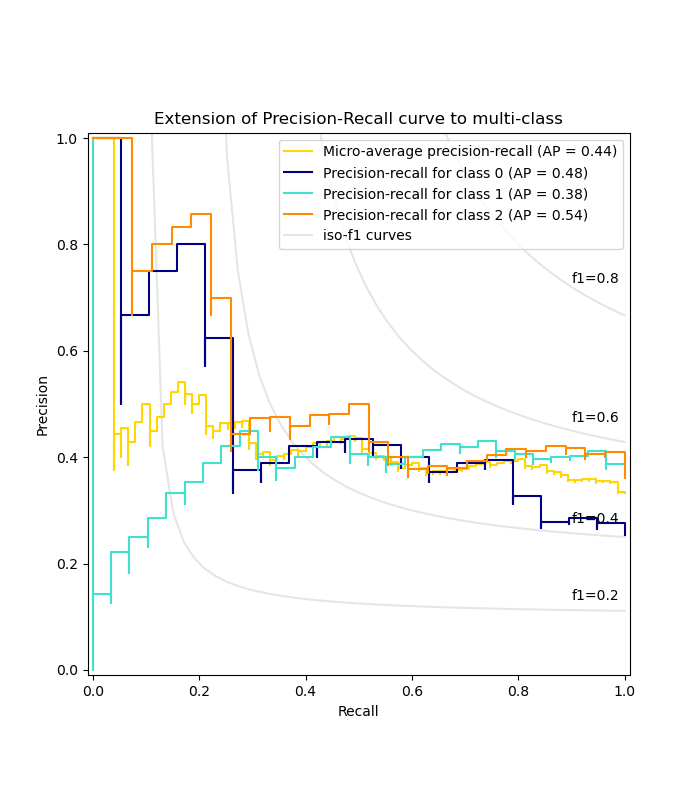

绘制每个类别的精确率-召回率曲线和等 F1 曲线#

from itertools import cycle

import matplotlib.pyplot as plt

# setup plot details

colors = cycle(["navy", "turquoise", "darkorange", "cornflowerblue", "teal"])

_, ax = plt.subplots(figsize=(7, 8))

f_scores = np.linspace(0.2, 0.8, num=4)

lines, labels = [], []

for f_score in f_scores:

x = np.linspace(0.01, 1)

y = f_score * x / (2 * x - f_score)

(l,) = plt.plot(x[y >= 0], y[y >= 0], color="gray", alpha=0.2)

plt.annotate("f1={0:0.1f}".format(f_score), xy=(0.9, y[45] + 0.02))

display = PrecisionRecallDisplay(

recall=recall["micro"],

precision=precision["micro"],

average_precision=average_precision["micro"],

)

display.plot(ax=ax, name="Micro-average precision-recall", color="gold")

for i, color in zip(range(n_classes), colors):

display = PrecisionRecallDisplay(

recall=recall[i],

precision=precision[i],

average_precision=average_precision[i],

)

display.plot(ax=ax, name=f"Precision-recall for class {i}", color=color)

# add the legend for the iso-f1 curves

handles, labels = display.ax_.get_legend_handles_labels()

handles.extend([l])

labels.extend(["iso-f1 curves"])

# set the legend and the axes

ax.legend(handles=handles, labels=labels, loc="best")

ax.set_title("Extension of Precision-Recall curve to multi-class")

plt.show()

脚本的总运行时间:(0 分钟 0.384 秒)

相关示例