3.2. 调整估计器的超参数#

超参数是估计器中不直接学习的参数。在 scikit-learn 中,它们作为参数传递给估计器类的构造函数。典型例子包括支持向量分类器 (Support Vector Classifier) 的 C、kernel 和 gamma,Lasso 的 alpha 等。

可以并且建议在超参数空间中搜索最佳的交叉验证分数。

在构造估计器时提供的任何参数都可以通过这种方式进行优化。具体来说,要查找给定估计器的所有参数的名称和当前值,请使用

estimator.get_params()

搜索包含

一个估计器(回归器或分类器,例如

sklearn.svm.SVC());一个参数空间;

一种搜索或抽样候选的方法;

一个交叉验证方案;以及

一个评分函数。

scikit-learn 提供了两种通用的参数搜索方法:对于给定值,GridSearchCV 穷尽地考虑所有参数组合,而 RandomizedSearchCV 可以从具有指定分布的参数空间中抽样给定数量的候选。这两种工具都有其连续减半 (successive halving) 的对应实现,即 HalvingGridSearchCV 和 HalvingRandomSearchCV,它们在寻找好的参数组合方面可能快得多。

在描述了这些工具之后,我们将详细介绍适用于这些方法的最佳实践。某些模型允许采用专门、高效的参数搜索策略,具体内容在暴力参数搜索的替代方案中概述。

请注意,通常只有一小部分参数会对模型的预测或计算性能产生较大影响,而其他参数可以保留其默认值。建议阅读估计器类的文档字符串,以更深入地了解它们的预期行为,也可以通过阅读所附的参考文献来了解。

3.2.1. 穷尽网格搜索#

GridSearchCV 提供的网格搜索通过 param_grid 参数指定的参数值网格穷尽地生成候选。例如,以下 param_grid

param_grid = [

{'C': [1, 10, 100, 1000], 'kernel': ['linear']},

{'C': [1, 10, 100, 1000], 'gamma': [0.001, 0.0001], 'kernel': ['rbf']},

]

指定应探索两个网格:一个使用线性核,C 值为 [1, 10, 100, 1000];另一个使用 RBF 核,C 值为 [1, 10, 100, 1000] 与 gamma 值为 [0.001, 0.0001] 的笛卡尔积。

GridSearchCV 实例实现了常规的估计器 API:当在数据集上“拟合”它时,所有可能的参数值组合都会被评估,并保留最佳组合。

示例

有关在 iris 数据集上进行交叉验证循环中的网格搜索示例,请参阅嵌套式与非嵌套式交叉验证。这是使用网格搜索评估模型性能的最佳实践。

有关将文本特征提取器(n-gram 计数向量化器和 TF-IDF 转换器)的参数与分类器(此处为使用 SGD 训练的线性 SVM,带有弹性网络或 L2 惩罚)耦合的网格搜索示例,请参阅文本特征提取和评估的示例流水线,该示例使用了

Pipeline实例。

高级示例#

有关在 iris 数据集上进行交叉验证循环中的网格搜索示例,请参阅嵌套式与非嵌套式交叉验证。这是使用网格搜索评估模型性能的最佳实践。

有关同时评估多个指标时使用

GridSearchCV的示例,请参阅cross_val_score 和 GridSearchCV 上的多指标评估演示。有关在

GridSearchCV中使用refit=callable接口的示例,请参阅平衡模型复杂度与交叉验证分数。该示例展示了此接口如何在识别“最佳”估计器时增加一定的灵活性。此接口也可以用于多指标评估。有关如何对

GridSearchCV的输出进行统计比较的示例,请参阅使用网格搜索进行模型的统计比较。

3.2.2. 随机参数优化#

虽然使用参数设置网格是当前最广泛使用的参数优化方法,但其他搜索方法具有更有利的特性。RandomizedSearchCV 实现了对参数的随机搜索,其中每个设置都是从可能的参数值分布中抽样的。与穷尽搜索相比,这具有两个主要优点:

预算的选择可以独立于参数数量和可能值。

添加不影响性能的参数不会降低效率。

参数的抽样方式通过字典指定,这与为 GridSearchCV 指定参数非常相似。此外,计算预算(即抽样候选数量或抽样迭代次数)通过 n_iter 参数指定。对于每个参数,可以指定一个可能的取值分布,或者一个离散选择列表(将进行均匀抽样)。

{'C': scipy.stats.expon(scale=100), 'gamma': scipy.stats.expon(scale=.1),

'kernel': ['rbf'], 'class_weight':['balanced', None]}

此示例使用 scipy.stats 模块,其中包含许多用于参数抽样的有用分布,例如 expon、gamma、uniform、loguniform 或 randint。

原则上,可以传入任何提供 rvs(随机变量样本)方法以抽样值的函数。对 rvs 函数的连续调用应提供来自可能参数值的独立随机样本。

警告

在 scipy 0.16 版本之前,scipy.stats 中的分布不允许指定随机状态。相反,它们使用全局 numpy 随机状态,该状态可以通过 np.random.seed 设置种子或使用 np.random.set_state 设置。然而,从 scikit-learn 0.18 开始,如果 scipy >= 0.16 也可用,sklearn.model_selection 模块会设置用户提供的随机状态。

对于连续参数,例如上述的 C,指定一个连续分布以充分利用随机化非常重要。这样,增加 n_iter 将始终导致更精细的搜索。

连续对数均匀随机变量是按对数间隔参数的连续版本。例如,要指定与上述 C 等效的值,可以使用 loguniform(1, 100) 而不是 [1, 10, 100]。

与网格搜索中的上述示例类似,我们可以指定一个在 1e0 和 1e3 之间对数均匀分布的连续随机变量。

from sklearn.utils.fixes import loguniform

{'C': loguniform(1e0, 1e3),

'gamma': loguniform(1e-4, 1e-3),

'kernel': ['rbf'],

'class_weight':['balanced', None]}

示例

比较超参数估计的随机搜索和网格搜索 比较了随机搜索和网格搜索的用法和效率。

参考文献

Bergstra, J. and Bengio, Y.,《超参数优化的随机搜索》,《机器学习研究杂志》(2012)

3.2.3. 使用连续减半搜索最优参数#

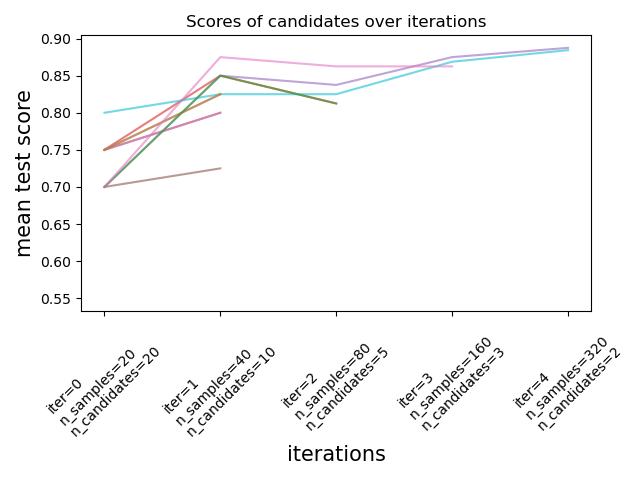

Scikit-learn 还提供了 HalvingGridSearchCV 和 HalvingRandomSearchCV 估计器,可用于通过连续减半 [1] [2] 搜索参数空间。连续减半 (SH) 类似于候选参数组合之间的锦标赛。SH 是一个迭代选择过程,其中所有候选(参数组合)在第一次迭代中用少量资源进行评估。只有其中一些候选会被选中进行下一次迭代,这些迭代将分配更多资源。对于参数调优,资源通常是训练样本的数量,但它也可以是任意的数值参数,例如随机森林中的 n_estimators。

注意

选择的资源增量应足够大,以便在考虑统计显著性时,分数能获得显著提升。

如下图所示,只有一小部分候选在最后一轮迭代中“幸存”下来。这些是在所有迭代中始终排名前列的候选。每次迭代都会为每个候选分配越来越多的资源,这里是样本数量。

我们在此简要描述主要参数,但每个参数及其相互作用将在下面的下拉部分中更详细地描述。factor(> 1)参数控制资源增长的速度,以及候选数量减少的速度。在每次迭代中,每个候选的资源数量乘以 factor,候选数量除以相同的因子。与 resource 和 min_resources 一起,factor 是我们实现中控制搜索最重要的参数,尽管值为 3 通常效果良好。factor 有效地控制了 HalvingGridSearchCV 中的迭代次数以及 HalvingRandomSearchCV 中的候选数量(默认)和迭代次数。如果可用资源数量较少,也可以使用 aggressive_elimination=True。通过调整 min_resources 参数可以获得更多控制。

这些估计器仍处于实验阶段:它们的预测及其 API 可能会在没有任何弃用周期的情况下发生变化。要使用它们,您需要显式导入 enable_halving_search_cv

>>> from sklearn.experimental import enable_halving_search_cv # noqa

>>> from sklearn.model_selection import HalvingGridSearchCV

>>> from sklearn.model_selection import HalvingRandomSearchCV

示例

以下部分将深入探讨连续减半的技术方面。

选择 min_resources 和候选数量#

除了 factor,影响连续减半搜索行为的两个主要参数是 min_resources 参数和被评估的候选数量(或参数组合)。min_resources 是在第一次迭代中为每个候选分配的资源量。候选数量直接在 HalvingRandomSearchCV 中指定,并由 HalvingGridSearchCV 的 param_grid 参数决定。

考虑资源是样本数量且我们有 1000 个样本的情况。理论上,在 min_resources=10 和 factor=2 的情况下,我们最多可以运行 7 次迭代,样本数量如下:[10, 20, 40, 80, 160, 320, 640]。

但根据候选数量,我们可能运行少于 7 次迭代:如果我们从少量候选开始,最后一次迭代可能使用的样本少于 640 个,这意味着没有使用所有可用资源(样本)。例如,如果我们从 5 个候选开始,我们只需要 2 次迭代:第一次迭代有 5 个候选,然后第二次迭代有 5 // 2 = 2 个候选,之后我们就能知道哪个候选表现最好(所以我们不需要第三次迭代)。我们最多只使用 20 个样本,这是一种浪费,因为我们有 1000 个样本可用。另一方面,如果我们从大量候选开始,最后一次迭代可能会剩下很多候选,这可能并不总是理想的:这意味着许多候选将使用全部资源运行,基本上将该过程简化为标准搜索。

对于 HalvingRandomSearchCV,候选数量默认设置为使最后一次迭代尽可能多地使用可用资源。对于 HalvingGridSearchCV,候选数量由 param_grid 参数决定。更改 min_resources 的值将影响可能的迭代次数,从而也会影响理想的候选数量。

选择 min_resources 时的另一个考虑是,用少量资源是否容易区分好坏候选。例如,如果您需要大量样本才能区分好坏参数,则建议使用较高的 min_resources。另一方面,如果即使使用少量样本也能清楚区分,那么较小的 min_resources 可能更可取,因为它可以加快计算速度。

请注意,在上面的示例中,最后一次迭代并未完全使用最大可用资源:尽管有 1000 个样本可用,但最多只使用了 640 个。默认情况下,HalvingRandomSearchCV 和 HalvingGridSearchCV 都尝试在最后一次迭代中使用尽可能多的资源,但受限于该资源量必须是 min_resources 和 factor 的倍数(此限制将在下一节中阐明)。HalvingRandomSearchCV 通过抽样适当数量的候选来实现此目标,而 HalvingGridSearchCV 通过正确设置 min_resources 来实现此目标。

每次迭代的资源量和候选数量#

在任何迭代 i 中,每个候选都会被分配一定量的资源,我们将其表示为 n_resources_i。这个数量由参数 factor 和 min_resources 控制,如下所示(factor 严格大于 1)

n_resources_i = factor**i * min_resources,

或等效地

n_resources_{i+1} = n_resources_i * factor

其中 min_resources == n_resources_0 是第一次迭代中使用的资源量。factor 还定义了将被选中进行下一次迭代的候选比例

n_candidates_i = n_candidates // (factor ** i)

或等效地

n_candidates_0 = n_candidates

n_candidates_{i+1} = n_candidates_i // factor

因此,在第一次迭代中,我们使用 min_resources 资源 n_candidates 次。在第二次迭代中,我们使用 min_resources * factor 资源 n_candidates // factor 次。第三次再次将每个候选的资源量相乘,并除以候选数量。当达到每个候选的最大资源量,或者我们已识别出最佳候选时,此过程停止。最佳候选在评估 factor 或更少候选的迭代中被识别(有关解释,请参见下文)。

以下是一个示例,其中 min_resources=3 和 factor=2,从 70 个候选开始

|

|

|---|---|

3 (=min_resources) |

70 (=n_candidates) |

3 * 2 = 6 |

70 // 2 = 35 |

6 * 2 = 12 |

35 // 2 = 17 |

12 * 2 = 24 |

17 // 2 = 8 |

24 * 2 = 48 |

8 // 2 = 4 |

48 * 2 = 96 |

4 // 2 = 2 |

我们可以注意到

该过程在评估

factor=2个候选的第一次迭代停止:最佳候选就是这 2 个候选中的最佳者。无需运行额外的迭代,因为它只会评估一个候选(即我们已经确定的最佳候选)。因此,通常情况下,我们希望最后一次迭代最多运行factor个候选。如果最后一次迭代评估的候选数量超过factor,那么这次迭代就会退化为常规搜索(如RandomizedSearchCV或GridSearchCV)。每个

n_resources_i都是factor和min_resources的倍数(这由其上述定义所证实)。

每次迭代使用的资源量可以在 n_resources_ 属性中找到。

选择资源#

默认情况下,资源是根据样本数量定义的。也就是说,每次迭代将使用越来越多的样本进行训练。但是,您可以使用 resource 参数手动指定一个参数作为资源。以下是一个示例,其中资源是根据随机森林的估计器数量定义的

>>> from sklearn.datasets import make_classification

>>> from sklearn.ensemble import RandomForestClassifier

>>> from sklearn.experimental import enable_halving_search_cv # noqa

>>> from sklearn.model_selection import HalvingGridSearchCV

>>> import pandas as pd

>>> param_grid = {'max_depth': [3, 5, 10],

... 'min_samples_split': [2, 5, 10]}

>>> base_estimator = RandomForestClassifier(random_state=0)

>>> X, y = make_classification(n_samples=1000, random_state=0)

>>> sh = HalvingGridSearchCV(base_estimator, param_grid, cv=5,

... factor=2, resource='n_estimators',

... max_resources=30).fit(X, y)

>>> sh.best_estimator_

RandomForestClassifier(max_depth=5, n_estimators=24, random_state=0)

请注意,不能对参数网格中的参数进行预算。

耗尽可用资源#

如上所述,每次迭代使用的资源数量取决于 min_resources 参数。如果您有大量可用资源但开始时使用的资源数量很少,则其中一些资源可能会被浪费(即未被使用)。

>>> from sklearn.datasets import make_classification

>>> from sklearn.svm import SVC

>>> from sklearn.experimental import enable_halving_search_cv # noqa

>>> from sklearn.model_selection import HalvingGridSearchCV

>>> import pandas as pd

>>> param_grid= {'kernel': ('linear', 'rbf'),

... 'C': [1, 10, 100]}

>>> base_estimator = SVC(gamma='scale')

>>> X, y = make_classification(n_samples=1000)

>>> sh = HalvingGridSearchCV(base_estimator, param_grid, cv=5,

... factor=2, min_resources=20).fit(X, y)

>>> sh.n_resources_

[20, 40, 80]

搜索过程最多只使用 80 个资源,而我们最大的可用资源量是 n_samples=1000。在这里,我们有 min_resources = r_0 = 20。

对于 HalvingGridSearchCV,min_resources 参数默认设置为 'exhaust'。这意味着 min_resources 会自动设置,以便在 max_resources 限制内,最后一次迭代可以使用尽可能多的资源

>>> sh = HalvingGridSearchCV(base_estimator, param_grid, cv=5,

... factor=2, min_resources='exhaust').fit(X, y)

>>> sh.n_resources_

[250, 500, 1000]

这里的 min_resources 自动设置为 250,使得最后一次迭代使用了所有资源。具体使用的值取决于候选参数的数量、max_resources 和 factor。

对于 HalvingRandomSearchCV,耗尽资源可以通过 2 种方式完成

通过设置

min_resources='exhaust',就像HalvingGridSearchCV一样;通过设置

n_candidates='exhaust'。

这两个选项是互斥的:使用 min_resources='exhaust' 需要知道候选数量,而对称地,n_candidates='exhaust' 需要知道 min_resources。

通常,耗尽所有资源会得到更好的最终候选参数,但时间消耗会稍微增加。

3.2.3.1. 激进的候选淘汰#

使用 aggressive_elimination 参数,您可以强制搜索过程在最后一次迭代中以少于 factor 个候选结束。

激进淘汰的代码示例#

理想情况下,我们希望最后一次迭代评估 factor 个候选。然后我们只需要选择最好的一个。当可用资源数量相对于候选数量较少时,最后一次迭代可能需要评估多于 factor 个候选。

>>> from sklearn.datasets import make_classification

>>> from sklearn.svm import SVC

>>> from sklearn.experimental import enable_halving_search_cv # noqa

>>> from sklearn.model_selection import HalvingGridSearchCV

>>> import pandas as pd

>>> param_grid = {'kernel': ('linear', 'rbf'),

... 'C': [1, 10, 100]}

>>> base_estimator = SVC(gamma='scale')

>>> X, y = make_classification(n_samples=1000)

>>> sh = HalvingGridSearchCV(base_estimator, param_grid, cv=5,

... factor=2, max_resources=40,

... aggressive_elimination=False).fit(X, y)

>>> sh.n_resources_

[20, 40]

>>> sh.n_candidates_

[6, 3]

由于我们不能使用超过 max_resources=40 的资源,因此该过程必须在第二次迭代停止,该迭代评估的候选数量超过 factor=2。

当使用 aggressive_elimination 时,该过程将使用 min_resources 资源淘汰尽可能多的候选。

>>> sh = HalvingGridSearchCV(base_estimator, param_grid, cv=5,

... factor=2,

... max_resources=40,

... aggressive_elimination=True,

... ).fit(X, y)

>>> sh.n_resources_

[20, 20, 40]

>>> sh.n_candidates_

[6, 3, 2]

请注意,在最后一次迭代中我们剩下 2 个候选,因为我们在前几次迭代中已经淘汰了足够的候选,使用的资源量为 n_resources = min_resources = 20。

3.2.3.2. 使用 cv_results_ 属性分析结果#

cv_results_ 属性包含用于分析搜索结果的有用信息。它可以使用 df = pd.DataFrame(est.cv_results_) 转换为 pandas 数据帧。HalvingGridSearchCV 和 HalvingRandomSearchCV 的 cv_results_ 属性与 GridSearchCV 和 RandomizedSearchCV 的类似,并额外包含了与连续减半过程相关的信息。

(截断的) 输出数据帧示例:#

迭代 |

n_resources |

mean_test_score |

参数 |

|

|---|---|---|---|---|

0 |

0 |

125 |

0.983667 |

{‘criterion’: ‘log_loss’, ‘max_depth’: None, ‘max_features’: 9, ‘min_samples_split’: 5} |

1 |

0 |

125 |

0.983667 |

{‘criterion’: ‘gini’, ‘max_depth’: None, ‘max_features’: 8, ‘min_samples_split’: 7} |

2 |

0 |

125 |

0.983667 |

{‘criterion’: ‘gini’, ‘max_depth’: None, ‘max_features’: 10, ‘min_samples_split’: 10} |

3 |

0 |

125 |

0.983667 |

{‘criterion’: ‘log_loss’, ‘max_depth’: None, ‘max_features’: 6, ‘min_samples_split’: 6} |

… |

… |

… |

… |

… |

15 |

2 |

500 |

0.951958 |

{‘criterion’: ‘log_loss’, ‘max_depth’: None, ‘max_features’: 9, ‘min_samples_split’: 10} |

16 |

2 |

500 |

0.947958 |

{‘criterion’: ‘gini’, ‘max_depth’: None, ‘max_features’: 10, ‘min_samples_split’: 10} |

17 |

2 |

500 |

0.951958 |

{‘criterion’: ‘gini’, ‘max_depth’: None, ‘max_features’: 10, ‘min_samples_split’: 4} |

18 |

3 |

1000 |

0.961009 |

{‘criterion’: ‘log_loss’, ‘max_depth’: None, ‘max_features’: 9, ‘min_samples_split’: 10} |

19 |

3 |

1000 |

0.955989 |

{‘criterion’: ‘gini’, ‘max_depth’: None, ‘max_features’: 10, ‘min_samples_split’: 4} |

每一行对应一个给定的参数组合(一个候选)和一个给定的迭代。iter 列给出了迭代次数。n_resources 列告诉您使用了多少资源。

在上面的示例中,最佳参数组合是 {'criterion': 'log_loss', 'max_depth': None, 'max_features': 9, 'min_samples_split': 10},因为它在最后一次迭代(3)中达到了最高分:0.96。

参考文献

3.2.4. 参数搜索技巧#

3.2.4.1. 指定目标指标#

默认情况下,参数搜索使用估计器的 score 函数来评估参数设置。对于分类,这指的是 sklearn.metrics.accuracy_score;对于回归,则是 sklearn.metrics.r2_score。对于某些应用,其他评分函数可能更适用(例如在不平衡分类中,准确率分数通常信息不足),请参阅我应该使用哪个评分函数?获取指导。大多数参数搜索工具都可以通过 scoring 参数指定替代评分函数,详情请参阅评分参数:定义模型评估规则。

3.2.4.2. 指定多个评估指标#

GridSearchCV 和 RandomizedSearchCV 允许为 scoring 参数指定多个指标。

多指标评分可以指定为预定义分数名称的字符串列表,或者一个将评分器名称映射到评分器函数和/或预定义评分器名称的字典。更多详细信息请参阅使用多指标评估。

当指定多个指标时,refit 参数必须设置为用于查找 best_params_ 并用于在整个数据集上构建 best_estimator_ 的指标(字符串)。如果搜索不应重新拟合,请设置 refit=False。在使用多个指标时,将 refit 保持为默认值 None 将导致错误。

有关使用示例,请参阅cross_val_score 和 GridSearchCV 上的多指标评估演示。

HalvingRandomSearchCV 和 HalvingGridSearchCV 不支持多指标评分。

3.2.4.3. 复合估计器和参数空间#

GridSearchCV 和 RandomizedSearchCV 允许通过专用的 <estimator>__<parameter> 语法搜索复合或嵌套估计器(例如 Pipeline、ColumnTransformer、VotingClassifier 或 CalibratedClassifierCV)的参数。

>>> from sklearn.model_selection import GridSearchCV

>>> from sklearn.calibration import CalibratedClassifierCV

>>> from sklearn.ensemble import RandomForestClassifier

>>> from sklearn.datasets import make_moons

>>> X, y = make_moons()

>>> calibrated_forest = CalibratedClassifierCV(

... estimator=RandomForestClassifier(n_estimators=10))

>>> param_grid = {

... 'estimator__max_depth': [2, 4, 6, 8]}

>>> search = GridSearchCV(calibrated_forest, param_grid, cv=5)

>>> search.fit(X, y)

GridSearchCV(cv=5,

estimator=CalibratedClassifierCV(estimator=RandomForestClassifier(n_estimators=10)),

param_grid={'estimator__max_depth': [2, 4, 6, 8]})

在这里,<estimator> 是嵌套估计器的参数名称,在本例中为 estimator。如果元估计器是作为估计器集合(如 pipeline.Pipeline)构建的,那么 <estimator> 指的是估计器的名称,请参阅访问嵌套参数。实际上,可以有多个嵌套级别。

>>> from sklearn.pipeline import Pipeline

>>> from sklearn.feature_selection import SelectKBest

>>> pipe = Pipeline([

... ('select', SelectKBest()),

... ('model', calibrated_forest)])

>>> param_grid = {

... 'select__k': [1, 2],

... 'model__estimator__max_depth': [2, 4, 6, 8]}

>>> search = GridSearchCV(pipe, param_grid, cv=5).fit(X, y)

有关在流水线上执行参数搜索的详细信息,请参阅流水线:链式估计器。

3.2.4.4. 模型选择:开发与评估#

通过评估各种参数设置进行模型选择,可以看作是利用标记数据来“训练”网格参数的一种方式。

在评估所得模型时,重要的是在网格搜索过程中未曾见过的保留样本上进行:建议将数据分割为开发集(用于馈送给 GridSearchCV 实例)和评估集以计算性能指标。

这可以通过使用 train_test_split 工具函数来完成。

3.2.4.5. 并行性#

参数搜索工具独立评估每个数据折叠上的每个参数组合。通过使用关键字 n_jobs=-1 可以并行运行计算。有关更多详细信息,请参阅函数签名,以及n_jobs 的词汇表条目。

3.2.4.6. 对故障的鲁棒性#

某些参数设置可能导致数据的一个或多个折叠无法 fit。默认情况下,这些设置的分数将是 np.nan。这可以通过设置 error_score="raise" 来控制,以便在拟合失败时引发异常;或者例如设置 error_score=0 来为失败的参数组合设置另一个分数。

3.2.5. 暴力参数搜索的替代方案#

3.2.5.1. 模型特定的交叉验证#

一些模型可以针对某个参数的一系列值拟合数据,其效率几乎与针对单个参数值拟合估计器一样。可以利用此特性来执行更高效的交叉验证,用于该参数的模型选择。

最适合这种策略的常见参数是编码正则化强度(strength of the regularizer)的参数。在这种情况下,我们称之为计算估计器的正则化路径。

以下是此类模型列表

|

带有沿正则化路径迭代拟合的弹性网络模型。 |

|

交叉验证的最小角回归模型。 |

|

带有沿正则化路径迭代拟合的 Lasso 线性模型。 |

|

使用 LARS 算法的交叉验证 Lasso。 |

|

逻辑回归交叉验证(又称 logit, MaxEnt)分类器。 |

|

带有内置交叉验证的多任务 L1/L2 弹性网络。 |

|

使用 L1/L2 混合范数作为正则化器训练的多任务 Lasso 模型。 |

交叉验证的正交匹配追踪模型 (OMP)。 |

|

|

带有内置交叉验证的岭回归。 |

|

带有内置交叉验证的岭分类器。 |

3.2.5.2. 信息准则#

一些模型可以通过计算单个正则化路径(而不是在使用交叉验证时的多个路径)来提供正则化参数最优估计的信息论闭式公式。

以下是受益于赤池信息准则 (AIC) 或贝叶斯信息准则 (BIC) 以实现自动化模型选择的模型列表

|

使用 Lars 拟合的 Lasso 模型,通过 BIC 或 AIC 进行模型选择。 |

3.2.5.3. 袋外估计#

当使用基于 Bagging 的集成方法时,即通过有放回抽样生成新的训练集,训练集的一部分仍未被使用。对于集成中的每个分类器,训练集的不同部分被排除在外。

这部分被留出的数据可用于估计泛化误差,而无需依赖单独的验证集。由于不需要额外数据,此估计是“免费”获得的,并可用于模型选择。

这目前已在以下类中实现

随机森林分类器。 |

|

随机森林回归器。 |

|

极度随机树分类器。 |

|

|

极度随机树回归器。 |

|

用于分类的梯度提升。 |

|

用于回归的梯度提升。 |