1.8. 交叉分解#

交叉分解模块包含属于“偏最小二乘法”家族的有监督降维和回归估计器。

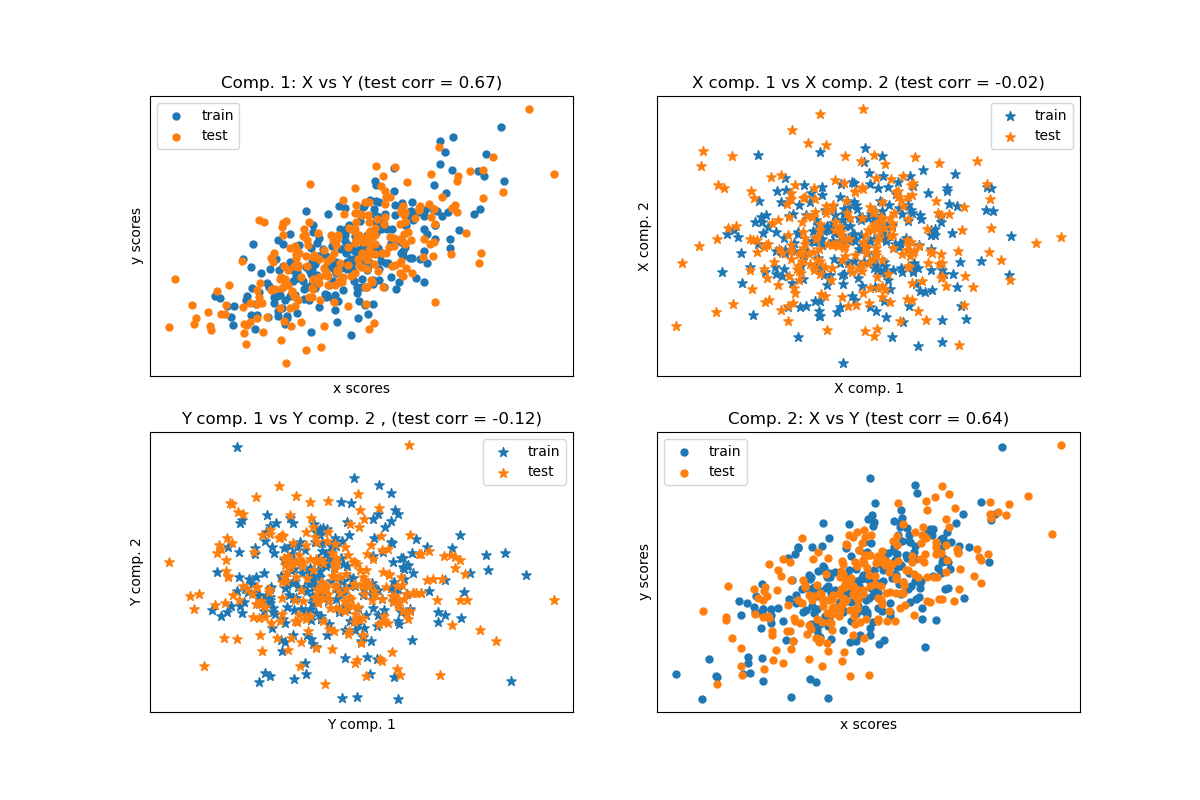

交叉分解算法旨在寻找两个矩阵(X 和 Y)之间的基本关系。它们是用于建模这两个空间中的协方差结构的潜在变量方法。它们将尝试在 X 空间中找到解释 Y 空间中最大多维方差方向的多维方向。换句话说,PLS 将 X 和 Y 投影到一个较低维度的子空间,使得 transformed(X) 和 transformed(Y) 之间的协方差最大化。

PLS 与 主成分回归 (PCR) 有相似之处,后者首先将样本投影到较低维度的子空间,然后使用 transformed(X) 预测目标 y。PCR 的一个问题是降维是无监督的,可能会丢失一些重要的变量:PCR 会保留方差最大的特征,但方差小的特征也可能与预测目标相关。从某种意义上说,PLS 允许进行相同类型的降维,但它会考虑到目标 y。下面的示例对此进行了说明:* 主成分回归与偏最小二乘回归。

除了 CCA 之外,PLS 估计器特别适用于预测变量矩阵的变量多于观测值,并且特征之间存在多重共线性(multicollinearity)的情况。相比之下,标准线性回归在这些情况下会失败,除非它经过正则化。

此模块中包含的类有 PLSRegression、PLSCanonical、CCA 和 PLSSVD

1.8.1. PLSCanonical#

我们在此描述 PLSCanonical 中使用的算法。其他估计器使用该算法的变体,并在下面详细说明。我们推荐参考 [1] 部分以了解这些算法的更多细节和比较。在 [1] 中,PLSCanonical 对应于“PLSW2A”。

给定两个中心化矩阵 \(X \in \mathbb{R}^{n \times d}\) 和 \(Y \in \mathbb{R}^{n \times t}\),以及组件数 \(K\),PLSCanonical 的步骤如下:

设置 \(X_1\) 为 \(X\),\(Y_1\) 为 \(Y\)。然后,对于每个 \(k \in [1, K]\):

a) 计算 \(u_k \in \mathbb{R}^d\) 和 \(v_k \in \mathbb{R}^t\),即交叉协方差矩阵 \(C = X_k^T Y_k\) 的第一个左右奇异向量。\(u_k\) 和 \(v_k\) 被称为权重。根据定义,选择 \(u_k\) 和 \(v_k\) 以最大化投影 \(X_k\) 和投影目标之间的协方差,即 \(\text{Cov}(X_k u_k, Y_k v_k)\)。

b) 将 \(X_k\) 和 \(Y_k\) 投影到奇异向量上以获得分数:\(\xi_k = X_k u_k\) 和 \(\omega_k = Y_k v_k\)

c) 将 \(X_k\) 对 \(\xi_k\) 进行回归,即找到一个向量 \(\gamma_k \in \mathbb{R}^d\),使得秩-1 矩阵 \(\xi_k \gamma_k^T\) 尽可能接近 \(X_k\)。对 \(Y_k\) 使用 \(\omega_k\) 执行相同操作以获得 \(\delta_k\)。向量 \(\gamma_k\) 和 \(\delta_k\) 被称为载荷。

d) 紧缩(deflate) \(X_k\) 和 \(Y_k\),即减去秩-1 近似值:\(X_{k+1} = X_k - \xi_k \gamma_k^T\),以及 \(Y_{k + 1} = Y_k - \omega_k \delta_k^T\)。

最后,我们将 \(X\) 近似为秩-1 矩阵的和:\(X = \Xi \Gamma^T\),其中 \(\Xi \in \mathbb{R}^{n \times K}\) 的列中包含分数,\(\Gamma^T \in \mathbb{R}^{K \times d}\) 的行中包含载荷。类似地,对于 \(Y\),我们有 \(Y = \Omega \Delta^T\)。

请注意,分数矩阵 \(\Xi\) 和 \(\Omega\) 分别对应于训练数据 \(X\) 和 \(Y\) 的投影。

步骤 a) 可以通过两种方式执行:要么计算 \(C\) 的整个 SVD 并仅保留具有最大奇异值的奇异向量,要么使用幂法直接计算奇异向量(参见 [1] 的第 11.3 节),这对应于 algorithm 参数的 'nipals' 选项。

转换数据#

要将 \(X\) 转换为 \(\bar{X}\),我们需要找到一个投影矩阵 \(P\),使得 \(\bar{X} = XP\)。我们知道对于训练数据,\(\Xi = XP\),且 \(X = \Xi \Gamma^T\)。设置 \(P = U(\Gamma^T U)^{-1}\),其中 \(U\) 是以 \(u_k\) 为列的矩阵,我们有 \(XP = X U(\Gamma^T U)^{-1} = \Xi (\Gamma^T U) (\Gamma^T U)^{-1} = \Xi\),正如所期望的。旋转矩阵 \(P\) 可以通过 x_rotations_ 属性访问。

类似地,可以使用旋转矩阵 \(V(\Delta^T V)^{-1}\) 转换 \(Y\),该矩阵通过 y_rotations_ 属性访问。

预测目标 Y#

为了预测某些数据 \(X\) 的目标,我们正在寻找一个系数矩阵 \(\beta \in R^{d \times t}\),使得 \(Y = X\beta\)。

其思想是尝试将转换后的目标 \(\Omega\) 作为转换后的样本 \(\Xi\) 的函数进行预测,通过计算 \(\alpha \in \mathbb{R}\) 使得 \(\Omega = \alpha \Xi\)。

然后,我们有 \(Y = \Omega \Delta^T = \alpha \Xi \Delta^T\),并且由于 \(\Xi\) 是转换后的训练数据,我们有 \(Y = X \alpha P \Delta^T\),因此系数矩阵 \(\beta = \alpha P \Delta^T\)。

\(\beta\) 可以通过 coef_ 属性访问。

1.8.2. PLSSVD#

PLSSVD 是前面描述的 PLSCanonical 的简化版本:它不是迭代地紧缩矩阵 \(X_k\) 和 \(Y_k\),而是只计算一次 \(C = X^TY\) 的 SVD,并将对应于最大奇异值的 n_components 个奇异向量存储在矩阵 U 和 V 中,对应于 x_weights_ 和 y_weights_ 属性。在这里,转换后的数据仅仅是 transformed(X) = XU 和 transformed(Y) = YV。

如果 n_components == 1,则 PLSSVD 和 PLSCanonical 是严格等效的。

1.8.3. PLSRegression#

PLSRegression 估计器与带有 algorithm='nipals' 的 PLSCanonical 相似,但有 2 个显着区别:

在步骤 a) 中,用于计算 \(u_k\) 和 \(v_k\) 的幂法中,\(v_k\) 从未被归一化。

在步骤 c) 中,目标 \(Y_k\) 使用 \(X_k\) 的投影(即 \(\xi_k\))而不是 \(Y_k\) 的投影(即 \(\omega_k\))进行近似。换句话说,载荷计算是不同的。因此,步骤 d) 中的紧缩也会受到影响。

这两个修改影响了 predict 和 transform 的输出,它们与 PLSCanonical 不同。此外,虽然 PLSCanonical 中的组件数受限于 min(n_samples, n_features, n_targets),但这里的限制是 \(X^TX\) 的秩,即 min(n_samples, n_features)。

PLSRegression 也被称为 PLS1(单个目标)和 PLS2(多个目标)。与 Lasso 非常相似,PLSRegression 是一种正则化线性回归形式,其中组件数控制着正则化强度。

1.8.4. 典型相关分析#

典型相关分析(Canonical Correlation Analysis, CCA)是在 PLS 之前独立开发的。但事实证明,CCA 是 PLS 的一个特例,在文献中对应于 PLS 的“模式 B”。

CCA 与 PLSCanonical 的区别在于步骤 a) 的幂法中计算权重 \(u_k\) 和 \(v_k\) 的方式。详细信息可以在 [1] 的第 10 节中找到。

由于 CCA 涉及 \(X_k^TX_k\) 和 \(Y_k^TY_k\) 的逆,如果特征或目标的数量大于样本数量,这个估计器可能会不稳定。

References

示例