示例#

这是一个示例画廊,展示了如何使用 scikit-learn。有些示例演示了 API 的一般用法,有些则以教程形式演示了具体的应用。另请查阅我们的 用户指南 以获取更详细的说明。

版本亮点#

这些示例说明了 scikit-learn 版本的核心功能。

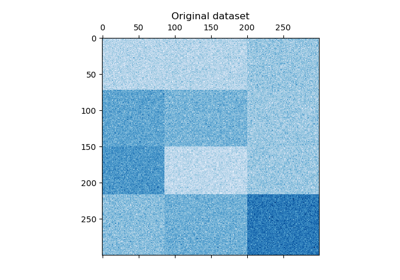

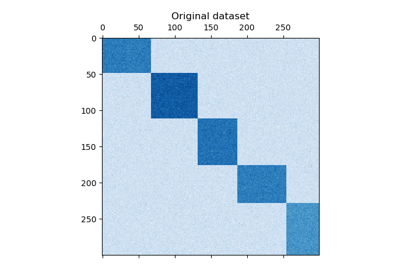

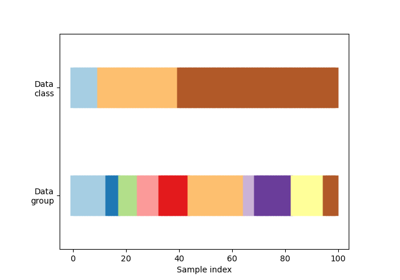

双聚类#

关于双聚类技术的示例。

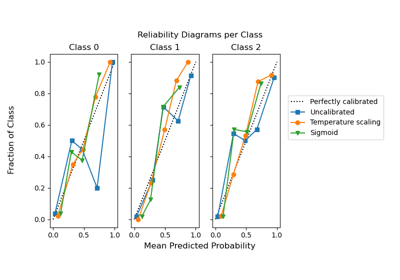

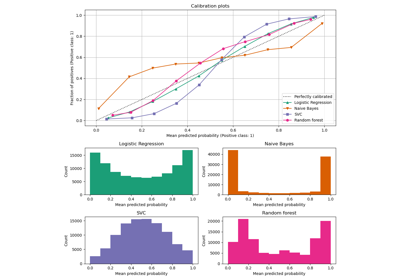

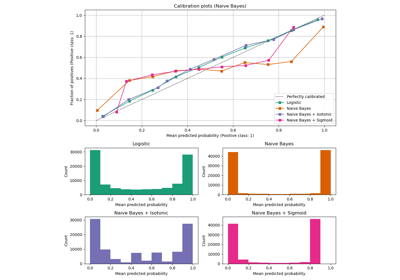

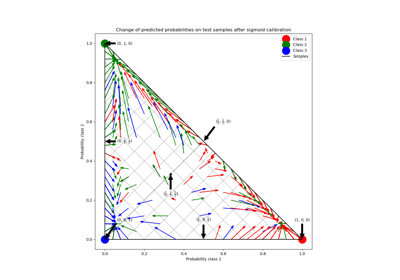

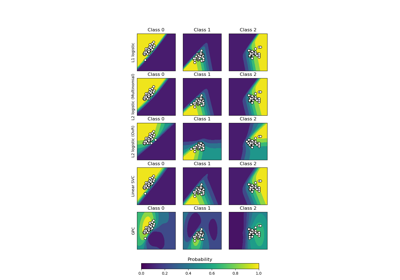

校准#

说明分类器预测概率校准的示例。

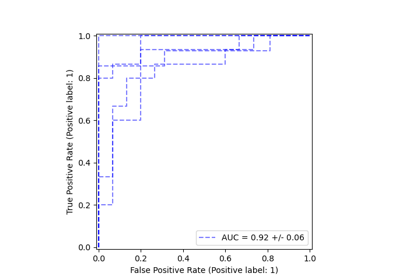

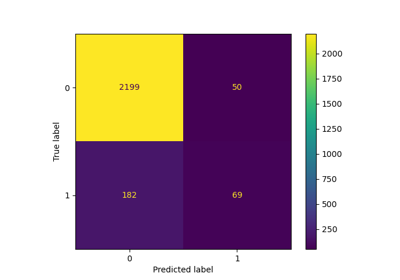

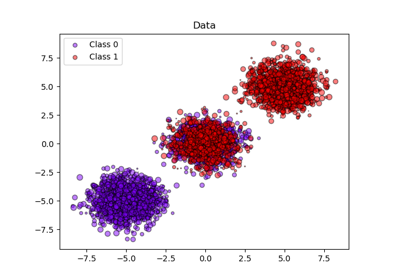

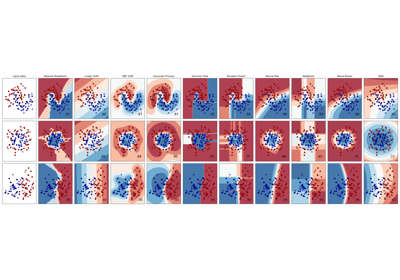

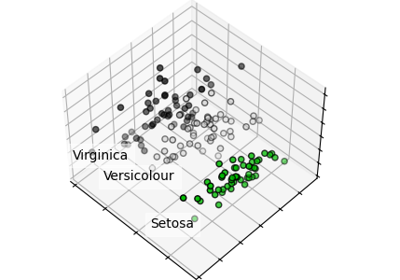

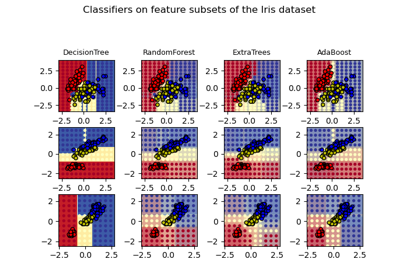

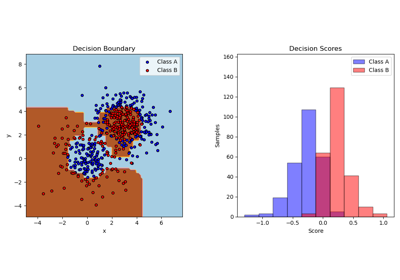

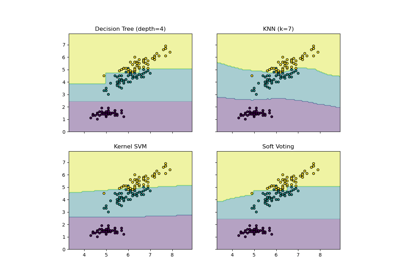

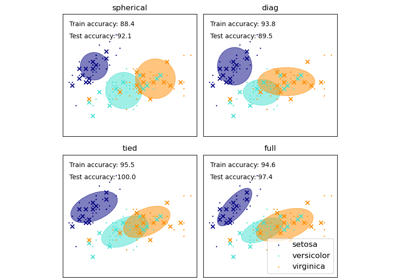

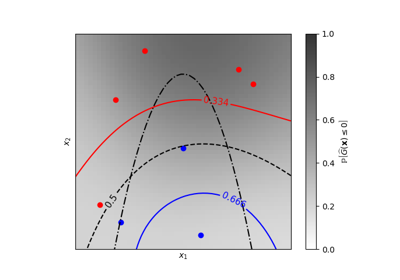

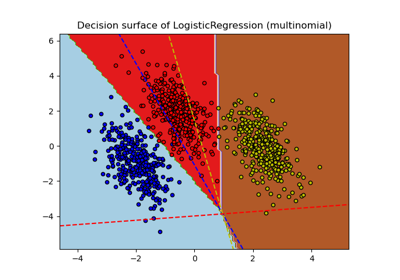

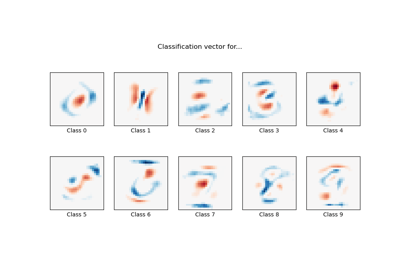

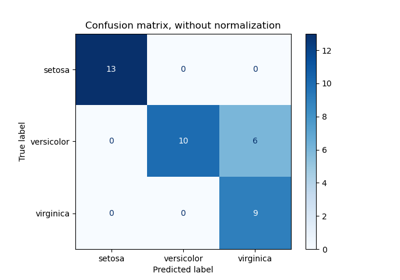

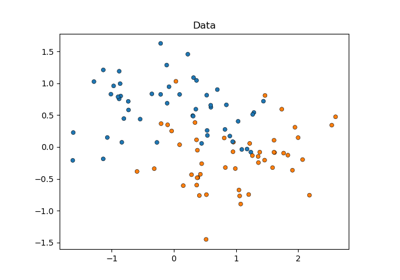

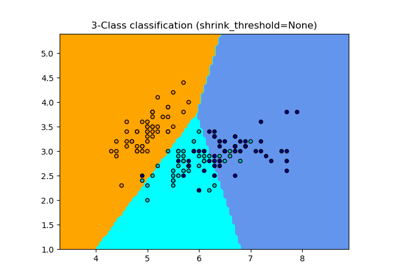

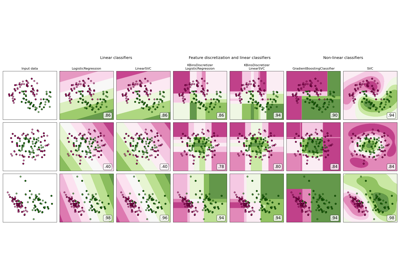

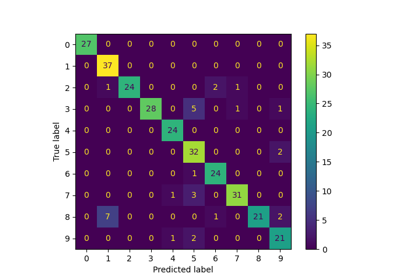

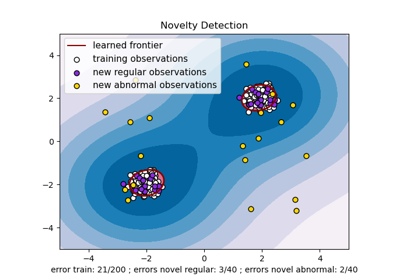

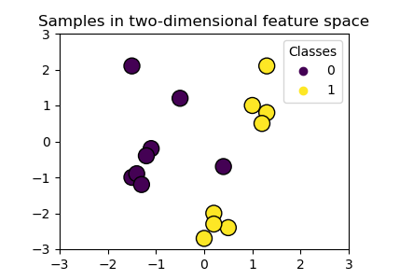

分类#

关于分类算法的一般示例。

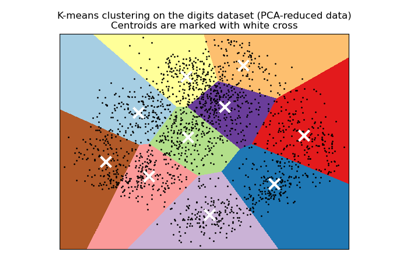

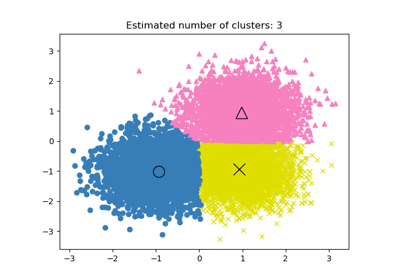

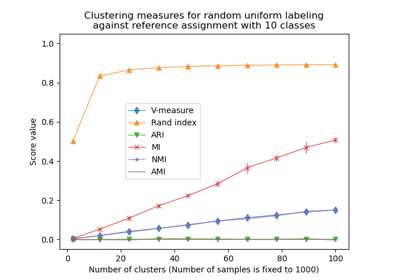

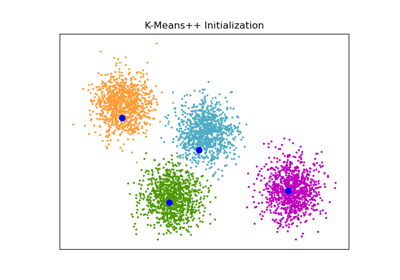

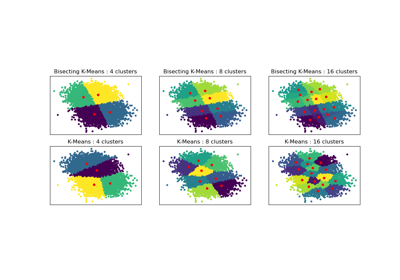

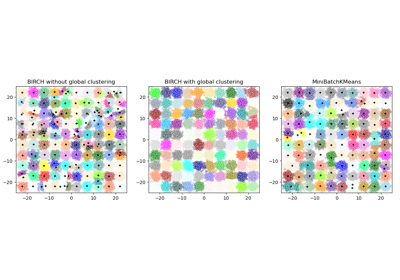

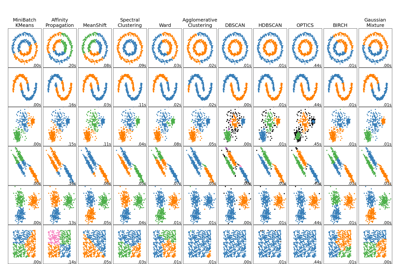

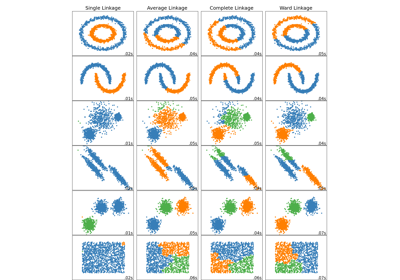

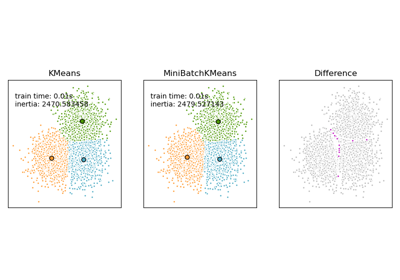

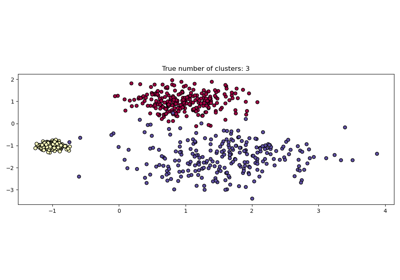

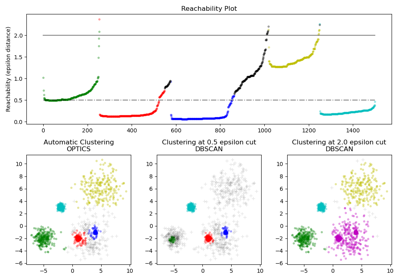

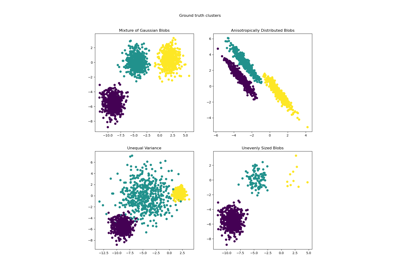

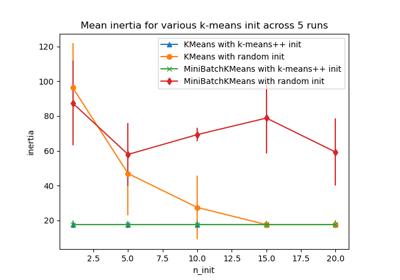

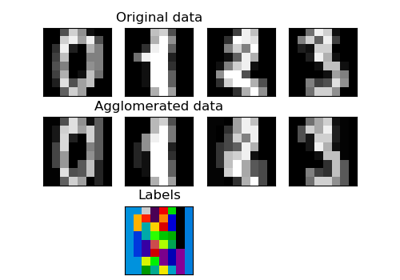

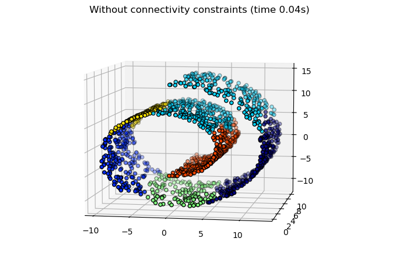

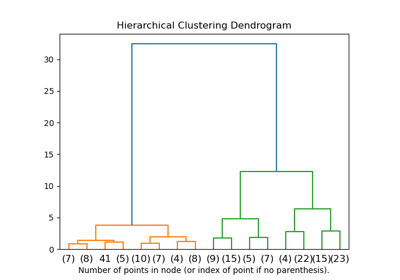

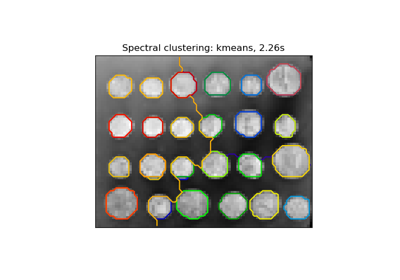

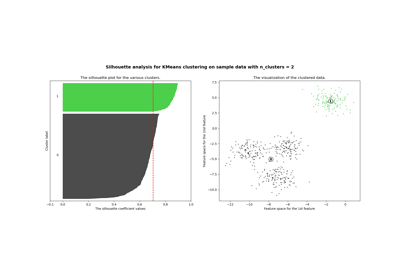

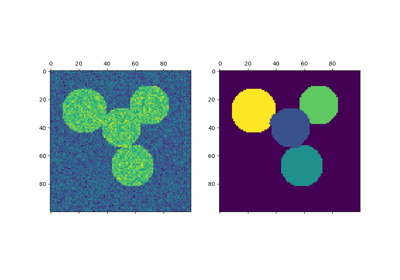

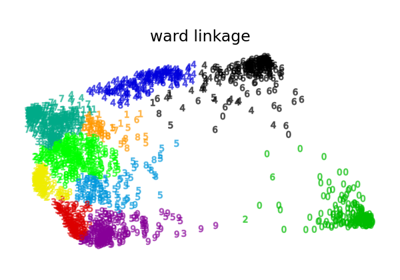

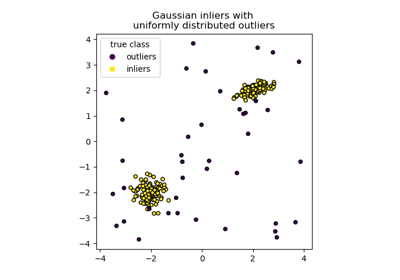

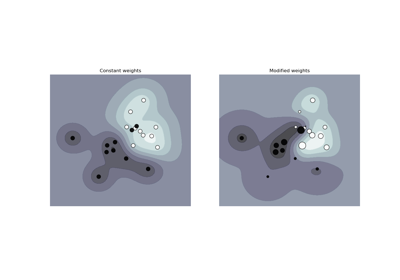

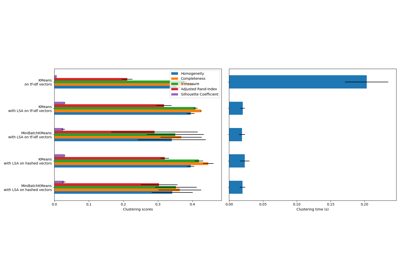

聚类#

关于 sklearn.cluster 模块的示例。

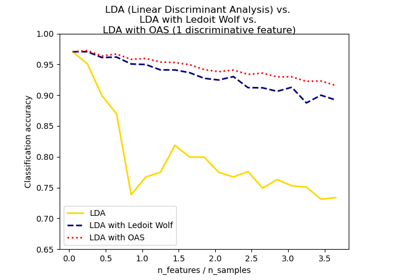

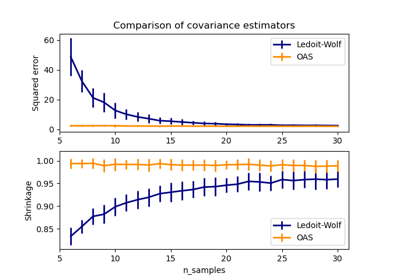

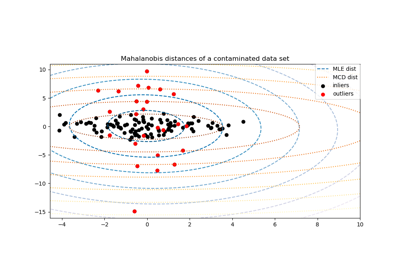

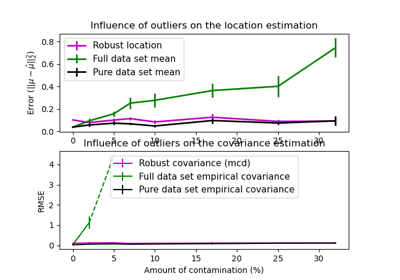

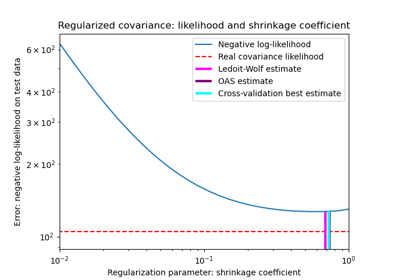

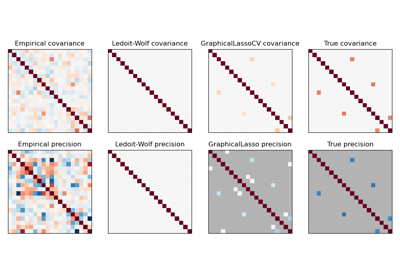

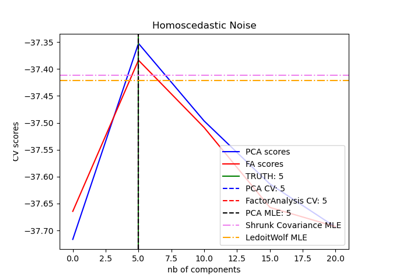

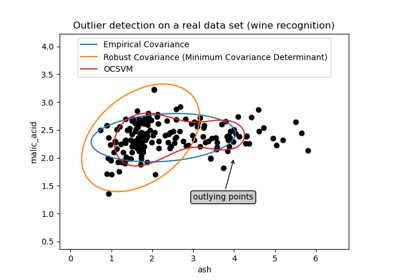

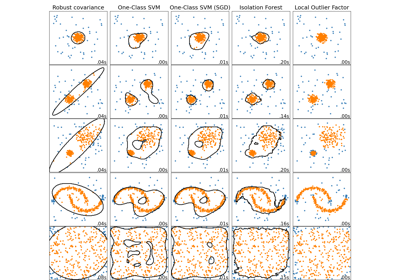

协方差估计#

关于 sklearn.covariance 模块的示例。

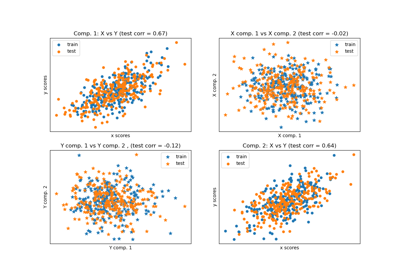

交叉分解#

关于 sklearn.cross_decomposition 模块的示例。

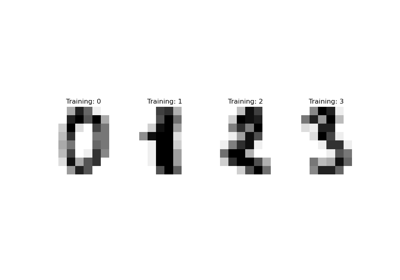

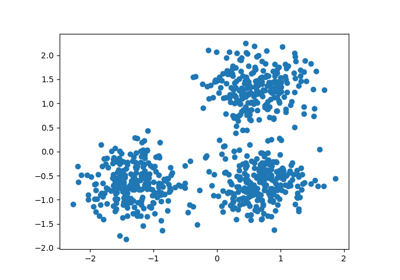

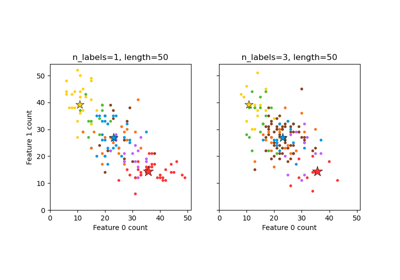

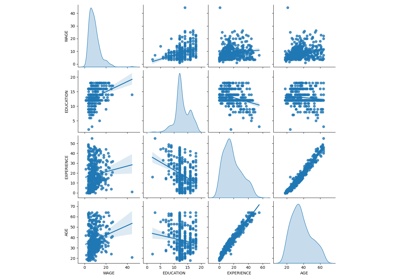

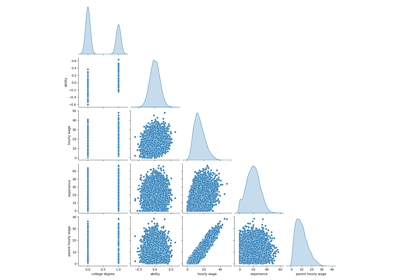

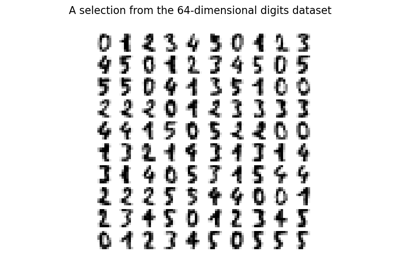

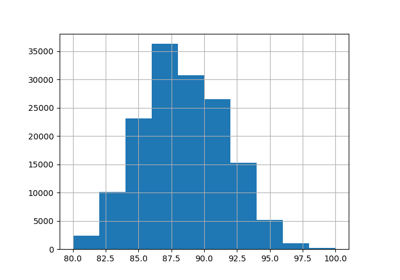

数据集示例#

关于 sklearn.datasets 模块的示例。

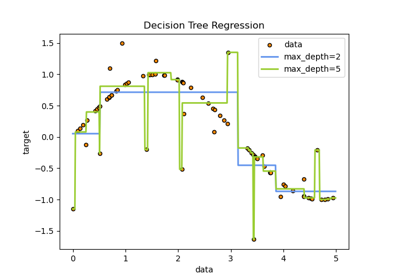

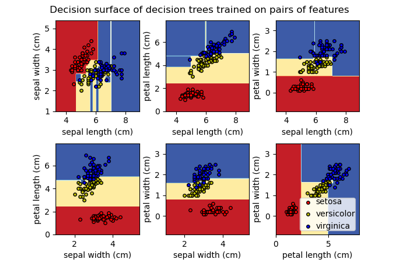

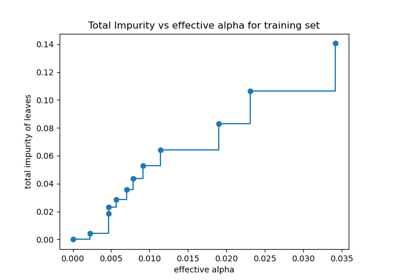

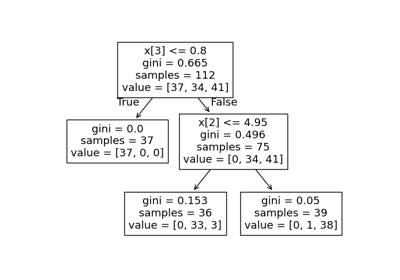

决策树#

关于 sklearn.tree 模块的示例。

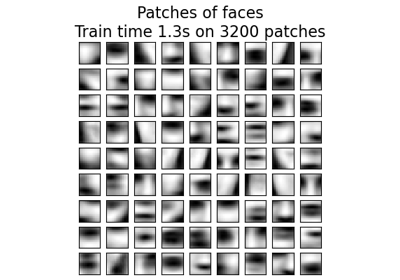

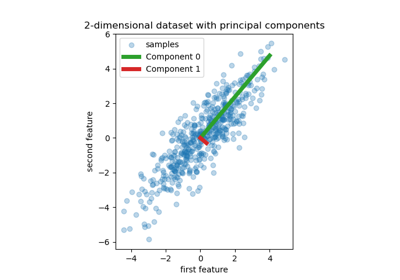

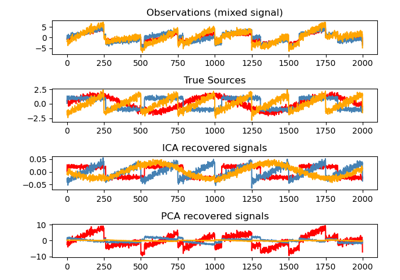

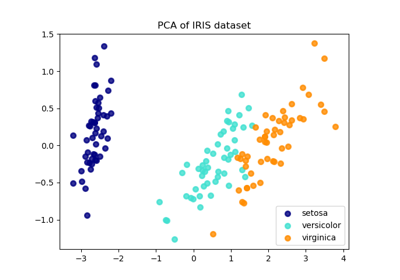

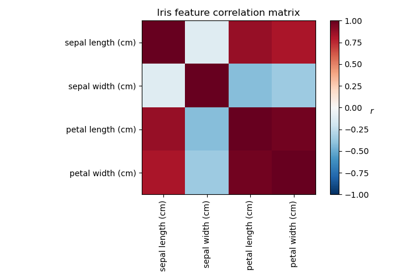

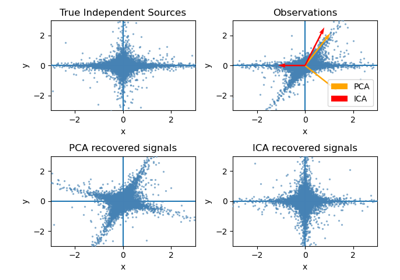

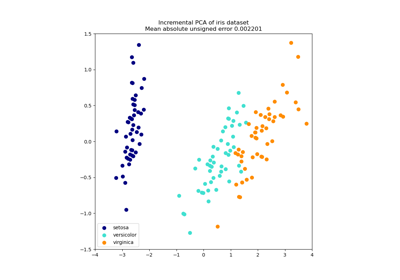

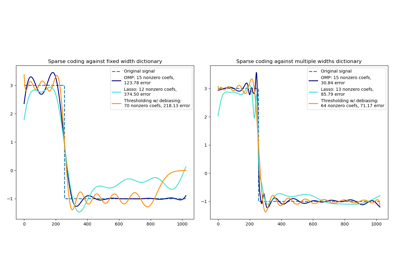

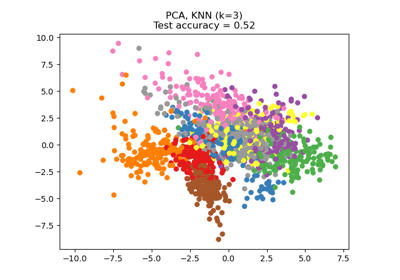

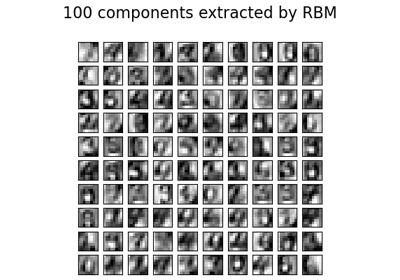

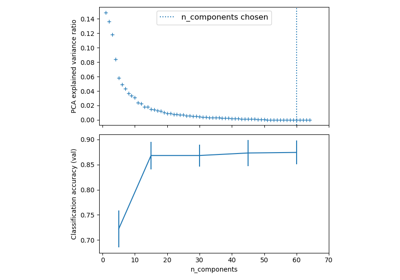

分解#

关于 sklearn.decomposition 模块的示例。

开发估计器#

关于开发自定义估计器的示例。

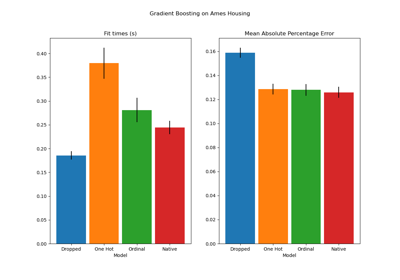

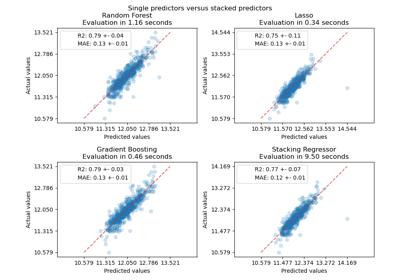

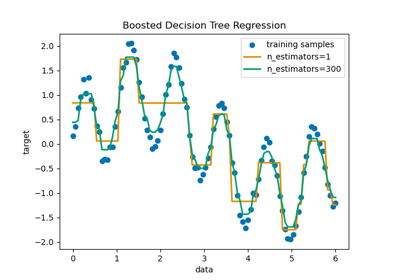

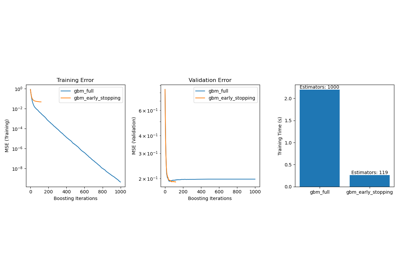

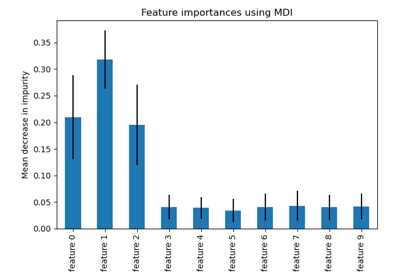

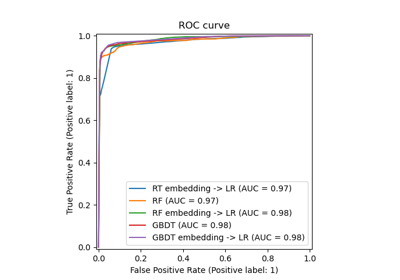

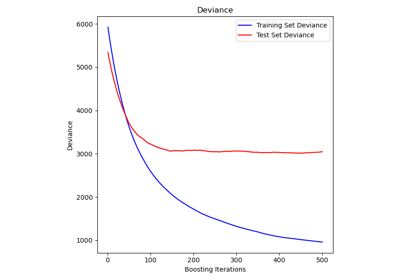

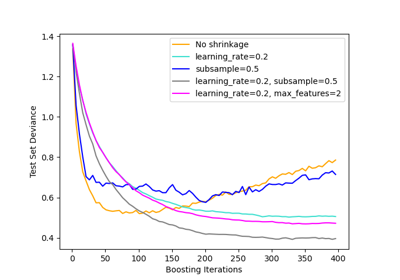

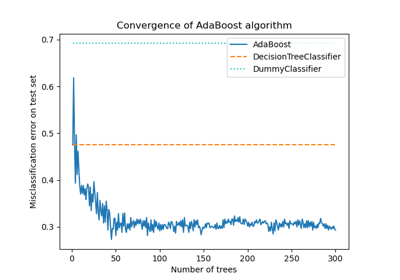

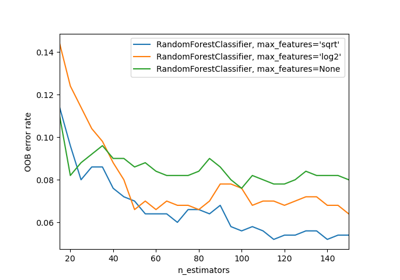

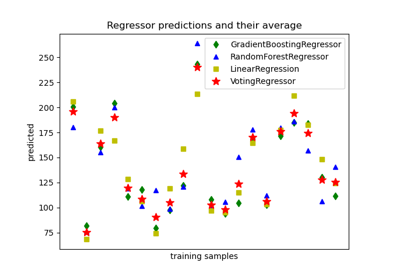

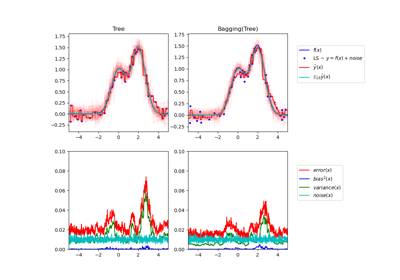

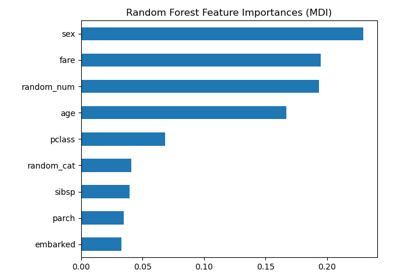

集成方法#

关于 sklearn.ensemble 模块的示例。

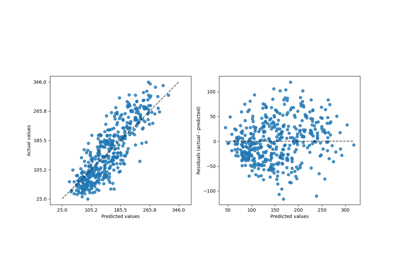

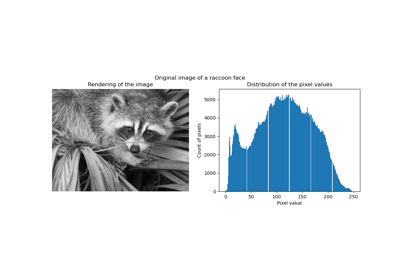

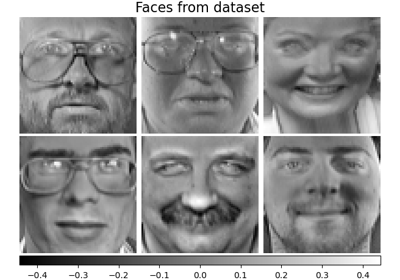

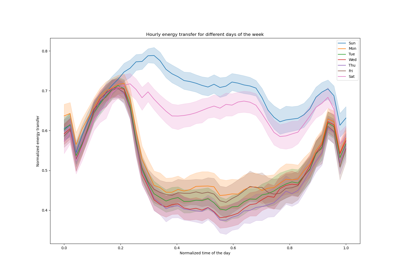

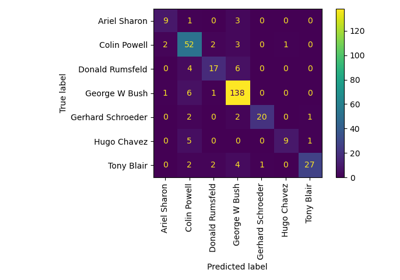

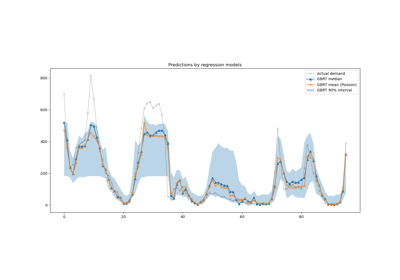

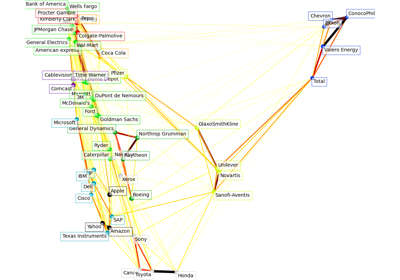

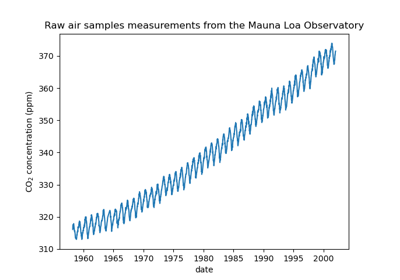

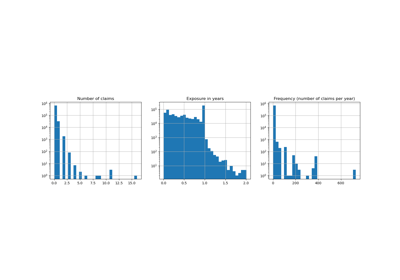

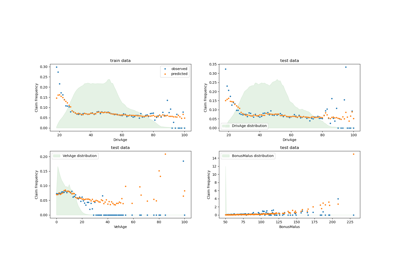

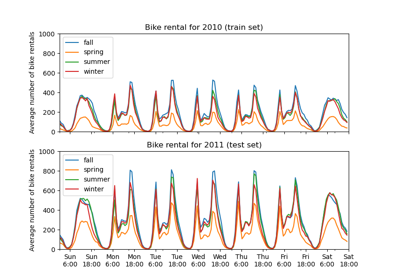

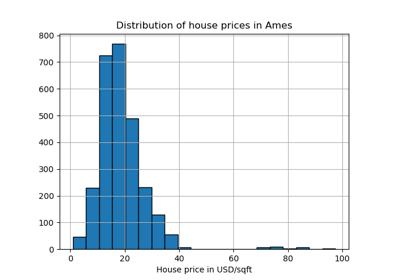

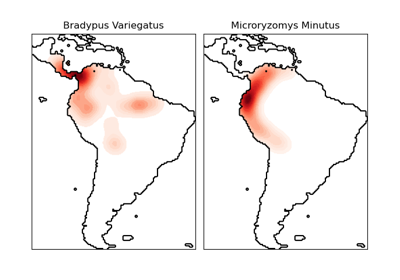

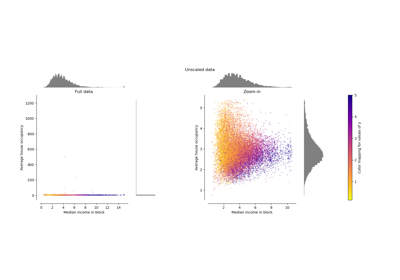

基于真实世界数据集的示例#

应用于真实世界问题的应用程序,使用一些中型数据集或交互式用户界面。

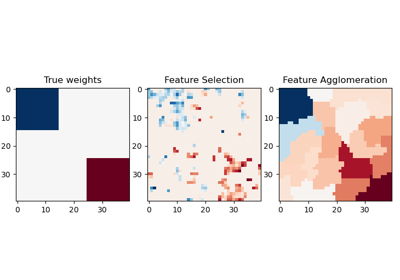

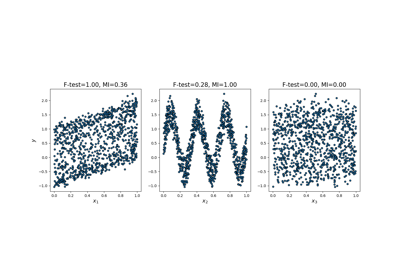

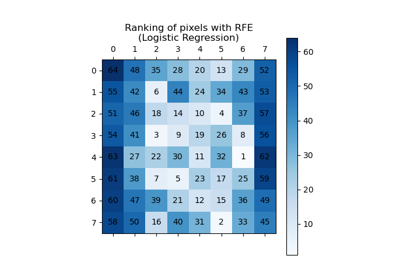

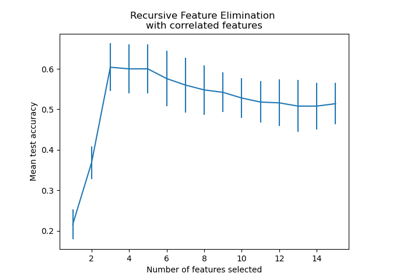

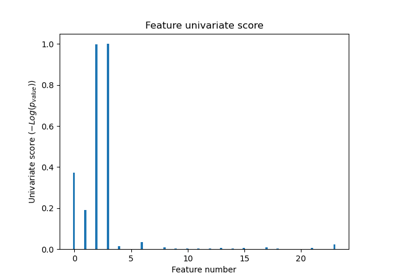

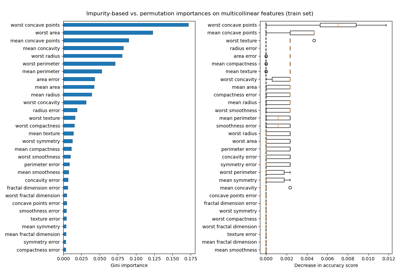

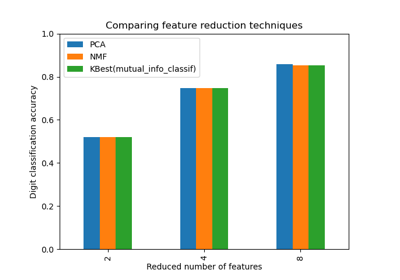

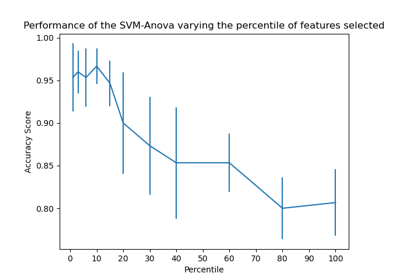

特征选择#

关于 sklearn.feature_selection 模块的示例。

冻结估计器#

关于 sklearn.frozen 模块的示例。

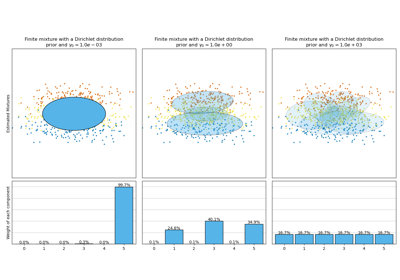

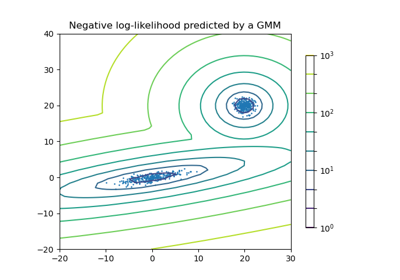

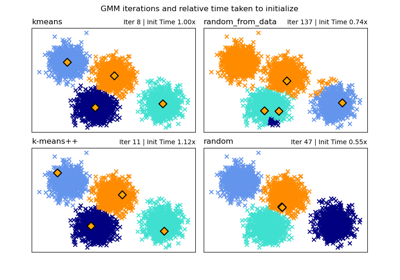

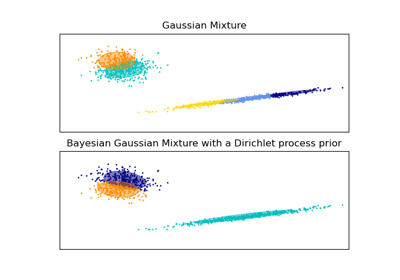

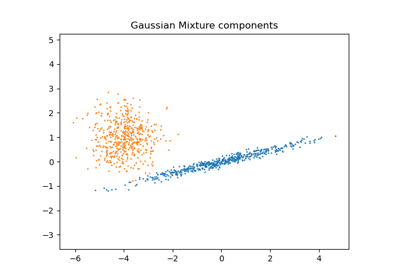

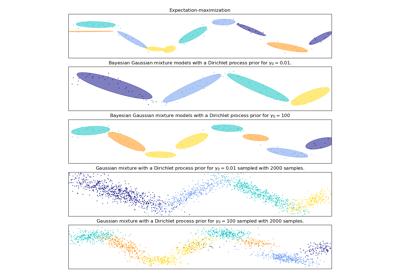

高斯混合模型#

关于 sklearn.mixture 模块的示例。

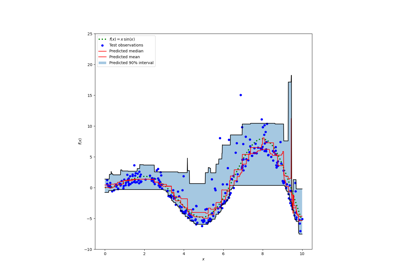

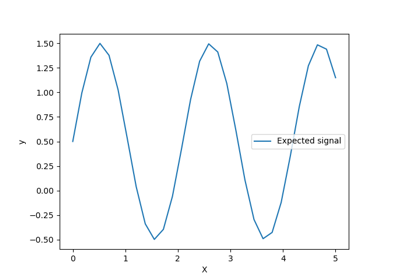

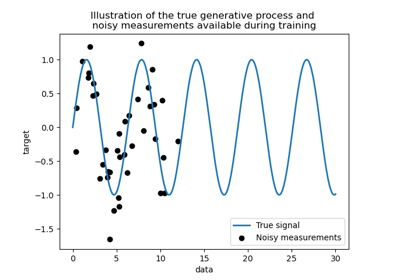

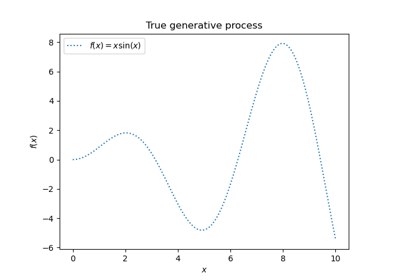

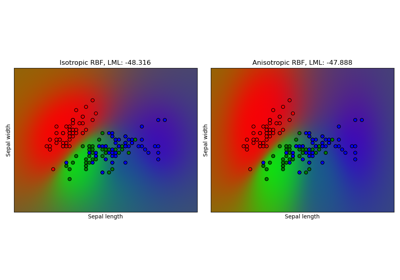

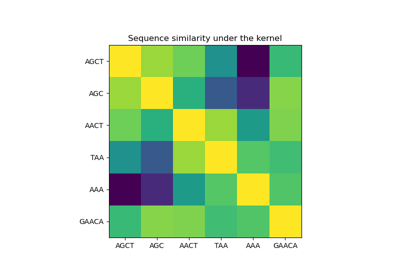

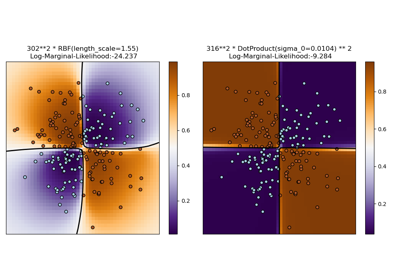

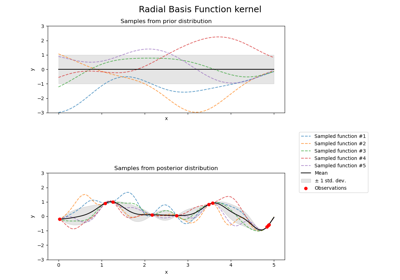

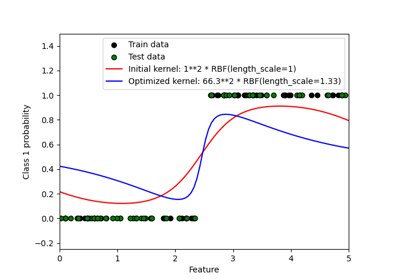

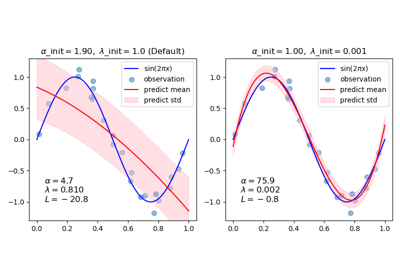

机器学习中的高斯过程#

关于 sklearn.gaussian_process 模块的示例。

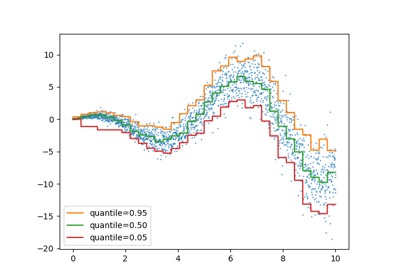

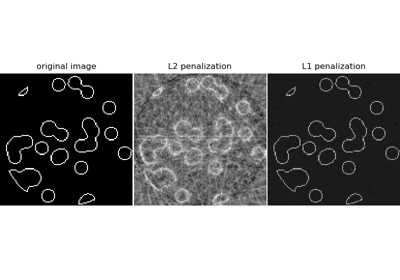

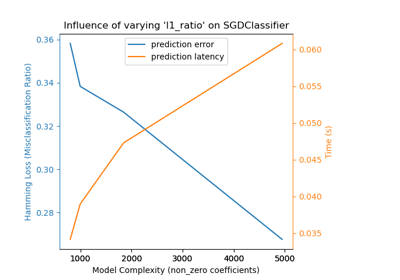

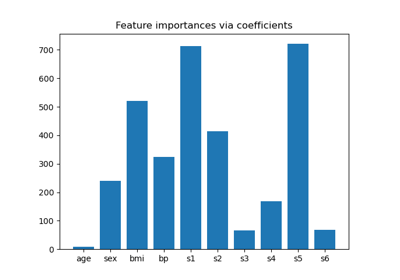

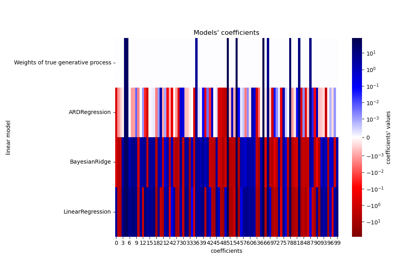

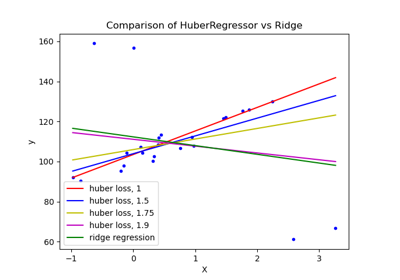

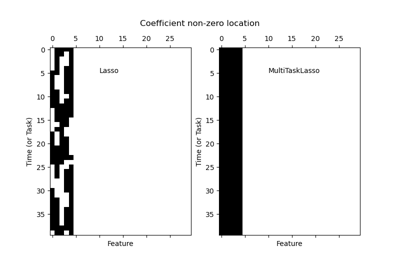

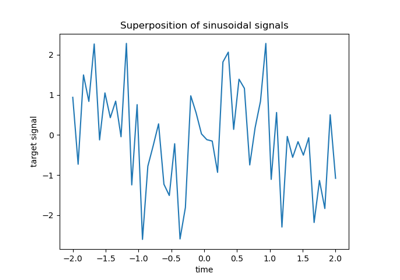

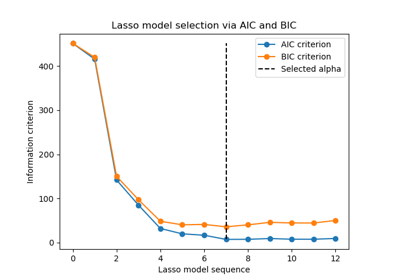

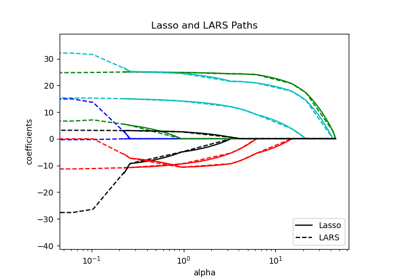

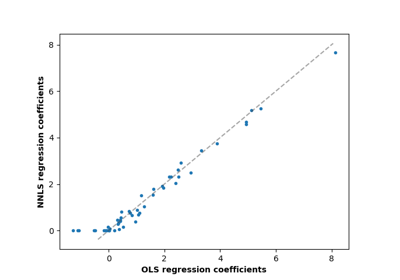

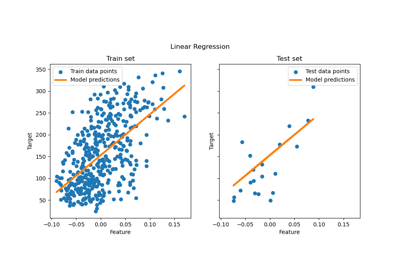

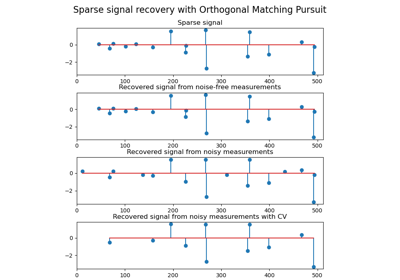

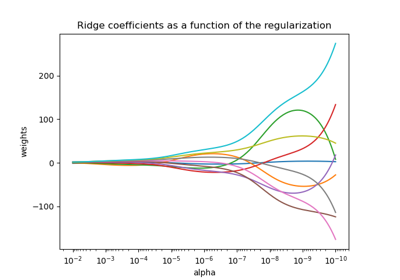

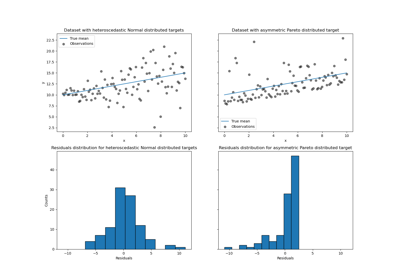

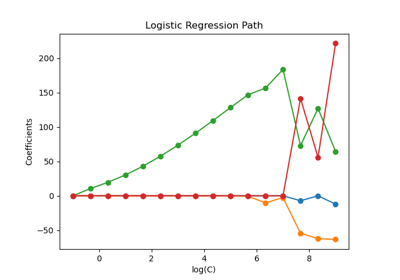

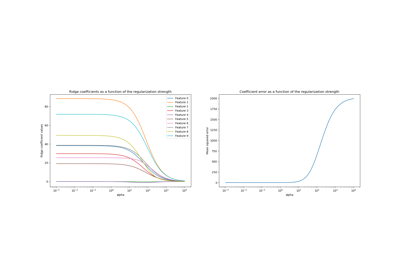

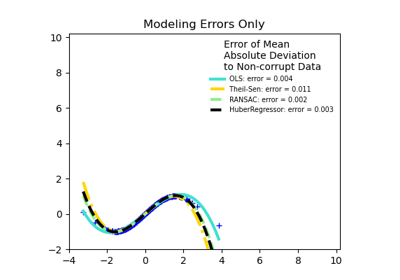

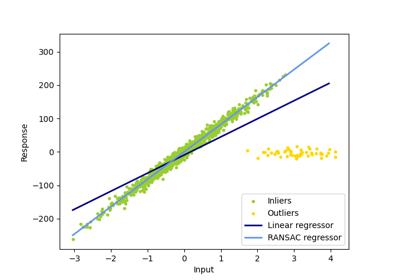

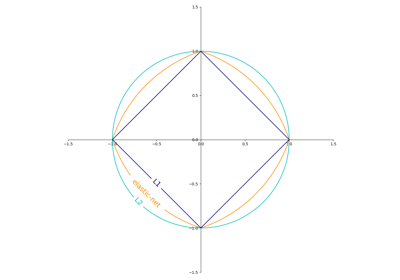

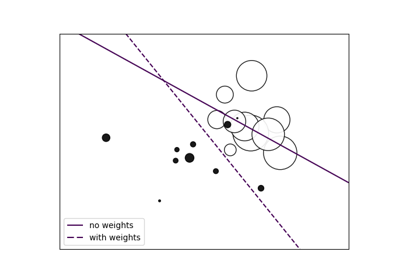

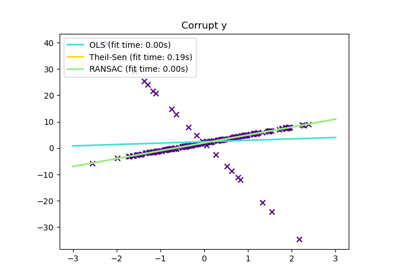

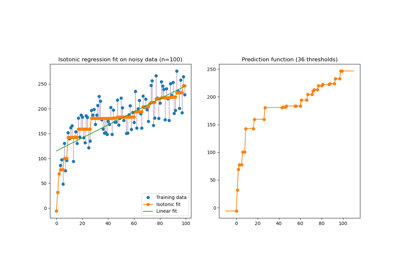

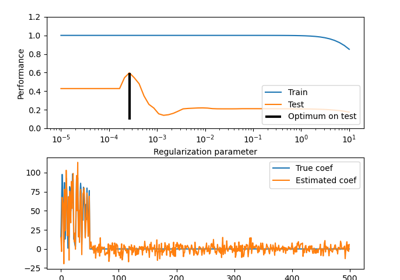

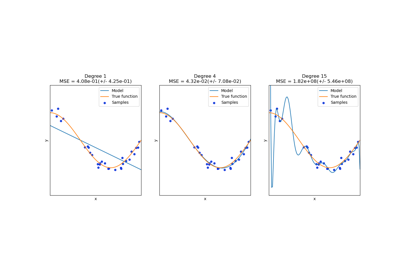

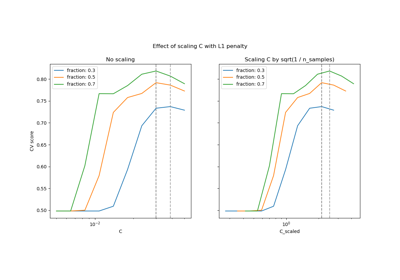

广义线性模型#

关于 sklearn.linear_model 模块的示例。

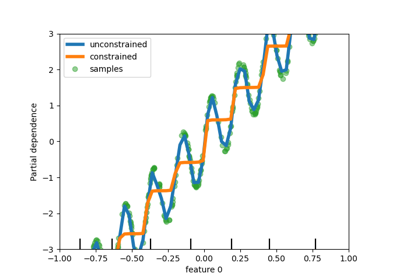

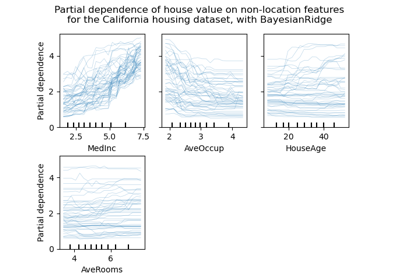

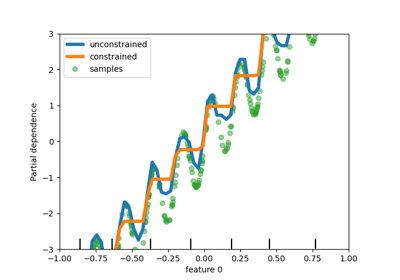

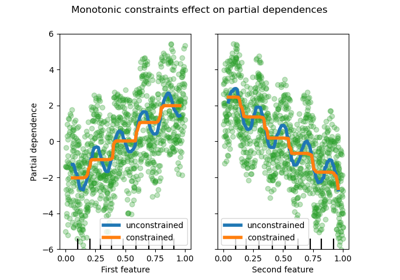

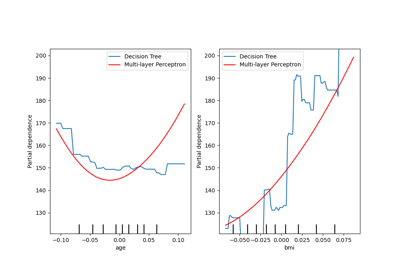

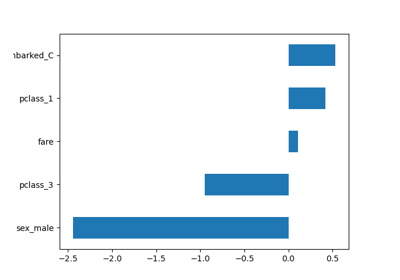

检查#

与 sklearn.inspection 模块相关的示例。

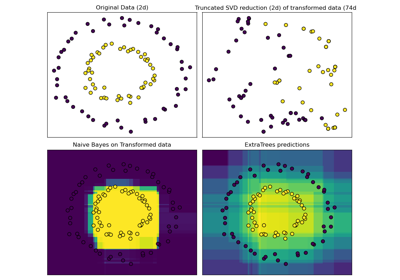

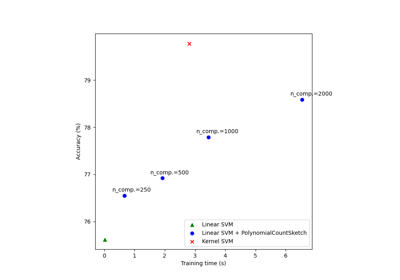

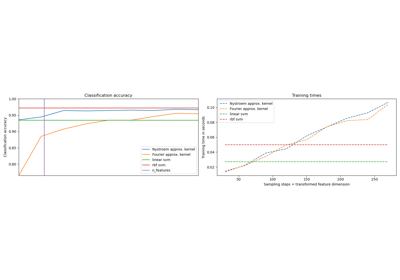

核近似#

关于 sklearn.kernel_approximation 模块的示例。

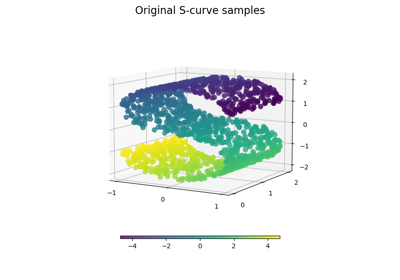

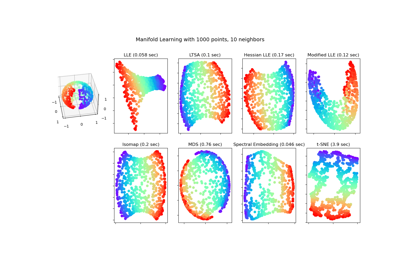

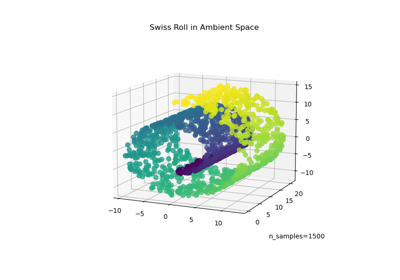

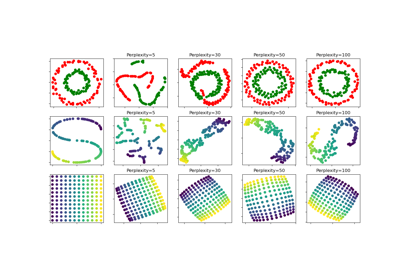

流形学习#

关于 sklearn.manifold 模块的示例。

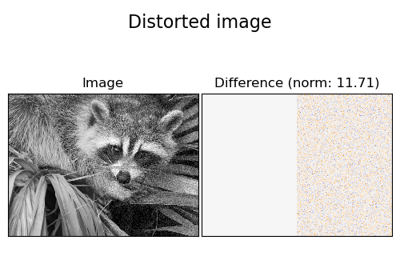

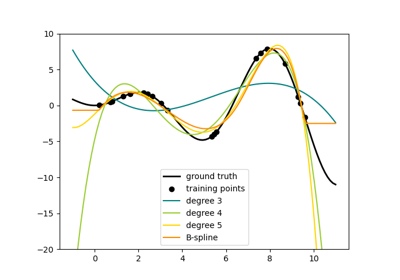

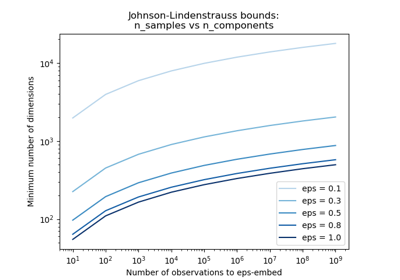

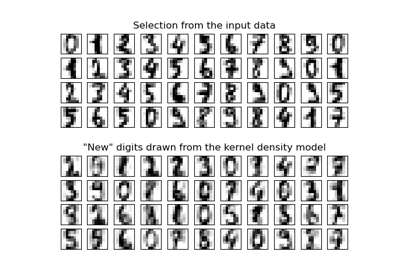

杂项#

scikit-learn 的杂项和介绍性示例。

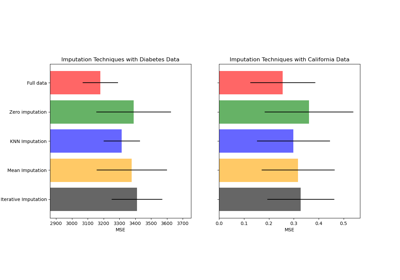

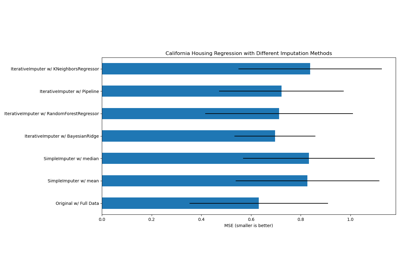

缺失值插补#

关于 sklearn.impute 模块的示例。

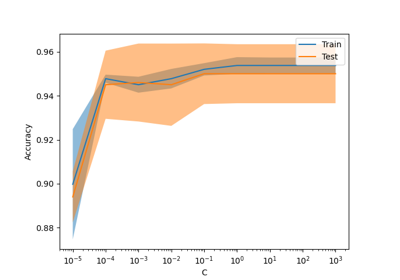

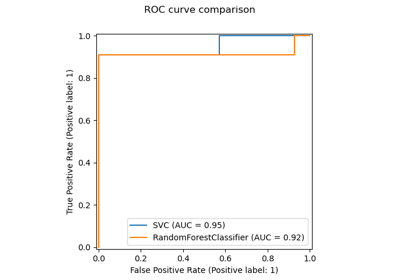

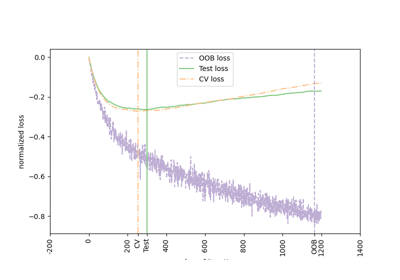

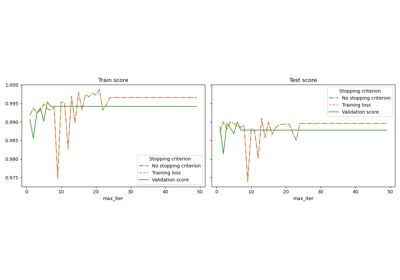

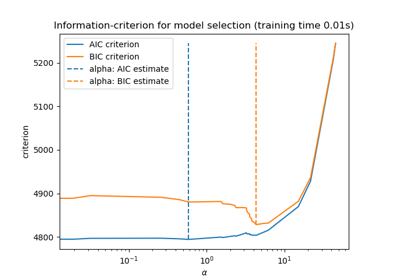

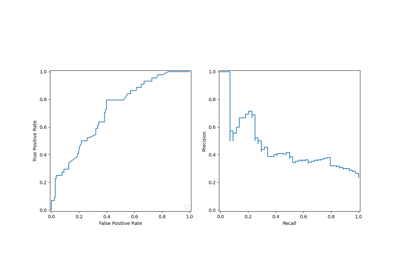

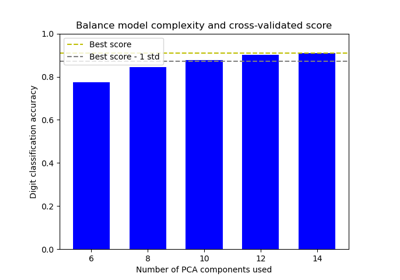

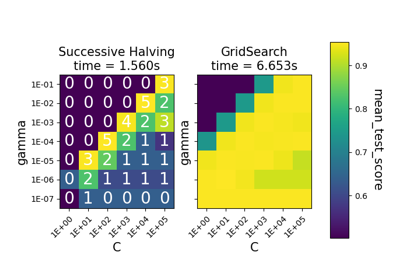

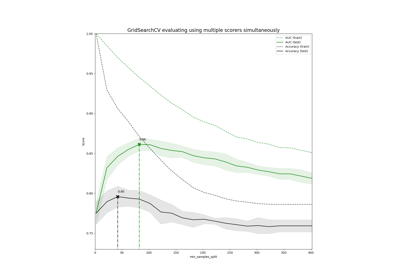

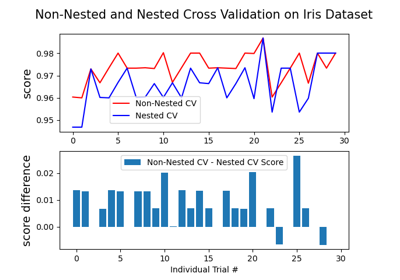

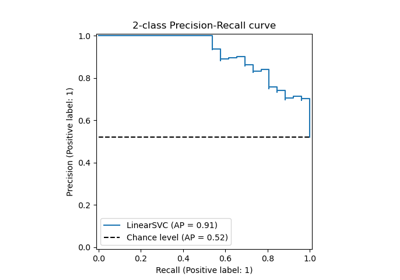

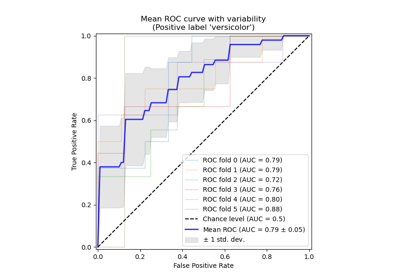

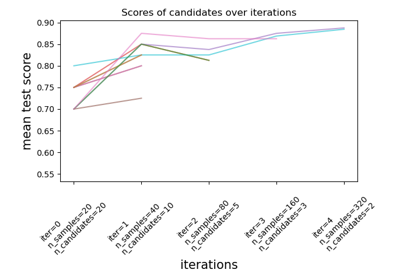

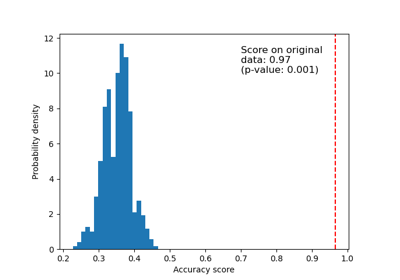

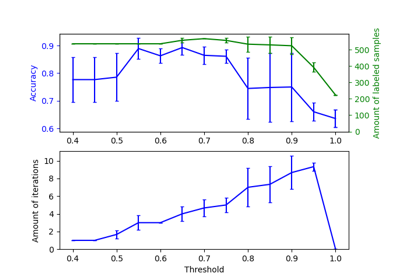

模型选择#

与 sklearn.model_selection 模块相关的示例。

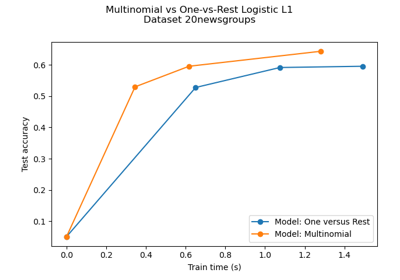

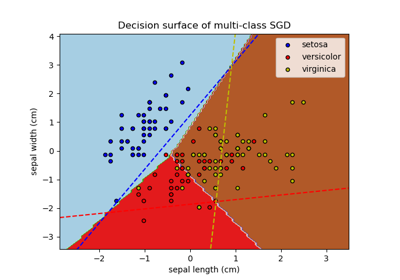

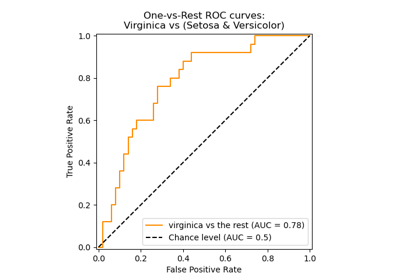

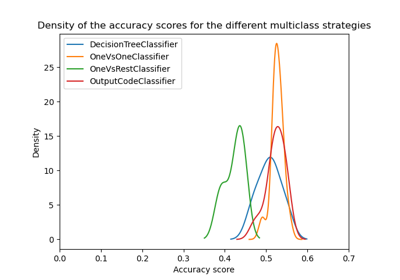

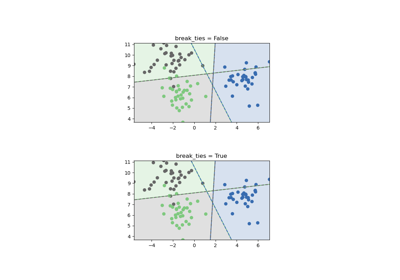

多类别方法#

关于 sklearn.multiclass 模块的示例。

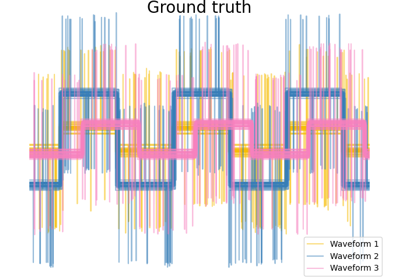

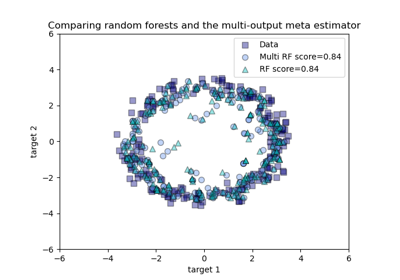

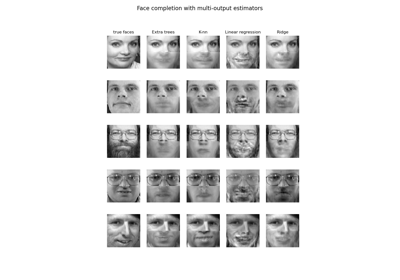

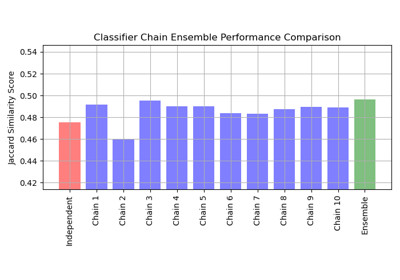

多输出方法#

关于 sklearn.multioutput 模块的示例。

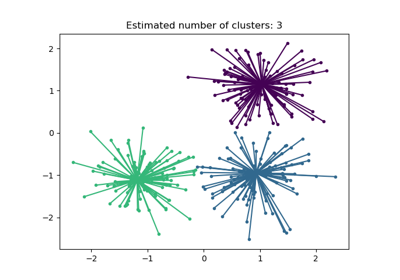

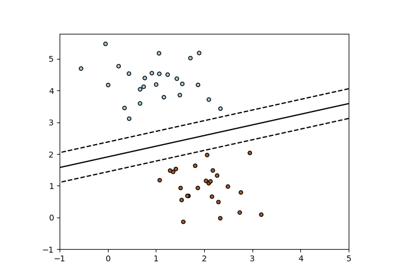

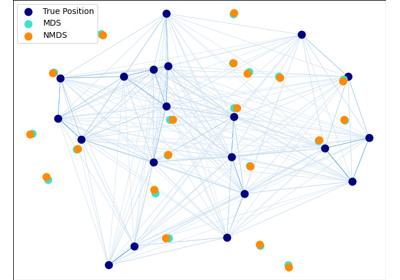

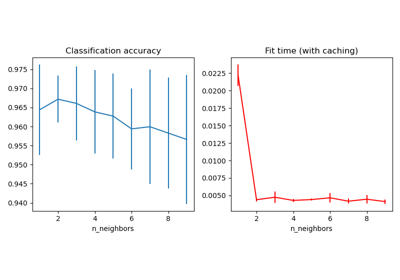

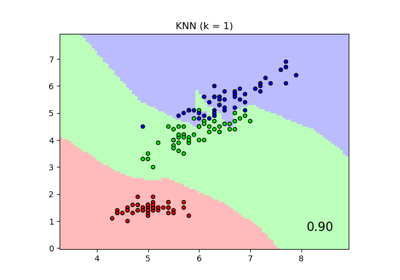

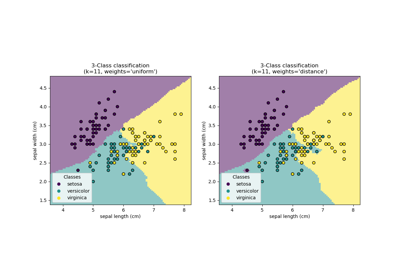

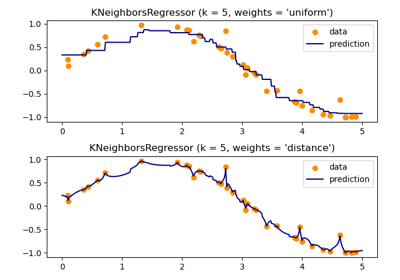

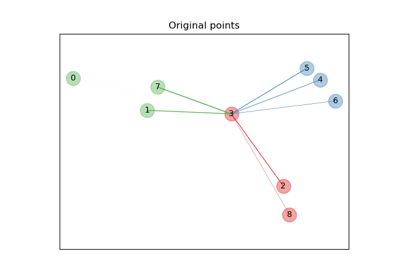

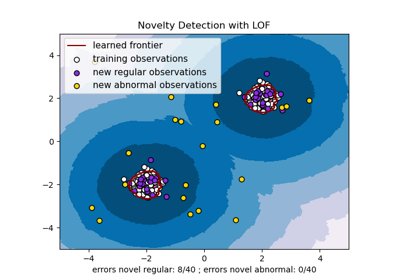

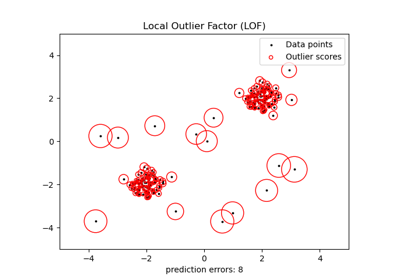

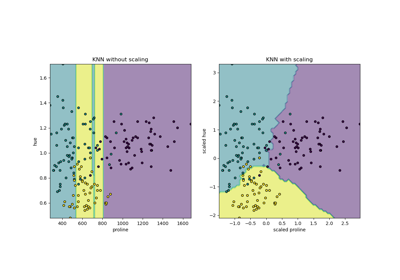

最近邻#

关于 sklearn.neighbors 模块的示例。

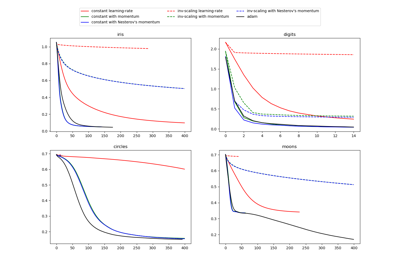

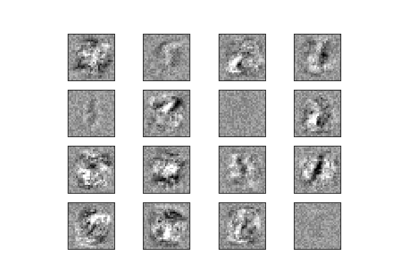

神经网络#

关于 sklearn.neural_network 模块的示例。

管道和复合估计器#

关于如何将转换器和管道与其他估计器组合的示例。请参阅 用户指南。

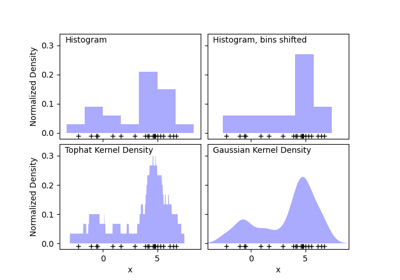

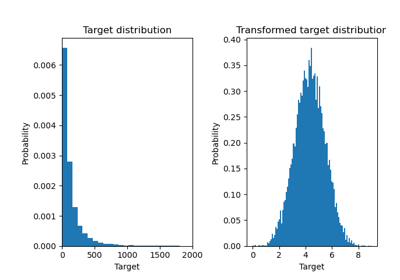

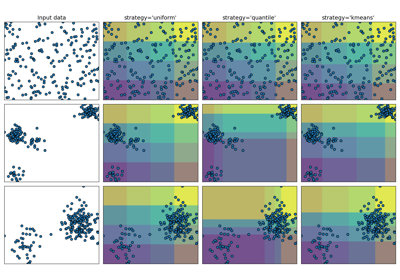

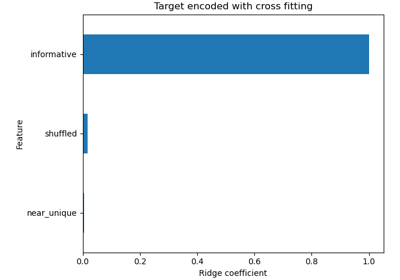

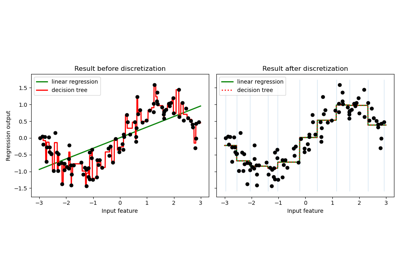

预处理#

关于 sklearn.preprocessing 模块的示例。

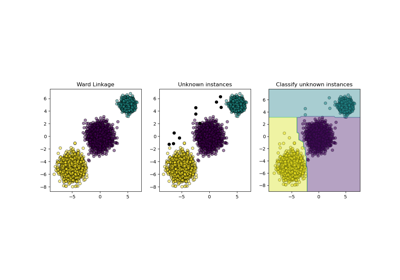

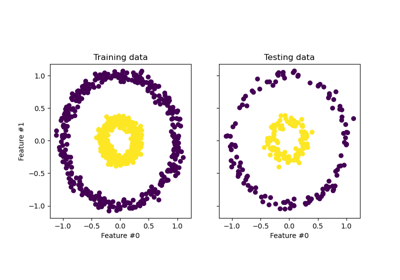

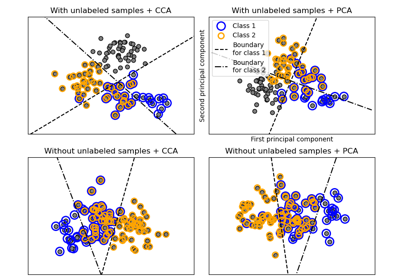

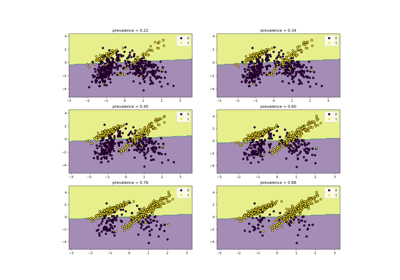

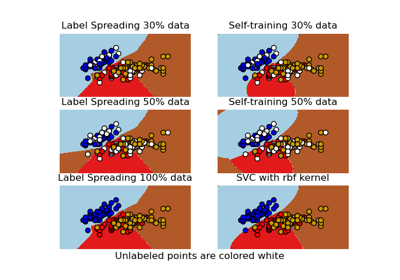

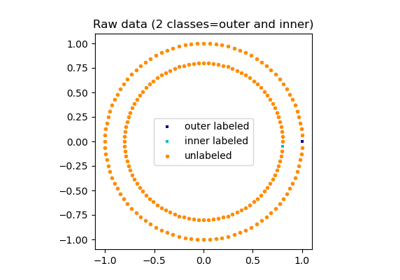

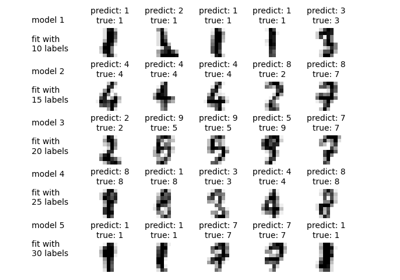

半监督分类#

关于 sklearn.semi_supervised 模块的示例。

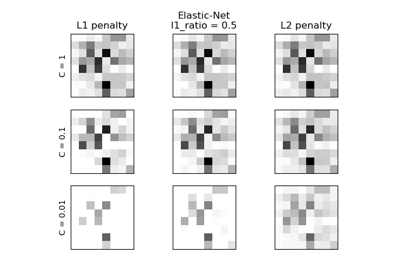

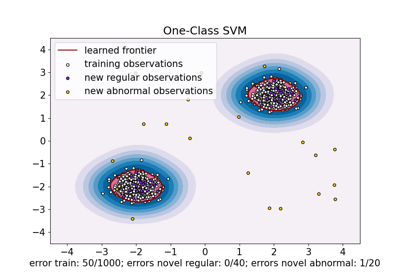

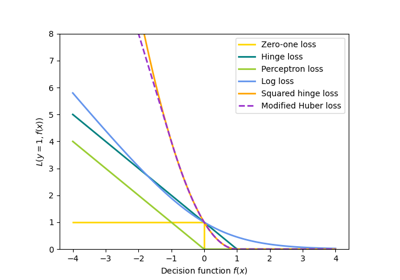

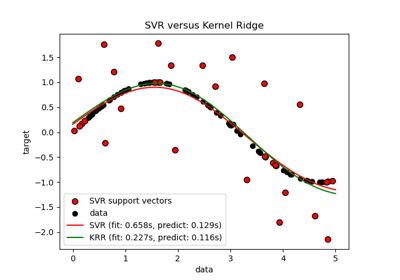

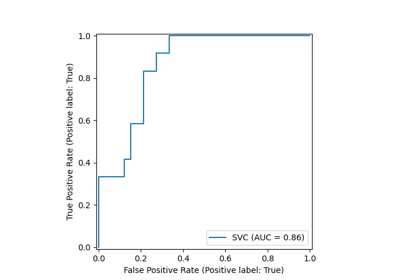

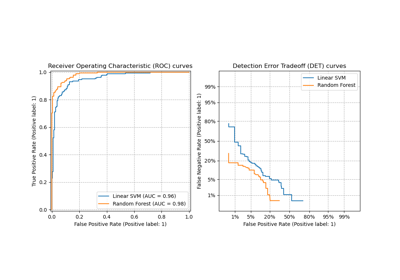

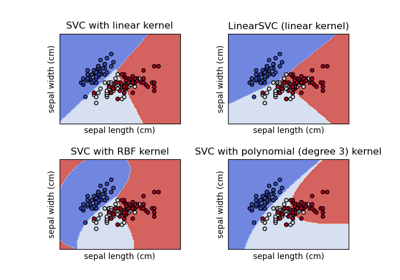

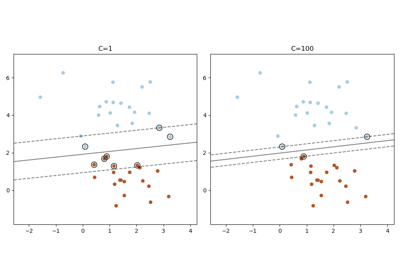

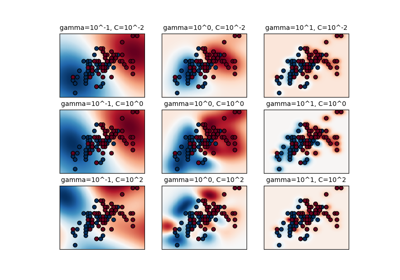

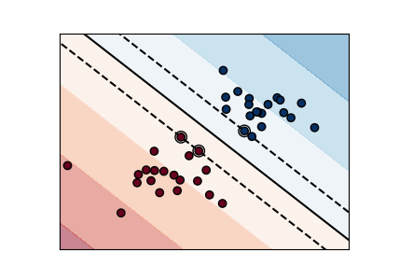

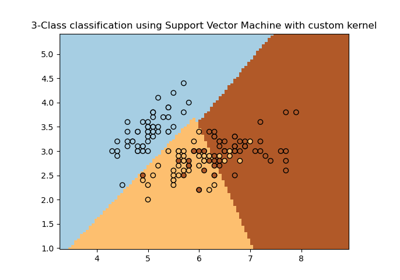

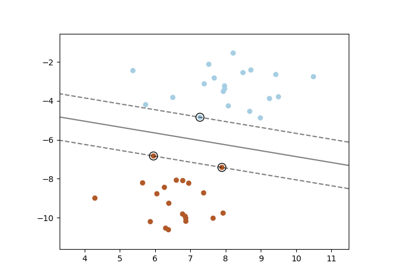

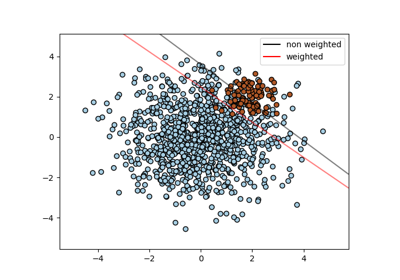

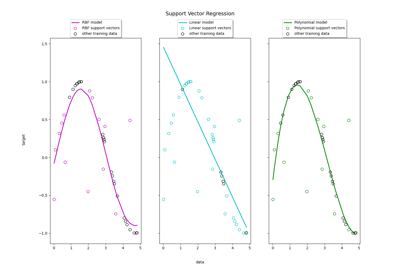

支持向量机#

关于 sklearn.svm 模块的示例。

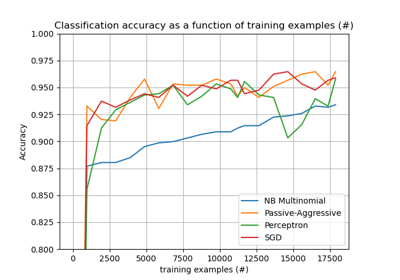

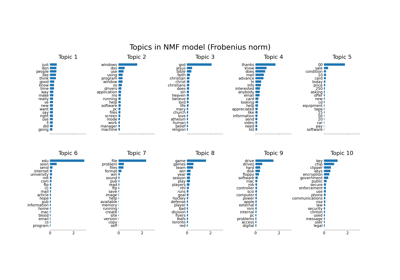

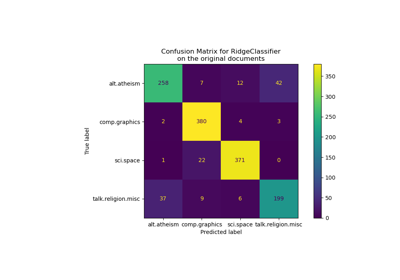

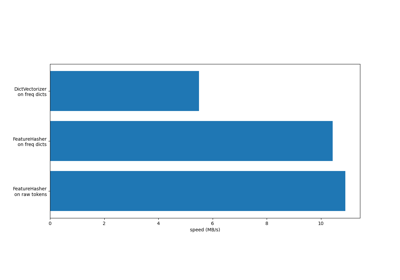

处理文本文档#

关于 sklearn.feature_extraction.text 模块的示例。