注意

前往末尾下载完整示例代码,或通过 JupyterLite 或 Binder 在浏览器中运行此示例

稳健协方差估计和马氏距离的重要性#

本示例展示了在高斯分布数据上使用马氏距离进行协方差估计。

对于高斯分布数据,观测值 \(x_i\) 到分布众数的距离可以使用其马氏距离计算:

其中 \(\mu\) 和 \(\Sigma\) 分别是底层高斯分布的位置和协方差。

在实践中,\(\mu\) 和 \(\Sigma\) 会被一些估计值取代。标准协方差最大似然估计 (MLE) 对数据集中异常值的存在非常敏感,因此,由此产生的马氏距离也会受到影响。最好使用稳健的协方差估计器,以确保估计对数据集中的“错误”观测值具有抵抗力,并且计算出的马氏距离能准确反映观测值的真实组织结构。

最小协方差行列式估计器 (MCD) 是一种稳健的、高击穿点(即,它可用于估计高度污染数据集的协方差矩阵,最多可处理 \(\frac{n_\text{samples}-n_\text{features}-1}{2}\) 个异常值)协方差估计器。MCD 的思想是找到 \(\frac{n_\text{samples}+n_\text{features}+1}{2}\) 个经验协方差具有最小行列式的观测值,从而获得一个“纯净”的观测子集,用于计算位置和协方差的标准估计。MCD 由 P.J.Rousseuw 在 [1] 中提出。

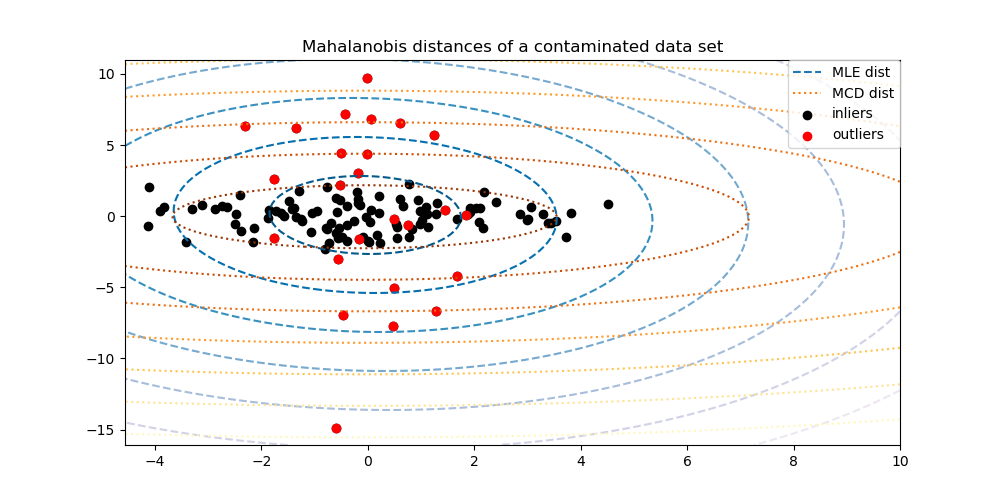

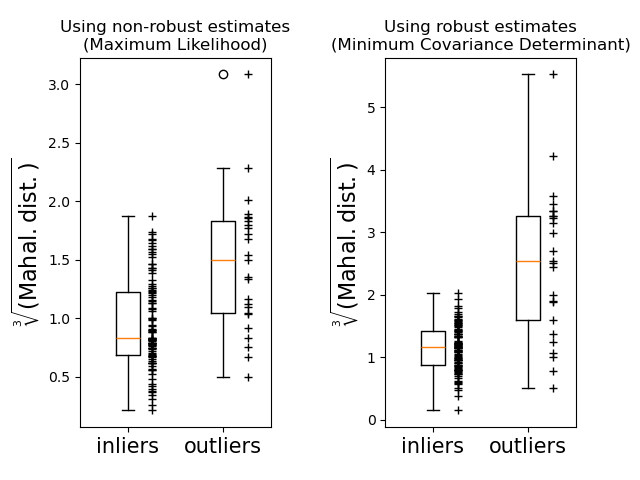

本示例阐述了马氏距离如何受异常数据影响。当使用基于标准协方差 MLE 的马氏距离时,从污染分布中提取的观测值与来自真实高斯分布的观测值无法区分。而使用基于 MCD 的马氏距离,两个群体变得可区分。相关应用包括异常值检测、观测值排序和聚类。

注意

另请参阅 稳健协方差估计对比经验协方差估计

参考文献

# Authors: The scikit-learn developers

# SPDX-License-Identifier: BSD-3-Clause

生成数据#

首先,我们生成一个包含 125 个样本和 2 个特征的数据集。两个特征都是均值为 0 的高斯分布,但特征 1 的标准差为 2,特征 2 的标准差为 1。接下来,25 个样本被替换为高斯异常值样本,其中特征 1 的标准差为 1,特征 2 的标准差为 7。

import numpy as np

# for consistent results

np.random.seed(7)

n_samples = 125

n_outliers = 25

n_features = 2

# generate Gaussian data of shape (125, 2)

gen_cov = np.eye(n_features)

gen_cov[0, 0] = 2.0

X = np.dot(np.random.randn(n_samples, n_features), gen_cov)

# add some outliers

outliers_cov = np.eye(n_features)

outliers_cov[np.arange(1, n_features), np.arange(1, n_features)] = 7.0

X[-n_outliers:] = np.dot(np.random.randn(n_outliers, n_features), outliers_cov)

结果比较#

下面,我们使用 MCD 和基于 MLE 的协方差估计器拟合我们的数据,并打印估计的协方差矩阵。请注意,基于 MLE 的估计器对特征 2 的估计方差(7.5)远高于 MCD 稳健估计器(1.2)。这表明基于 MCD 的稳健估计器对异常值样本的抵抗力更强,这些异常值样本被设计为在特征 2 中具有更大的方差。

import matplotlib.pyplot as plt

from sklearn.covariance import EmpiricalCovariance, MinCovDet

# fit a MCD robust estimator to data

robust_cov = MinCovDet().fit(X)

# fit a MLE estimator to data

emp_cov = EmpiricalCovariance().fit(X)

print(

"Estimated covariance matrix:\nMCD (Robust):\n{}\nMLE:\n{}".format(

robust_cov.covariance_, emp_cov.covariance_

)

)

Estimated covariance matrix:

MCD (Robust):

[[ 3.26253567e+00 -3.06695631e-03]

[-3.06695631e-03 1.22747343e+00]]

MLE:

[[ 3.23773583 -0.24640578]

[-0.24640578 7.51963999]]

为了更好地可视化差异,我们绘制了两种方法计算的马氏距离等高线。请注意,稳健的基于 MCD 的马氏距离与内部黑色点拟合得更好,而基于 MLE 的距离更容易受到外部红色点的影响。

import matplotlib.lines as mlines

fig, ax = plt.subplots(figsize=(10, 5))

# Plot data set

inlier_plot = ax.scatter(X[:, 0], X[:, 1], color="black", label="inliers")

outlier_plot = ax.scatter(

X[:, 0][-n_outliers:], X[:, 1][-n_outliers:], color="red", label="outliers"

)

ax.set_xlim(ax.get_xlim()[0], 10.0)

ax.set_title("Mahalanobis distances of a contaminated data set")

# Create meshgrid of feature 1 and feature 2 values

xx, yy = np.meshgrid(

np.linspace(plt.xlim()[0], plt.xlim()[1], 100),

np.linspace(plt.ylim()[0], plt.ylim()[1], 100),

)

zz = np.c_[xx.ravel(), yy.ravel()]

# Calculate the MLE based Mahalanobis distances of the meshgrid

mahal_emp_cov = emp_cov.mahalanobis(zz)

mahal_emp_cov = mahal_emp_cov.reshape(xx.shape)

emp_cov_contour = plt.contour(

xx, yy, np.sqrt(mahal_emp_cov), cmap=plt.cm.PuBu_r, linestyles="dashed"

)

# Calculate the MCD based Mahalanobis distances

mahal_robust_cov = robust_cov.mahalanobis(zz)

mahal_robust_cov = mahal_robust_cov.reshape(xx.shape)

robust_contour = ax.contour(

xx, yy, np.sqrt(mahal_robust_cov), cmap=plt.cm.YlOrBr_r, linestyles="dotted"

)

# Add legend

ax.legend(

[

mlines.Line2D([], [], color="tab:blue", linestyle="dashed"),

mlines.Line2D([], [], color="tab:orange", linestyle="dotted"),

inlier_plot,

outlier_plot,

],

["MLE dist", "MCD dist", "inliers", "outliers"],

loc="upper right",

borderaxespad=0,

)

plt.show()

最后,我们强调了基于 MCD 的马氏距离区分异常值的能力。我们取马氏距离的立方根,得到近似正态分布(如 Wilson 和 Hilferty [2] 所建议),然后用箱线图绘制内部样本和异常值样本的值。对于基于 MCD 的稳健马氏距离,异常值样本的分布与内部样本的分布分离度更高。

fig, (ax1, ax2) = plt.subplots(1, 2)

plt.subplots_adjust(wspace=0.6)

# Calculate cubic root of MLE Mahalanobis distances for samples

emp_mahal = emp_cov.mahalanobis(X - np.mean(X, 0)) ** (0.33)

# Plot boxplots

ax1.boxplot([emp_mahal[:-n_outliers], emp_mahal[-n_outliers:]], widths=0.25)

# Plot individual samples

ax1.plot(

np.full(n_samples - n_outliers, 1.26),

emp_mahal[:-n_outliers],

"+k",

markeredgewidth=1,

)

ax1.plot(np.full(n_outliers, 2.26), emp_mahal[-n_outliers:], "+k", markeredgewidth=1)

ax1.axes.set_xticklabels(("inliers", "outliers"), size=15)

ax1.set_ylabel(r"$\sqrt[3]{\rm{(Mahal. dist.)}}$", size=16)

ax1.set_title("Using non-robust estimates\n(Maximum Likelihood)")

# Calculate cubic root of MCD Mahalanobis distances for samples

robust_mahal = robust_cov.mahalanobis(X - robust_cov.location_) ** (0.33)

# Plot boxplots

ax2.boxplot([robust_mahal[:-n_outliers], robust_mahal[-n_outliers:]], widths=0.25)

# Plot individual samples

ax2.plot(

np.full(n_samples - n_outliers, 1.26),

robust_mahal[:-n_outliers],

"+k",

markeredgewidth=1,

)

ax2.plot(np.full(n_outliers, 2.26), robust_mahal[-n_outliers:], "+k", markeredgewidth=1)

ax2.axes.set_xticklabels(("inliers", "outliers"), size=15)

ax2.set_ylabel(r"$\sqrt[3]{\rm{(Mahal. dist.)}}$", size=16)

ax2.set_title("Using robust estimates\n(Minimum Covariance Determinant)")

plt.show()

脚本总运行时间: (0 分 0.259 秒)

相关示例