注意

转到末尾 下载完整示例代码。或者通过 JupyterLite 或 Binder 在浏览器中运行此示例

人脸数据集分解#

本示例将 Olivetti 人脸数据集 应用于模块 sklearn.decomposition 中不同的无监督矩阵分解(降维)方法(详见文档章节 将信号分解为分量(矩阵分解问题))。

# Authors: The scikit-learn developers

# SPDX-License-Identifier: BSD-3-Clause

数据集准备#

加载并预处理 Olivetti 人脸数据集。

import logging

import matplotlib.pyplot as plt

from numpy.random import RandomState

from sklearn import cluster, decomposition

from sklearn.datasets import fetch_olivetti_faces

rng = RandomState(0)

# Display progress logs on stdout

logging.basicConfig(level=logging.INFO, format="%(asctime)s %(levelname)s %(message)s")

faces, _ = fetch_olivetti_faces(return_X_y=True, shuffle=True, random_state=rng)

n_samples, n_features = faces.shape

# Global centering (focus on one feature, centering all samples)

faces_centered = faces - faces.mean(axis=0)

# Local centering (focus on one sample, centering all features)

faces_centered -= faces_centered.mean(axis=1).reshape(n_samples, -1)

print("Dataset consists of %d faces" % n_samples)

Dataset consists of 400 faces

定义一个基本函数来绘制人脸图库。

n_row, n_col = 2, 3

n_components = n_row * n_col

image_shape = (64, 64)

def plot_gallery(title, images, n_col=n_col, n_row=n_row, cmap=plt.cm.gray):

fig, axs = plt.subplots(

nrows=n_row,

ncols=n_col,

figsize=(2.0 * n_col, 2.3 * n_row),

facecolor="white",

constrained_layout=True,

)

fig.set_constrained_layout_pads(w_pad=0.01, h_pad=0.02, hspace=0, wspace=0)

fig.set_edgecolor("black")

fig.suptitle(title, size=16)

for ax, vec in zip(axs.flat, images):

vmax = max(vec.max(), -vec.min())

im = ax.imshow(

vec.reshape(image_shape),

cmap=cmap,

interpolation="nearest",

vmin=-vmax,

vmax=vmax,

)

ax.axis("off")

fig.colorbar(im, ax=axs, orientation="horizontal", shrink=0.99, aspect=40, pad=0.01)

plt.show()

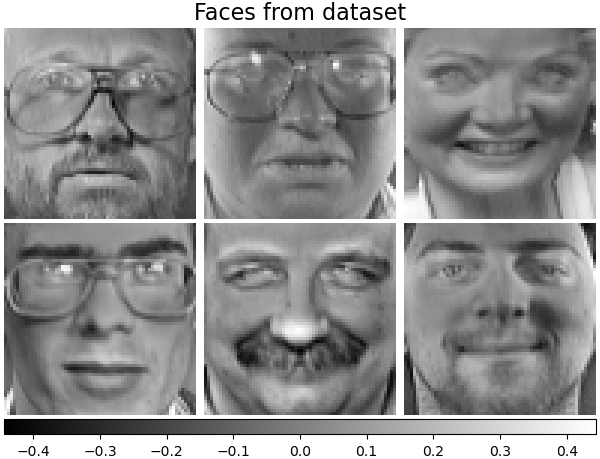

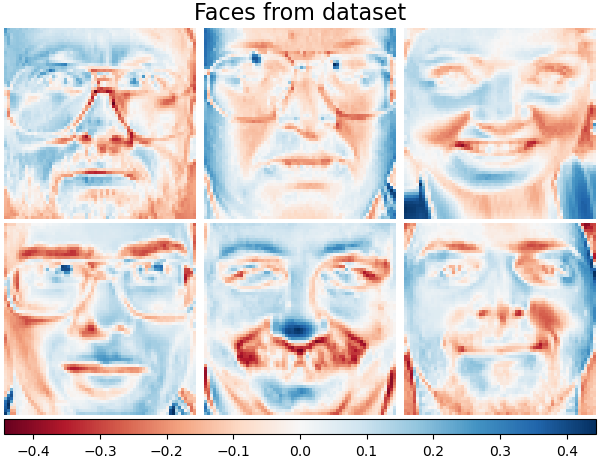

让我们看一下我们的数据。灰色表示负值,白色表示正值。

plot_gallery("Faces from dataset", faces_centered[:n_components])

分解#

初始化不同的分解估计器,并在所有图像上拟合每个估计器并绘制一些结果。每个估计器提取 6 个分量作为向量 \(h \in \mathbb{R}^{4096}\)。我们只是将这些向量以 64x64 像素图像的形式友好地可视化。

更多内容请参阅用户指南。

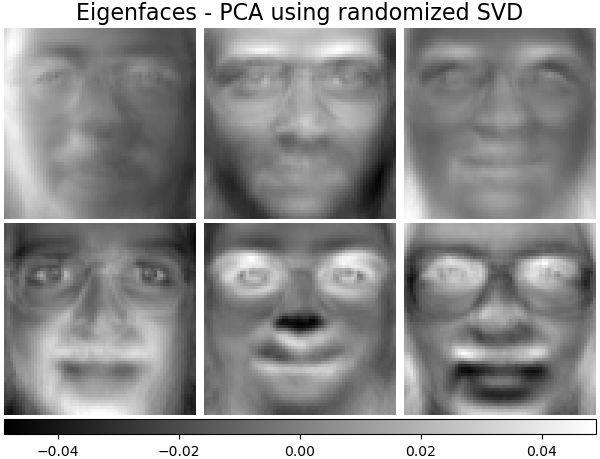

特征脸 - 使用随机 SVD 的 PCA#

使用数据的奇异值分解(SVD)进行线性降维,将其投影到较低维空间。

注意

特征脸估计器通过 sklearn.decomposition.PCA 还提供了一个标量 noise_variance_(像素级方差的均值),该值无法显示为图像。

pca_estimator = decomposition.PCA(

n_components=n_components, svd_solver="randomized", whiten=True

)

pca_estimator.fit(faces_centered)

plot_gallery(

"Eigenfaces - PCA using randomized SVD", pca_estimator.components_[:n_components]

)

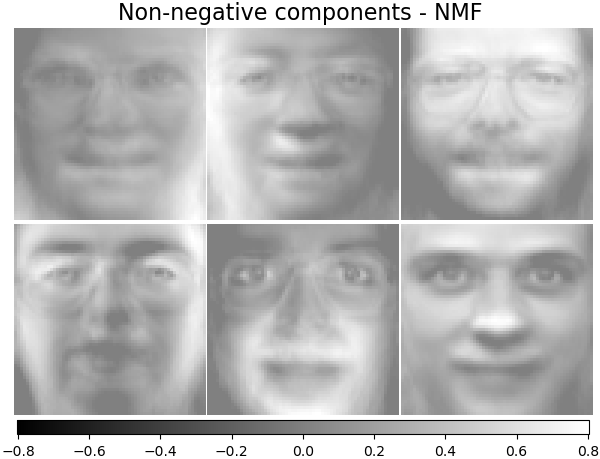

非负分量 - NMF#

将非负原始数据估计为两个非负矩阵的乘积。

nmf_estimator = decomposition.NMF(n_components=n_components, tol=5e-3)

nmf_estimator.fit(faces) # original non- negative dataset

plot_gallery("Non-negative components - NMF", nmf_estimator.components_[:n_components])

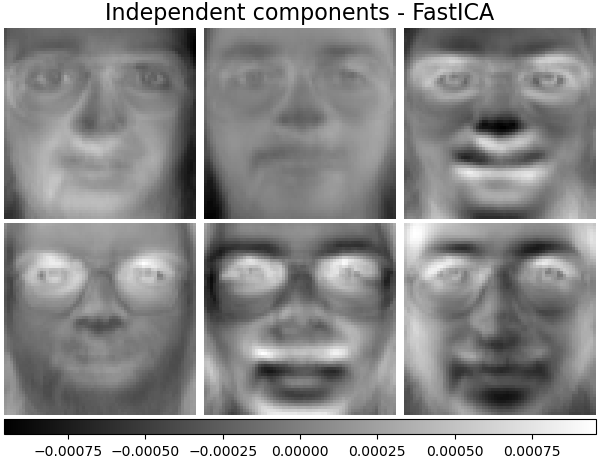

独立分量 - FastICA#

独立分量分析将多元向量分离为最大独立加性子分量。

ica_estimator = decomposition.FastICA(

n_components=n_components, max_iter=400, whiten="arbitrary-variance", tol=15e-5

)

ica_estimator.fit(faces_centered)

plot_gallery(

"Independent components - FastICA", ica_estimator.components_[:n_components]

)

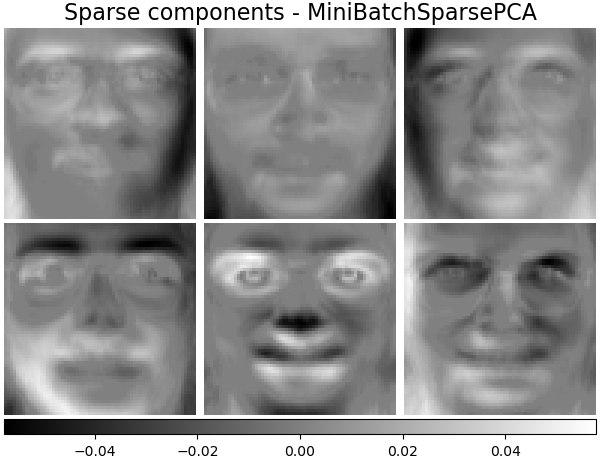

稀疏分量 - MiniBatchSparsePCA#

Mini-batch 稀疏 PCA (MiniBatchSparsePCA) 提取最能重建数据的稀疏分量集。该变体比类似的 SparsePCA 速度更快但准确性较低。

batch_pca_estimator = decomposition.MiniBatchSparsePCA(

n_components=n_components, alpha=0.1, max_iter=100, batch_size=3, random_state=rng

)

batch_pca_estimator.fit(faces_centered)

plot_gallery(

"Sparse components - MiniBatchSparsePCA",

batch_pca_estimator.components_[:n_components],

)

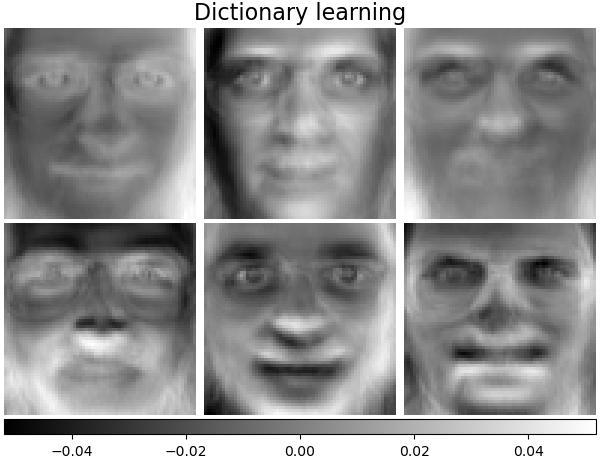

字典学习#

默认情况下,MiniBatchDictionaryLearning 将数据划分为 mini-batch,并通过对 mini-batch 进行指定次数的循环迭代来在线优化。

batch_dict_estimator = decomposition.MiniBatchDictionaryLearning(

n_components=n_components, alpha=0.1, max_iter=50, batch_size=3, random_state=rng

)

batch_dict_estimator.fit(faces_centered)

plot_gallery("Dictionary learning", batch_dict_estimator.components_[:n_components])

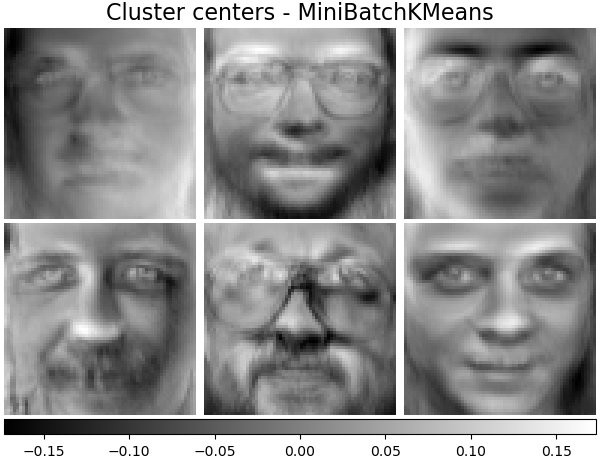

聚类中心 - MiniBatchKMeans#

sklearn.cluster.MiniBatchKMeans 计算高效,并通过 partial_fit 方法实现在线学习。因此,使用 MiniBatchKMeans 增强一些耗时算法可能会有所裨益。

kmeans_estimator = cluster.MiniBatchKMeans(

n_clusters=n_components,

tol=1e-3,

batch_size=20,

max_iter=50,

random_state=rng,

)

kmeans_estimator.fit(faces_centered)

plot_gallery(

"Cluster centers - MiniBatchKMeans",

kmeans_estimator.cluster_centers_[:n_components],

)

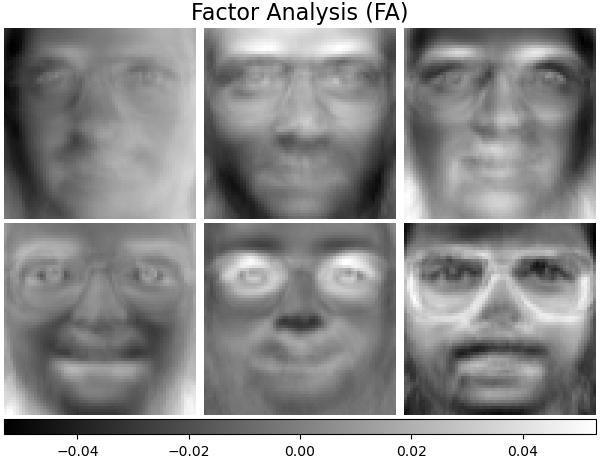

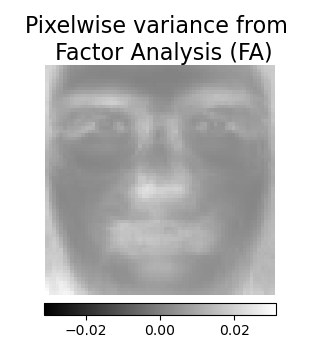

因子分析分量 - FA#

FactorAnalysis 与 PCA 类似,但其优势在于能够独立建模输入空间各个方向的方差(异方差噪声)。更多内容请参阅用户指南。

fa_estimator = decomposition.FactorAnalysis(n_components=n_components, max_iter=20)

fa_estimator.fit(faces_centered)

plot_gallery("Factor Analysis (FA)", fa_estimator.components_[:n_components])

# --- Pixelwise variance

plt.figure(figsize=(3.2, 3.6), facecolor="white", tight_layout=True)

vec = fa_estimator.noise_variance_

vmax = max(vec.max(), -vec.min())

plt.imshow(

vec.reshape(image_shape),

cmap=plt.cm.gray,

interpolation="nearest",

vmin=-vmax,

vmax=vmax,

)

plt.axis("off")

plt.title("Pixelwise variance from \n Factor Analysis (FA)", size=16, wrap=True)

plt.colorbar(orientation="horizontal", shrink=0.8, pad=0.03)

plt.show()

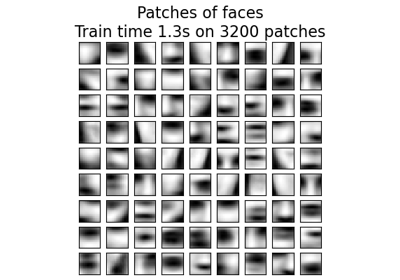

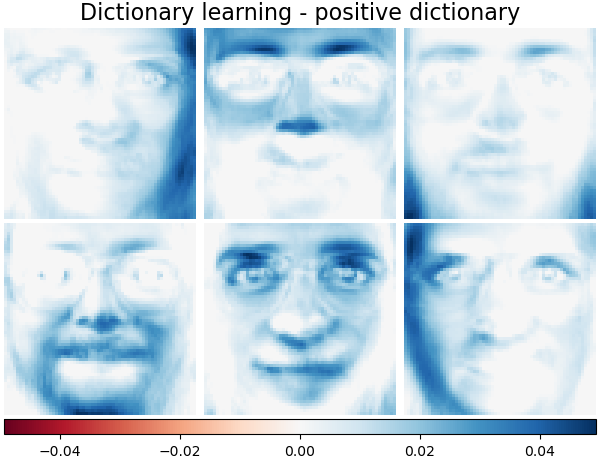

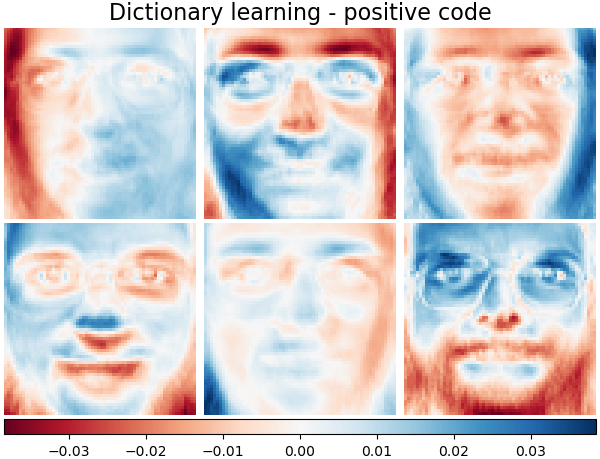

分解:字典学习#

在接下来的章节中,我们将更详细地讨论字典学习。字典学习是一个旨在将输入数据表示为简单元素组合的稀疏表示问题。这些简单元素构成一个字典。可以约束字典和/或编码系数为正,以匹配数据中可能存在的约束。

MiniBatchDictionaryLearning 实现了字典学习算法的更快但不太准确的版本,更适合大型数据集。更多内容请参阅用户指南。

绘制我们数据集中相同的样本,但使用不同的颜色映射。红色表示负值,蓝色表示正值,白色表示零。

plot_gallery("Faces from dataset", faces_centered[:n_components], cmap=plt.cm.RdBu)

与之前的示例类似,我们改变参数并在所有图像上训练 MiniBatchDictionaryLearning 估计器。通常,字典学习和稀疏编码将输入数据分解为字典矩阵和编码系数矩阵。\(X \approx UV\),其中 \(X = [x_1, . . . , x_n]\),\(X \in \mathbb{R}^{m×n}\),字典 \(U \in \mathbb{R}^{m×k}\),编码系数 \(V \in \mathbb{R}^{k×n}\)。

下面还显示了当字典和编码系数受正约束时的结果。

字典学习 - 正字典#

在以下部分中,我们在寻找字典时强制执行正性。

dict_pos_dict_estimator = decomposition.MiniBatchDictionaryLearning(

n_components=n_components,

alpha=0.1,

max_iter=50,

batch_size=3,

random_state=rng,

positive_dict=True,

)

dict_pos_dict_estimator.fit(faces_centered)

plot_gallery(

"Dictionary learning - positive dictionary",

dict_pos_dict_estimator.components_[:n_components],

cmap=plt.cm.RdBu,

)

字典学习 - 正编码#

下面我们将编码系数约束为正矩阵。

dict_pos_code_estimator = decomposition.MiniBatchDictionaryLearning(

n_components=n_components,

alpha=0.1,

max_iter=50,

batch_size=3,

fit_algorithm="cd",

random_state=rng,

positive_code=True,

)

dict_pos_code_estimator.fit(faces_centered)

plot_gallery(

"Dictionary learning - positive code",

dict_pos_code_estimator.components_[:n_components],

cmap=plt.cm.RdBu,

)

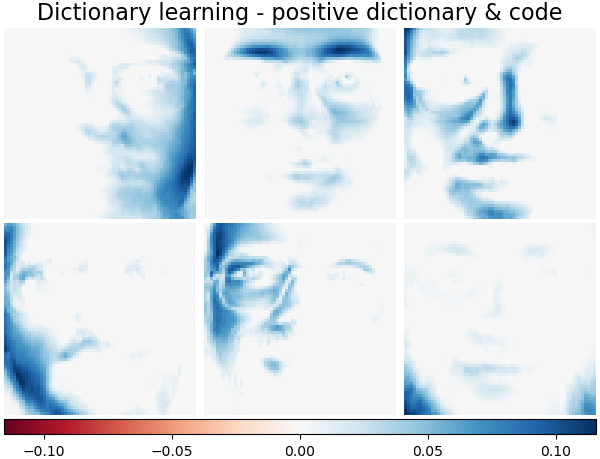

字典学习 - 正字典与正编码#

下面还显示了当字典值和编码系数都受正约束时的结果。

dict_pos_estimator = decomposition.MiniBatchDictionaryLearning(

n_components=n_components,

alpha=0.1,

max_iter=50,

batch_size=3,

fit_algorithm="cd",

random_state=rng,

positive_dict=True,

positive_code=True,

)

dict_pos_estimator.fit(faces_centered)

plot_gallery(

"Dictionary learning - positive dictionary & code",

dict_pos_estimator.components_[:n_components],

cmap=plt.cm.RdBu,

)

脚本总运行时间: (0 分 6.996 秒)

相关示例