MiniBatchSparsePCA#

- class sklearn.decomposition.MiniBatchSparsePCA(n_components=None, *, alpha=1, ridge_alpha=0.01, max_iter=1000, callback=None, batch_size=3, verbose=False, shuffle=True, n_jobs=None, method='lars', random_state=None, tol=0.001, max_no_improvement=10)[source]#

Mini-batch 稀疏主成分分析。

找到能够最优重建数据的稀疏分量集。稀疏程度可通过L1惩罚项系数(参数alpha)控制。

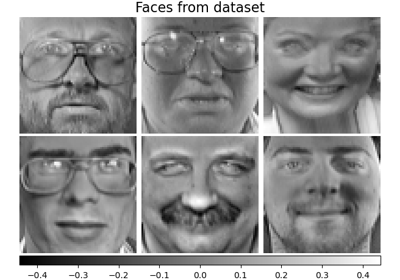

有关稀疏PCA与PCA比较的示例,请参阅 Faces dataset decompositions

在用户指南中了解更多信息。

- 参数:

- n_componentsint, default=None

要提取的稀疏原子数量。如果为None,则

n_components设置为n_features。- alphaint, default=1

稀疏性控制参数。值越高,分量越稀疏。

- ridge_alphafloat, default=0.01

在调用transform方法时,为改善条件应用L2正则化收缩的量。

- max_iterint, default=1_000

Maximum number of iterations over the complete dataset before stopping independently of any early stopping criterion heuristics.

1.2 版本新增。

- callbackcallable, default=None

每五次迭代调用一次的回调函数。

- batch_sizeint, default=3

每个mini batch中要获取的特征数量。

- verboseint or bool, default=False

控制详细程度;值越高,消息越多。默认为0。

- shufflebool, default=True

在将数据分成批次之前是否进行打乱。

- n_jobsint, default=None

要并行运行的作业数量。

None表示 1,除非在joblib.parallel_backend上下文中。-1表示使用所有处理器。有关更多详细信息,请参阅词汇表。- method{‘lars’, ‘cd’}, default=’lars’

用于优化的方法。lars:使用最小角回归方法解决lasso问题(linear_model.lars_path)。cd:使用坐标下降方法计算Lasso解(linear_model.Lasso)。如果估计的分量是稀疏的,Lars会更快。

- random_stateint, RandomState instance or None, default=None

当

shuffle设置为True时,在在线字典学习期间用于随机打乱。传入一个整数可以在多次函数调用中获得可重现的结果。参见 Glossary。- tolfloat, default=1e-3

根据两次迭代之间字典差异的范数控制提前停止。

要禁用基于字典更改的提前停止,请将

tol设置为 0.0。版本 1.1 中新增。

- max_no_improvementint or None, default=10

根据连续的 mini batch 数量控制提前停止,这些 mini batch 对平滑成本函数没有改进。

要禁用基于成本函数的收敛检测,请将

max_no_improvement设置为None。版本 1.1 中新增。

- 属性:

- components_ndarray of shape (n_components, n_features)

从数据中提取的稀疏分量。

- n_components_int

估计的分量数量。

0.23 版本新增。

- n_iter_int

运行的迭代次数。

- mean_shape 为 (n_features,) 的 ndarray

每个特征的经验均值,从训练集估计。等于

X.mean(axis=0)。- n_features_in_int

在 拟合 期间看到的特征数。

0.24 版本新增。

- feature_names_in_shape 为 (

n_features_in_,) 的 ndarray 在 fit 期间看到的特征名称。仅当

X具有全部为字符串的特征名称时才定义。1.0 版本新增。

另请参阅

DictionaryLearning查找一个稀疏编码数据的字典。

IncrementalPCA增量主成分分析。

PCA主成分分析。

SparsePCA稀疏主成分分析。

TruncatedSVD使用截断 SVD 进行降维。

示例

>>> import numpy as np >>> from sklearn.datasets import make_friedman1 >>> from sklearn.decomposition import MiniBatchSparsePCA >>> X, _ = make_friedman1(n_samples=200, n_features=30, random_state=0) >>> transformer = MiniBatchSparsePCA(n_components=5, batch_size=50, ... max_iter=10, random_state=0) >>> transformer.fit(X) MiniBatchSparsePCA(...) >>> X_transformed = transformer.transform(X) >>> X_transformed.shape (200, 5) >>> # most values in the components_ are zero (sparsity) >>> np.mean(transformer.components_ == 0) np.float64(0.9)

- fit(X, y=None)[source]#

根据 X 中的数据拟合模型。

- 参数:

- Xshape 为 (n_samples, n_features) 的 array-like

训练向量,其中

n_samples是样本数,n_features是特征数。- y被忽略

Not used, present here for API consistency by convention.

- 返回:

- selfobject

返回实例本身。

- fit_transform(X, y=None, **fit_params)[source]#

拟合数据,然后对其进行转换。

使用可选参数

fit_params将转换器拟合到X和y,并返回X的转换版本。- 参数:

- Xshape 为 (n_samples, n_features) 的 array-like

输入样本。

- y形状为 (n_samples,) 或 (n_samples, n_outputs) 的类数组对象,默认=None

目标值(对于无监督转换,为 None)。

- **fit_paramsdict

额外的拟合参数。仅当估计器在其

fit方法中接受额外的参数时才传递。

- 返回:

- X_newndarray array of shape (n_samples, n_features_new)

转换后的数组。

- get_feature_names_out(input_features=None)[source]#

获取转换的输出特征名称。

The feature names out will prefixed by the lowercased class name. For example, if the transformer outputs 3 features, then the feature names out are:

["class_name0", "class_name1", "class_name2"].- 参数:

- input_featuresarray-like of str or None, default=None

Only used to validate feature names with the names seen in

fit.

- 返回:

- feature_names_outstr 对象的 ndarray

转换后的特征名称。

- get_metadata_routing()[source]#

获取此对象的元数据路由。

请查阅 用户指南,了解路由机制如何工作。

- 返回:

- routingMetadataRequest

封装路由信息的

MetadataRequest。

- get_params(deep=True)[source]#

获取此估计器的参数。

- 参数:

- deepbool, default=True

如果为 True,将返回此估计器以及包含的子对象(如果它们是估计器)的参数。

- 返回:

- paramsdict

参数名称映射到其值。

- inverse_transform(X)[source]#

将数据从潜在空间转换回原始空间。

由于正向分解引起的信息丢失,这种反演是一种近似。

1.2 版本新增。

- 参数:

- Xshape为(n_samples, n_components)的ndarray

潜在空间中的数据。

- 返回:

- X_original形状为 (n_samples, n_features) 的 ndarray

重建后的原始空间中的数据。

- set_output(*, transform=None)[source]#

设置输出容器。

有关如何使用 API 的示例,请参阅引入 set_output API。

- 参数:

- transform{“default”, “pandas”, “polars”}, default=None

配置

transform和fit_transform的输出。"default": 转换器的默认输出格式"pandas": DataFrame 输出"polars": Polars 输出None: 转换配置保持不变

1.4 版本新增: 添加了

"polars"选项。

- 返回:

- selfestimator instance

估计器实例。