DecisionTreeClassifier#

- class sklearn.tree.DecisionTreeClassifier(*, criterion='gini', splitter='best', max_depth=None, min_samples_split=2, min_samples_leaf=1, min_weight_fraction_leaf=0.0, max_features=None, random_state=None, max_leaf_nodes=None, min_impurity_decrease=0.0, class_weight=None, ccp_alpha=0.0, monotonic_cst=None)[source]#

决策树分类器。

更多信息请参阅 用户指南。

- 参数:

- criterion{“gini”, “entropy”, “log_loss”}, default=”gini”

用于衡量划分质量的函数。支持的准则包括用于基尼不纯度(Gini impurity)的“gini”以及用于香农信息增益(Shannon information gain)的“log_loss”和“entropy”,详见数学公式。

- splitter{“best”, “random”}, default=”best”

用于在每个节点处选择分割点的策略。支持的策略有“best”(选择最佳分割点)和“random”(选择最佳随机分割点)。

- max_depthint, default=None

树的最大深度。如果为None,则节点会扩展直到所有叶子都是纯的,或者直到所有叶子包含的样本数少于 min_samples_split。

- min_samples_splitint or float, default=2

分割内部节点所需的最小样本数。

如果为 int,则将

min_samples_split视为最小数量。如果为 float,则

min_samples_split是一个分数,ceil(min_samples_split * n_samples)是每次分割的最小样本数。

版本 0.18 更改:添加了分数浮点值。

- min_samples_leafint or float, default=1

叶节点所需的最小样本数。只有当分割点在左右分支中都留下至少

min_samples_leaf个训练样本时,才会考虑该分割点。这可能具有平滑模型的效果,尤其是在回归中。如果为 int,则将

min_samples_leaf视为最小数量。如果为 float,则

min_samples_leaf是一个分数,ceil(min_samples_leaf * n_samples)是每个节点的最小样本数。

版本 0.18 更改:添加了分数浮点值。

- min_weight_fraction_leaffloat, default=0.0

叶节点所需的总权重(所有输入样本的权重总和)的最小加权分数。如果未提供 sample_weight,则样本具有相等的权重。

- max_featuresint, float or {“sqrt”, “log2”}, default=None

寻找最佳分割时要考虑的特征数量。

如果为 int,则在每次分割时考虑

max_features个特征。如果为 float,则

max_features是一个分数,max(1, int(max_features * n_features_in_))个特征在每次分割时被考虑。如果为 “sqrt”,则

max_features=sqrt(n_features)。如果为 “log2”,则

max_features=log2(n_features)。如果为 None,则

max_features=n_features。

注意

对划分的搜索不会停止,直到找到至少一个有效的节点样本划分,即使这需要实际检查超过

max_features个特征。- random_stateint, RandomState instance or None, default=None

控制估计器的随机性。特征在每次划分时总是随机排列的,即使

splitter设置为"best"。当max_features < n_features时,算法将在每次划分时随机选择max_features个特征,然后从中找出最佳划分。但是,即使max_features=n_features,找到的最佳划分也可能因运行而异。如果多个划分的准则改进值相同,并且必须随机选择一个划分,就会出现这种情况。要在拟合过程中获得确定性行为,random_state必须固定为整数。有关详细信息,请参阅词汇表。- max_leaf_nodesint, default=None

以最佳优先方式构建具有

max_leaf_nodes的树。最佳节点定义为杂质的相对减少。如果为 None,则表示叶子节点数量无限制。- min_impurity_decreasefloat, default=0.0

如果此分割导致的不纯度降低大于或等于此值,则该节点将被分割。

加权杂质减少方程如下

N_t / N * (impurity - N_t_R / N_t * right_impurity - N_t_L / N_t * left_impurity)

其中

N是样本总数,N_t是当前节点的样本数,N_t_L是左子节点中的样本数,N_t_R是右子节点中的样本数。如果传递了

sample_weight,则N、N_t、N_t_R和N_t_L都指的是加权和。Added in version 0.19.

- class_weightdict, list of dict or “balanced”, default=None

与类别相关的权重,形式为

{class_label: weight}。如果为 None,则所有类别都假定权重为一。对于多输出问题,可以按照 y 的列顺序提供一个字典列表。请注意,对于多输出(包括多标签),权重应针对每个列中的每个类别在各自的字典中定义。例如,对于四类多标签分类,权重应为 [{0: 1, 1: 1}, {0: 1, 1: 5}, {0: 1, 1: 1}, {0: 1, 1: 1}] 而不是 [{1:1}, {2:5}, {3:1}, {4:1}]。

“balanced”模式使用 y 的值根据输入数据中与类别频率成反比自动调整权重,计算公式为

n_samples / (n_classes * np.bincount(y))对于多输出,y 的每一列的权重将相乘。

请注意,如果指定了 sample_weight(通过 fit 方法传递),这些权重将与 sample_weight 相乘。

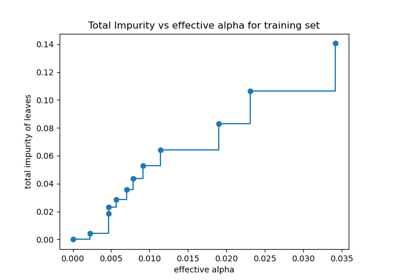

- ccp_alphanon-negative float, default=0.0

用于最小成本复杂性剪枝的复杂性参数。将选择具有大于

ccp_alpha的最大成本复杂性的子树。默认情况下,不执行剪枝。有关详细信息,请参阅最小成本复杂性剪枝。有关此类剪枝的示例,请参阅使用成本复杂性剪枝对决策树进行后剪枝。版本 0.22 新增。

- monotonic_cstarray-like of int of shape (n_features), default=None

- 指示要对每个特征施加的单调性约束。

1:单调增加

0:无约束

-1:单调减少

如果 monotonic_cst 为 None,则不应用任何约束。

- 单调性约束不支持以下情况:

多类别分类(即当

n_classes > 2时),多输出分类(即当

n_outputs_ > 1时),在具有缺失值的数据上训练的分类。

约束适用于正类的概率。

欲了解更多信息,请阅读 用户指南。

1.4 版本新增。

- 属性:

- classes_ndarray of shape (n_classes,) or list of ndarray

类别标签(单输出问题),或类别标签数组列表(多输出问题)。

feature_importances_ndarray of shape (n_features,)返回特征重要性。

- max_features_int

推断的 max_features 值。

- n_classes_int or list of int

类别数(对于单输出问题),或者是包含每个输出类别数的列表(对于多输出问题)。

- n_features_in_int

在 拟合 期间看到的特征数。

0.24 版本新增。

- feature_names_in_shape 为 (

n_features_in_,) 的 ndarray 在 fit 期间看到的特征名称。仅当

X具有全部为字符串的特征名称时才定义。1.0 版本新增。

- n_outputs_int

执行

fit时的输出数。- tree_Tree 实例

底层 Tree 对象。请参考

help(sklearn.tree._tree.Tree)来了解 Tree 对象的属性,以及 理解决策树结构 来了解这些属性的基本用法。

另请参阅

DecisionTreeRegressor决策树回归器。

注意事项

控制树大小的参数(例如

max_depth、min_samples_leaf等)的默认值会导致完全生长的、未剪枝的树,这在某些数据集上可能会非常大。为了减少内存消耗,应通过设置这些参数值来控制树的复杂性和大小。predict方法通过对predict_proba的输出使用numpy.argmax函数进行操作。这意味着如果最高预测概率并列,分类器将预测在 classes_ 中索引最低的并列类别。References

[2]L. Breiman, J. Friedman, R. Olshen, and C. Stone, “Classification and Regression Trees”, Wadsworth, Belmont, CA, 1984.

[3]T. Hastie, R. Tibshirani and J. Friedman. “Elements of Statistical Learning”, Springer, 2009.

[4]L. Breiman, and A. Cutler, “Random Forests”, https://www.stat.berkeley.edu/~breiman/RandomForests/cc_home.htm

示例

>>> from sklearn.datasets import load_iris >>> from sklearn.model_selection import cross_val_score >>> from sklearn.tree import DecisionTreeClassifier >>> clf = DecisionTreeClassifier(random_state=0) >>> iris = load_iris() >>> cross_val_score(clf, iris.data, iris.target, cv=10) ... ... array([ 1. , 0.93, 0.86, 0.93, 0.93, 0.93, 0.93, 1. , 0.93, 1. ])

- apply(X, check_input=True)[source]#

返回每个样本被预测为的叶子节点的索引。

版本0.17中新增。

- 参数:

- Xshape 为 (n_samples, n_features) 的 {array-like, sparse matrix}

输入样本。在内部,它将转换为

dtype=np.float32,如果提供了稀疏矩阵,则转换为稀疏的csr_matrix。- check_inputbool, default=True

允许绕过多项输入检查。除非您清楚自己在做什么,否则请勿使用此参数。

- 返回:

- X_leavesarray-like of shape (n_samples,)

对于 X 中的每个数据点 x,返回 x 最终所属叶节点的索引。叶子节点在

[0; self.tree_.node_count)范围内编号,可能存在编号间隙。

- cost_complexity_pruning_path(X, y, sample_weight=None)[source]#

在最小成本复杂度剪枝期间计算剪枝路径。

有关剪枝过程的详细信息,请参阅 最小成本复杂度剪枝。

- 参数:

- Xshape 为 (n_samples, n_features) 的 {array-like, sparse matrix}

训练输入样本。内部会转换为

dtype=np.float32,如果提供稀疏矩阵,则转换为稀疏csc_matrix。- yshape 为 (n_samples,) 或 (n_samples, n_outputs) 的 array-like

目标值(类标签),可以是整数或字符串。

- sample_weightshape 为 (n_samples,) 的 array-like, default=None

样本权重。如果为 None,则样本权重相等。在每个节点中搜索分割点时,会忽略会导致子节点净权重为零或负数的分割点。如果任何单个类在任一子节点中带有负权重,也会忽略这些分割点。

- 返回:

- ccp_path

Bunch Dictionary-like object, with the following attributes.

- ccp_alphasndarray

剪枝过程中子树的有效 alpha 值。

- impuritiesndarray

对应于

ccp_alphas中 alpha 值的子树叶子杂质之和。

- ccp_path

- decision_path(X, check_input=True)[source]#

返回树中的决策路径。

版本 0.18 新增。

- 参数:

- Xshape 为 (n_samples, n_features) 的 {array-like, sparse matrix}

输入样本。在内部,它将转换为

dtype=np.float32,如果提供了稀疏矩阵,则转换为稀疏的csr_matrix。- check_inputbool, default=True

允许绕过多项输入检查。除非您清楚自己在做什么,否则请勿使用此参数。

- 返回:

- indicatorsparse matrix of shape (n_samples, n_nodes)

返回一个节点指示器 CSR 矩阵,其中非零元素表示样本通过了这些节点。

- fit(X, y, sample_weight=None, check_input=True)[source]#

从训练集 (X, y) 构建决策树分类器。

- 参数:

- Xshape 为 (n_samples, n_features) 的 {array-like, sparse matrix}

训练输入样本。内部会转换为

dtype=np.float32,如果提供稀疏矩阵,则转换为稀疏csc_matrix。- yshape 为 (n_samples,) 或 (n_samples, n_outputs) 的 array-like

目标值(类标签),可以是整数或字符串。

- sample_weightshape 为 (n_samples,) 的 array-like, default=None

样本权重。如果为 None,则样本权重相等。在每个节点中搜索分割点时,会忽略会导致子节点净权重为零或负数的分割点。如果任何单个类在任一子节点中带有负权重,也会忽略这些分割点。

- check_inputbool, default=True

允许绕过多项输入检查。除非您清楚自己在做什么,否则请勿使用此参数。

- 返回:

- selfDecisionTreeClassifier

拟合的估计器。

- get_metadata_routing()[source]#

获取此对象的元数据路由。

请查阅 用户指南,了解路由机制如何工作。

- 返回:

- routingMetadataRequest

封装路由信息的

MetadataRequest。

- get_params(deep=True)[source]#

获取此估计器的参数。

- 参数:

- deepbool, default=True

如果为 True,将返回此估计器以及包含的子对象(如果它们是估计器)的参数。

- 返回:

- paramsdict

参数名称映射到其值。

- predict(X, check_input=True)[source]#

为 X 预测类别或回归值。

对于分类模型,返回 X 中每个样本的预测类别。对于回归模型,返回基于 X 的预测值。

- 参数:

- Xshape 为 (n_samples, n_features) 的 {array-like, sparse matrix}

输入样本。在内部,它将转换为

dtype=np.float32,如果提供了稀疏矩阵,则转换为稀疏的csr_matrix。- check_inputbool, default=True

允许绕过多项输入检查。除非您清楚自己在做什么,否则请勿使用此参数。

- 返回:

- yshape 为 (n_samples,) 或 (n_samples, n_outputs) 的 array-like

预测的类别或预测值。

- predict_log_proba(X)[source]#

预测输入样本 X 的类别对数概率。

- 参数:

- Xshape 为 (n_samples, n_features) 的 {array-like, sparse matrix}

输入样本。在内部,它将转换为

dtype=np.float32,如果提供了稀疏矩阵,则转换为稀疏的csr_matrix。

- 返回:

- probandarray of shape (n_samples, n_classes) or list of n_outputs such arrays if n_outputs > 1

输入样本的类别对数概率。类的顺序对应于属性 classes_ 中的顺序。

- predict_proba(X, check_input=True)[source]#

预测输入样本 X 的类别概率。

预测的类别概率是叶子节点中属于同一类别的样本比例。

- 参数:

- Xshape 为 (n_samples, n_features) 的 {array-like, sparse matrix}

输入样本。在内部,它将转换为

dtype=np.float32,如果提供了稀疏矩阵,则转换为稀疏的csr_matrix。- check_inputbool, default=True

允许绕过多项输入检查。除非您清楚自己在做什么,否则请勿使用此参数。

- 返回:

- probandarray of shape (n_samples, n_classes) or list of n_outputs such arrays if n_outputs > 1

输入样本的类别概率。类的顺序对应于属性 classes_ 中的顺序。

- score(X, y, sample_weight=None)[source]#

返回在提供的数据和标签上的 准确率 (accuracy)。

在多标签分类中,这是子集准确率 (subset accuracy),这是一个严格的指标,因为它要求每个样本的每个标签集都被正确预测。

- 参数:

- Xshape 为 (n_samples, n_features) 的 array-like

测试样本。

- yshape 为 (n_samples,) 或 (n_samples, n_outputs) 的 array-like

X的真实标签。- sample_weightshape 为 (n_samples,) 的 array-like, default=None

样本权重。

- 返回:

- scorefloat

self.predict(X)相对于y的平均准确率。

- set_fit_request(*, sample_weight: bool | None | str = '$UNCHANGED$') DecisionTreeClassifier[source]#

配置是否应请求元数据以传递给

fit方法。请注意,此方法仅在以下情况下相关:此估计器用作 元估计器 中的子估计器,并且通过

enable_metadata_routing=True启用了元数据路由(请参阅sklearn.set_config)。请查看 用户指南 以了解路由机制的工作原理。每个参数的选项如下:

True:请求元数据,如果提供则传递给fit。如果未提供元数据,则忽略该请求。False:不请求元数据,元估计器不会将其传递给fit。None:不请求元数据,如果用户提供元数据,元估计器将引发错误。str:应将元数据以给定别名而不是原始名称传递给元估计器。

默认值 (

sklearn.utils.metadata_routing.UNCHANGED) 保留现有请求。这允许您更改某些参数的请求而不更改其他参数。在版本 1.3 中新增。

- 参数:

- sample_weightstr, True, False, or None, default=sklearn.utils.metadata_routing.UNCHANGED

fit方法中sample_weight参数的元数据路由。

- 返回:

- selfobject

更新后的对象。

- set_params(**params)[source]#

设置此估计器的参数。

此方法适用于简单的估计器以及嵌套对象(如

Pipeline)。后者具有<component>__<parameter>形式的参数,以便可以更新嵌套对象的每个组件。- 参数:

- **paramsdict

估计器参数。

- 返回:

- selfestimator instance

估计器实例。

- set_score_request(*, sample_weight: bool | None | str = '$UNCHANGED$') DecisionTreeClassifier[source]#

配置是否应请求元数据以传递给

score方法。请注意,此方法仅在以下情况下相关:此估计器用作 元估计器 中的子估计器,并且通过

enable_metadata_routing=True启用了元数据路由(请参阅sklearn.set_config)。请查看 用户指南 以了解路由机制的工作原理。每个参数的选项如下:

True:请求元数据,如果提供则传递给score。如果未提供元数据,则忽略该请求。False:不请求元数据,元估计器不会将其传递给score。None:不请求元数据,如果用户提供元数据,元估计器将引发错误。str:应将元数据以给定别名而不是原始名称传递给元估计器。

默认值 (

sklearn.utils.metadata_routing.UNCHANGED) 保留现有请求。这允许您更改某些参数的请求而不更改其他参数。在版本 1.3 中新增。

- 参数:

- sample_weightstr, True, False, or None, default=sklearn.utils.metadata_routing.UNCHANGED

score方法中sample_weight参数的元数据路由。

- 返回:

- selfobject

更新后的对象。