注意

转到末尾 下载完整的示例代码或通过 JupyterLite 或 Binder 在浏览器中运行此示例。

RBF SVM 参数#

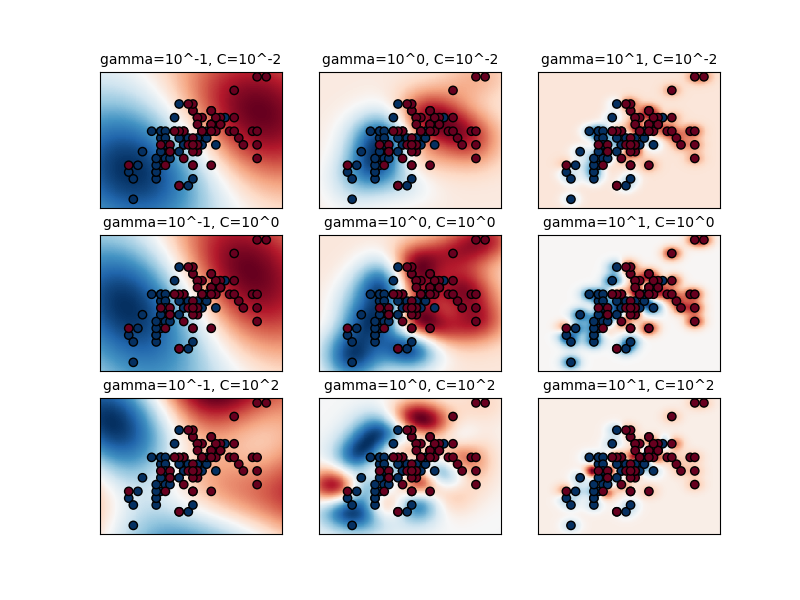

此示例说明了径向基函数(RBF)核 SVM 的参数 gamma 和 C 的影响。

直观地看,gamma 参数定义了单个训练示例的影响范围,低值表示“远”,高值表示“近”。gamma 参数可以看作是模型选择的支持向量样本影响半径的倒数。

C 参数权衡了训练示例的正确分类与决策函数边界的最大化。对于较大的 C 值,如果决策函数能更好地正确分类所有训练点,则会接受较小的边界。较低的 C 值会鼓励较大的边界,因此决策函数更简单,但代价是训练精度会降低。换句话说,C 在 SVM 中充当正则化参数。

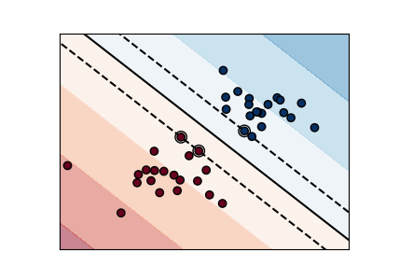

第一个图是在一个简化的分类问题上,针对各种参数值进行决策函数的可视化,该问题仅涉及 2 个输入特征和 2 个可能的类(二元分类)。请注意,对于具有更多特征或类的复杂问题,无法创建此类图表。

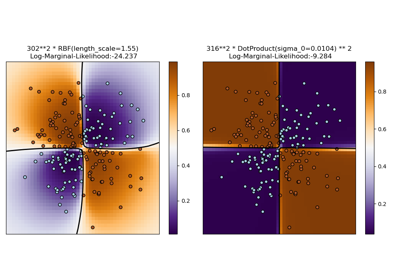

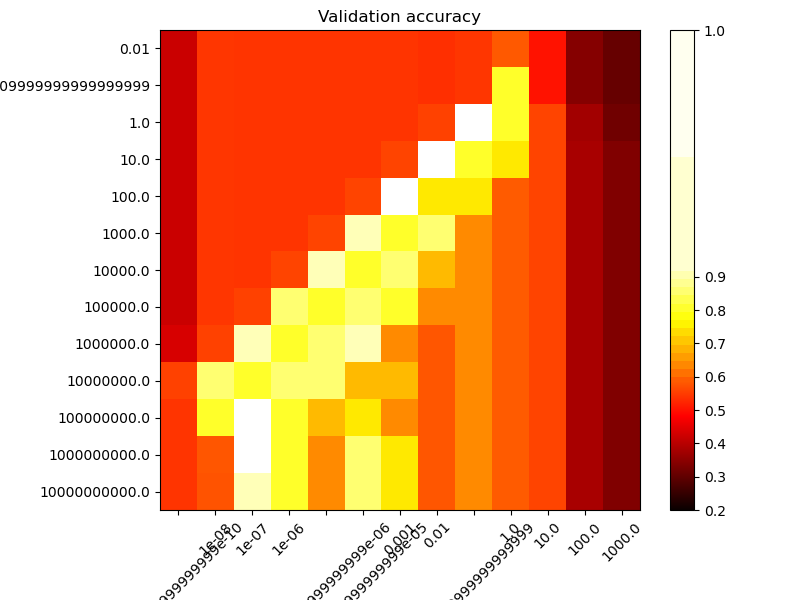

第二个图是分类器交叉验证精度随 C 和 gamma 变化的等高线图。在此示例中,我们为了说明目的探索了相对较大的网格。在实践中,从 \(10^{-3}\) 到 \(10^3\) 的对数网格通常就足够了。如果最佳参数位于网格边界上,则可以在后续搜索中沿该方向扩展网格。

请注意,等高线图有一个特殊的颜色条,其中点值接近性能最佳模型的得分值,以便一眼就能轻松区分它们。

模型的行为对 gamma 参数非常敏感。如果 gamma 太大,支持向量影响区域的半径将只包含支持向量本身,并且任何 C 值的正则化都无法阻止过拟合。

当 gamma 非常小时,模型受到太多约束,无法捕捉数据的复杂性或“形状”。任何选定支持向量的影响区域将包括整个训练集。由此产生的模型将类似于一个线性模型,其中有一组超平面将任意两个类的高密度中心分开。

对于中间值,我们可以在第二个图上看到,在 C 和 gamma 的对角线上可以找到好的模型。平滑模型(较低的 gamma 值)可以通过增加正确分类每个点的重要性(较大的 C 值)变得更复杂,因此出现了性能良好的模型对角线。

最后,还可以观察到,对于某些中间值的 gamma,当 C 变得非常大时,我们获得了性能相同的模型。这表明支持向量集不再改变。单独的 RBF 核半径充当了良好的结构正则化器。进一步增加 C 没有帮助,可能是因为不再有违反(在边界内或错误分类)的训练点,或者至少找不到更好的解决方案。在分数相同的情况下,使用较小的 C 值可能是有意义的,因为非常高的 C 值通常会增加拟合时间。

另一方面,较低的 C 值通常会导致更多的支持向量,这可能会增加预测时间。因此,降低 C 值涉及拟合时间和预测时间之间的权衡。

我们还应该注意,分数上的微小差异是交叉验证过程随机划分的结果。通过增加 CV 迭代次数 n_splits,可以消除这些虚假变化,但这会以计算时间为代价。增加 C_range 和 gamma_range 步数的值将增加超参数热图的分辨率。

# Authors: The scikit-learn developers

# SPDX-License-Identifier: BSD-3-Clause

用于将颜色映射的中点移动到感兴趣值附近的实用类。

import numpy as np

from matplotlib.colors import Normalize

class MidpointNormalize(Normalize):

def __init__(self, vmin=None, vmax=None, midpoint=None, clip=False):

self.midpoint = midpoint

Normalize.__init__(self, vmin, vmax, clip)

def __call__(self, value, clip=None):

x, y = [self.vmin, self.midpoint, self.vmax], [0, 0.5, 1]

return np.ma.masked_array(np.interp(value, x, y))

加载和准备数据集#

用于网格搜索的数据集

用于决策函数可视化的数据集:我们只保留 X 中的前两个特征并对数据集进行子采样,以仅保留 2 个类并使其成为二元分类问题。

X_2d = X[:, :2]

X_2d = X_2d[y > 0]

y_2d = y[y > 0]

y_2d -= 1

对于 SVM 训练,缩放数据通常是一个好主意。在此示例中,我们通过缩放所有数据来作弊,而不是在训练集上拟合变换并将其应用于测试集。

from sklearn.preprocessing import StandardScaler

scaler = StandardScaler()

X = scaler.fit_transform(X)

X_2d = scaler.fit_transform(X_2d)

训练分类器#

对于初始搜索,以 10 为底的对数网格通常很有帮助。使用 2 为底,可以实现更精细的调整,但成本更高。

from sklearn.model_selection import GridSearchCV, StratifiedShuffleSplit

from sklearn.svm import SVC

C_range = np.logspace(-2, 10, 13)

gamma_range = np.logspace(-9, 3, 13)

param_grid = dict(gamma=gamma_range, C=C_range)

cv = StratifiedShuffleSplit(n_splits=5, test_size=0.2, random_state=42)

grid = GridSearchCV(SVC(), param_grid=param_grid, cv=cv)

grid.fit(X, y)

print(

"The best parameters are %s with a score of %0.2f"

% (grid.best_params_, grid.best_score_)

)

The best parameters are {'C': np.float64(1.0), 'gamma': np.float64(0.1)} with a score of 0.97

现在我们需要为 2D 版本中的所有参数拟合一个分类器(此处我们使用较小的参数集,因为它需要一些时间来训练)

C_2d_range = [1e-2, 1, 1e2]

gamma_2d_range = [1e-1, 1, 1e1]

classifiers = []

for C in C_2d_range:

for gamma in gamma_2d_range:

clf = SVC(C=C, gamma=gamma)

clf.fit(X_2d, y_2d)

classifiers.append((C, gamma, clf))

可视化#

绘制参数效果的可视化

import matplotlib.pyplot as plt

plt.figure(figsize=(8, 6))

xx, yy = np.meshgrid(np.linspace(-3, 3, 200), np.linspace(-3, 3, 200))

for k, (C, gamma, clf) in enumerate(classifiers):

# evaluate decision function in a grid

Z = clf.decision_function(np.c_[xx.ravel(), yy.ravel()])

Z = Z.reshape(xx.shape)

# visualize decision function for these parameters

plt.subplot(len(C_2d_range), len(gamma_2d_range), k + 1)

plt.title("gamma=10^%d, C=10^%d" % (np.log10(gamma), np.log10(C)), size="medium")

# visualize parameter's effect on decision function

plt.pcolormesh(xx, yy, -Z, cmap=plt.cm.RdBu)

plt.scatter(X_2d[:, 0], X_2d[:, 1], c=y_2d, cmap=plt.cm.RdBu_r, edgecolors="k")

plt.xticks(())

plt.yticks(())

plt.axis("tight")

scores = grid.cv_results_["mean_test_score"].reshape(len(C_range), len(gamma_range))

绘制验证精度随 gamma 和 C 变化的等高线图

分数被编码为热颜色映射的颜色,从深红色到亮黄色不等。由于最有趣的分数都位于 0.92 到 0.97 范围内,我们使用自定义归一化器将中点设置为 0.92,以便更容易地可视化有趣范围内的分数值的微小变化,同时避免将所有低分数值粗暴地折叠到同一颜色。

plt.figure(figsize=(8, 6))

plt.subplots_adjust(left=0.2, right=0.95, bottom=0.15, top=0.95)

plt.imshow(

scores,

interpolation="nearest",

cmap=plt.cm.hot,

norm=MidpointNormalize(vmin=0.2, midpoint=0.92),

)

plt.xlabel("gamma")

plt.ylabel("C")

plt.colorbar()

plt.xticks(np.arange(len(gamma_range)), gamma_range, rotation=45)

plt.yticks(np.arange(len(C_range)), C_range)

plt.title("Validation accuracy")

plt.show()

脚本总运行时间: (0 minutes 4.772 seconds)

相关示例