召回率得分#

- sklearn.metrics.recall_score(y_true, y_pred, *, labels=None, pos_label=1, average='binary', sample_weight=None, zero_division='warn')[source]#

计算召回率。

召回率是比率

tp / (tp + fn),其中tp是真阳性的数量,fn是假阴性的数量。召回率直观地表示分类器找到所有正样本的能力。最佳值为 1,最差值为 0。

对超出术语范围的支持:

binary目标是通过将多类别和多标签数据视为每个标签的一个二元问题的集合来实现的。对于二元情况,设置average='binary'将返回pos_label的召回率。如果average不是'binary',则忽略pos_label,计算两个类别的召回率然后取平均值或返回两者(当average=None时)。类似地,对于多类别和多标签目标,所有labels的召回率将根据average参数返回平均值或单独返回。使用labels指定要计算召回率的标签集。在用户指南中了解更多信息。

- 参数:

- y_true一维类数组,或标签指示符数组/稀疏矩阵

真实(正确)目标值。

- y_pred一维类数组,或标签指示符数组/稀疏矩阵

分类器返回的估计目标。

- labels类数组,默认值=None

当

average != 'binary'时要包含的标签集,以及当average is None时的顺序。数据中存在的标签可以被排除,例如在多类别分类中排除“负类”。数据中不存在的标签可以包含在内,并将被分配0个样本。对于多标签目标,标签是列索引。默认情况下,y_true和y_pred中所有标签都按排序顺序使用。0.17 版本中的变更: 参数

labels针对多类别问题进行了改进。- pos_label整数、浮点数、布尔值或字符串,默认值=1

如果

average='binary'且数据为二元数据,则报告的类别;否则忽略此参数。对于多类别或多标签目标,设置labels=[pos_label]和average != 'binary'以仅报告一个标签的指标。- average{'micro','macro','samples','weighted','binary'} 或 None,默认值='binary'

此参数对于多类别/多标签目标是必需的。如果为

None,则返回每个类别的指标。否则,这将确定对数据执行的平均类型。'binary':仅报告

pos_label指定的类别的结果。只有当目标(y_{true,pred})为二元时才适用。'micro':通过计算总真阳性、假阴性和假阳性来全局计算指标。

'macro':计算每个标签的指标,并找到它们的未加权平均值。这不会考虑标签不平衡。

'weighted':计算每个标签的指标,并找到它们通过支持(每个标签的真实实例数)加权的平均值。这改变了“macro”以考虑标签不平衡;它可能导致 F 分数不在精确率和召回率之间。加权召回率等于准确率。

'samples':计算每个实例的指标,并找到它们的平均值(仅对于多标签分类有意义,在这种情况下它与

accuracy_score不同)。

- sample_weight形状为 (n_samples,) 的类数组,默认值=None

样本权重。

- zero_division{'warn',0.0,1.0,np.nan},默认值='warn'

设置当出现零除法时返回的值。

备注

如果设置为“warn”,则其作用类似于 0,但也会引发警告。

如果设置为

np.nan,则此类值将从平均值中排除。

1.3 版本中添加: 添加了

np.nan选项。

- 返回值:

- recall浮点数(如果 average 不为 None)或形状为 (n_unique_labels,) 的浮点数数组

二元分类中正类的召回率,或多类别任务中每个类的召回率的加权平均值。

另请参见

precision_recall_fscore_support计算每个类别的精确率、召回率、F 值和支持度。

precision_score计算比率

tp / (tp + fp),其中tp是真阳性数,fp是假阳性数。balanced_accuracy_score计算平衡准确率以处理不平衡数据集。

multilabel_confusion_matrix为每个类别或样本计算混淆矩阵。

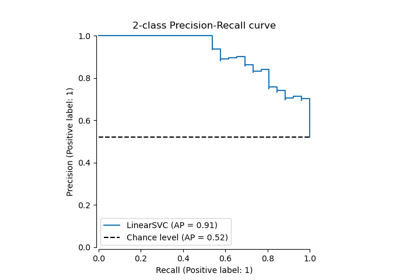

PrecisionRecallDisplay.from_estimator给定估计器和一些数据,绘制精确率-召回率曲线。

PrecisionRecallDisplay.from_predictions给定二元类预测,绘制精确率-召回率曲线。

备注

当

true positive + false negative == 0时,召回率返回 0 并引发UndefinedMetricWarning。可以使用zero_division修改此行为。示例

>>> import numpy as np >>> from sklearn.metrics import recall_score >>> y_true = [0, 1, 2, 0, 1, 2] >>> y_pred = [0, 2, 1, 0, 0, 1] >>> recall_score(y_true, y_pred, average='macro') 0.33... >>> recall_score(y_true, y_pred, average='micro') 0.33... >>> recall_score(y_true, y_pred, average='weighted') 0.33... >>> recall_score(y_true, y_pred, average=None) array([1., 0., 0.]) >>> y_true = [0, 0, 0, 0, 0, 0] >>> recall_score(y_true, y_pred, average=None) array([0.5, 0. , 0. ]) >>> recall_score(y_true, y_pred, average=None, zero_division=1) array([0.5, 1. , 1. ]) >>> recall_score(y_true, y_pred, average=None, zero_division=np.nan) array([0.5, nan, nan])

>>> # multilabel classification >>> y_true = [[0, 0, 0], [1, 1, 1], [0, 1, 1]] >>> y_pred = [[0, 0, 0], [1, 1, 1], [1, 1, 0]] >>> recall_score(y_true, y_pred, average=None) array([1. , 1. , 0.5])