随机森林回归器#

- class sklearn.ensemble.RandomForestRegressor(n_estimators=100, *, criterion='squared_error', max_depth=None, min_samples_split=2, min_samples_leaf=1, min_weight_fraction_leaf=0.0, max_features=1.0, max_leaf_nodes=None, min_impurity_decrease=0.0, bootstrap=True, oob_score=False, n_jobs=None, random_state=None, verbose=0, warm_start=False, ccp_alpha=0.0, max_samples=None, monotonic_cst=None)[source]#

随机森林回归器。

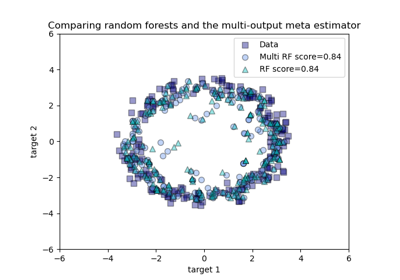

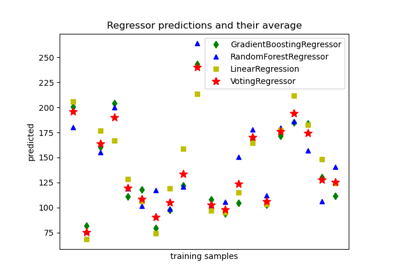

随机森林是一种元估计器,它在数据集的多个子样本上拟合多个决策树回归器,并使用平均值来提高预测精度并控制过拟合。森林中的树使用最佳分割策略,即等同于将

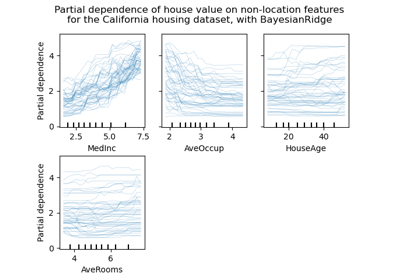

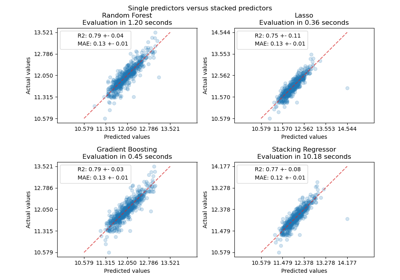

splitter="best"传递给底层的DecisionTreeRegressor。如果bootstrap=True(默认值),则使用max_samples参数控制子样本大小,否则使用整个数据集来构建每棵树。有关基于树的集成模型的比较,请参见示例比较随机森林和直方图梯度提升模型。

在用户指南中了解更多信息。

- 参数:

- n_estimatorsint, default=100

森林中树的数量。

0.22版本中的更改: 在0.22版本中,

n_estimators的默认值从10更改为100。- criterion{“squared_error”, “absolute_error”, “friedman_mse”, “poisson”}, default=”squared_error”

衡量分割质量的函数。支持的标准包括: “squared_error”表示均方误差,等于方差减少作为特征选择标准,并使用每个终端节点的均值最小化L2损失;“friedman_mse”使用均方误差和Friedman的改进分数来评估潜在的分割;“absolute_error”表示平均绝对误差,使用每个终端节点的中位数最小化L1损失;“poisson”使用泊松偏差的减少来查找分割点。“absolute_error”的训练速度明显慢于“squared_error”。

0.18版本中新增: 平均绝对误差 (MAE) 标准。

1.0版本中新增: 泊松标准。

- max_depthint, default=None

树的最大深度。如果为None,则节点会一直扩展,直到所有叶子节点都是纯的,或者直到所有叶子节点包含的样本数少于min_samples_split。

- min_samples_splitint or float, default=2

拆分内部节点所需的最小样本数。

如果为整数,则将

min_samples_split视为最小数量。如果为浮点数,则

min_samples_split是一个分数,ceil(min_samples_split * n_samples)是每个分割的最小样本数。

0.18版本中的更改: 添加了分数的浮点值。

- min_samples_leafint or float, default=1

叶节点所需的最小样本数。只有当它在左右分支中至少留下

min_samples_leaf个训练样本时,才会考虑任何深度的分割点。这可能会使模型变得平滑,尤其是在回归中。如果为整数,则将

min_samples_leaf视为最小数量。如果为浮点数,则

min_samples_leaf是一个分数,ceil(min_samples_leaf * n_samples)是每个节点的最小样本数。

0.18版本中的更改: 添加了分数的浮点值。

- min_weight_fraction_leaffloat, default=0.0

叶节点所需的总权重(所有输入样本的权重之和)的最小加权分数。如果没有提供sample_weight,则样本具有相同的权重。

- max_features{“sqrt”, “log2”, None}, int or float, default=1.0

查找最佳分割时要考虑的特征数量。

如果为整数,则在每次分割时考虑

max_features个特征。如果为浮点数,则

max_features是一个分数,max(1, int(max_features * n_features_in_))个特征在每次分割时都会被考虑。如果为“sqrt”,则

max_features=sqrt(n_features)。如果为“log2”,则

max_features=log2(n_features)。如果为 None 或 1.0,则

max_features=n_features。

注意

1.0 的默认值等效于 Bagging 树,通过设置较小的值(例如 0.3)可以实现更大的随机性。

1.1 版本中的变更:

max_features的默认值已从"auto"更改为 1.0。注意:即使需要有效检查超过

max_features个特征,搜索分割也不会停止,直到找到节点样本至少一个有效的划分。- max_leaf_nodesint,默认为 None

以最佳优先的方式,生长具有

max_leaf_nodes的树。最佳节点定义为杂质的相对减少。如果为 None,则叶节点数量不限。- min_impurity_decreasefloat,默认为 0.0

如果此分割导致杂质减少大于或等于此值,则将分割节点。

加权杂质减少方程如下:

N_t / N * (impurity - N_t_R / N_t * right_impurity - N_t_L / N_t * left_impurity)

其中

N是样本总数,N_t是当前节点的样本数,N_t_L是左子节点的样本数,N_t_R是右子节点的样本数。如果传递了

sample_weight,则N、N_t、N_t_R和N_t_L均指加权和。0.19 版本中添加。

- bootstrapbool,默认为 True

构建树时是否使用 bootstrap 样本。如果为 False,则使用整个数据集构建每棵树。

- oob_scorebool 或 callable,默认为 False

是否使用包外样本估计泛化分数。默认情况下,使用

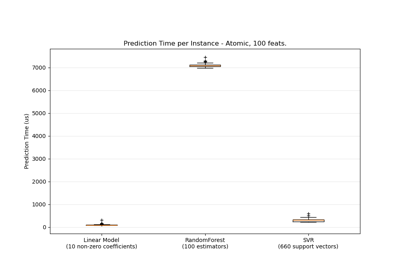

r2_score。提供具有签名metric(y_true, y_pred)的可调用对象以使用自定义指标。仅当bootstrap=True时可用。- n_jobsint,默认为 None

并行运行的任务数。

fit、predict、decision_path和apply都在树上并行化。None表示 1,除非在joblib.parallel_backend上下文中。-1表示使用所有处理器。有关更多详细信息,请参见 词汇表。- random_stateint、RandomState 实例或 None,默认为 None

控制构建树时使用的样本的 bootstrap 的随机性(如果

bootstrap=True)以及在查找每个节点的最佳分割时要考虑的特征的采样(如果max_features < n_features)。有关详细信息,请参见 词汇表。- verboseint,默认为 0

控制拟合和预测时的详细程度。

- warm_startbool,默认为 False

设置为

True时,重用先前对 fit 的调用的解决方案并将更多估计器添加到集成中,否则,只需拟合一个全新的森林。有关详细信息,请参见 词汇表 和 拟合附加树。- ccp_alpha非负浮点数,默认为 0.0

用于最小成本复杂度剪枝的复杂度参数。将选择成本复杂度小于

ccp_alpha的最大成本复杂度的子树。默认情况下,不执行任何剪枝。有关详细信息,请参见 最小成本复杂度剪枝。有关此类剪枝的示例,请参见 使用成本复杂度剪枝后剪枝决策树。0.22 版本中添加。

- max_samplesint 或 float,默认为 None

如果 bootstrap 为 True,则从 X 中抽取的样本数用于训练每个基本估计器。

如果为 None(默认值),则抽取

X.shape[0]个样本。如果为 int,则抽取

max_samples个样本。如果为 float,则抽取

max(round(n_samples * max_samples), 1)个样本。因此,max_samples应在区间(0.0, 1.0]内。

0.22 版本中添加。

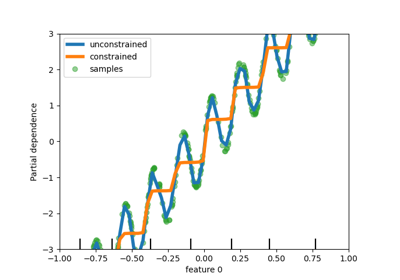

- monotonic_cst形状为 (n_features) 的 int 型数组,默认为 None

- 指示要对每个特征强制执行的单调性约束。

1:单调递增

0:无约束

-1:单调递减

如果 monotonic_cst 为 None,则不应用任何约束。

- 不支持以下情况下的单调性约束:

多输出回归(即

n_outputs_ > 1的情况),在包含缺失值的数据上训练的回归模型。

更多信息请参见 用户指南。

版本 1.4 中新增。

- 属性:

- estimator_

DecisionTreeRegressor 用于创建已拟合子估计器集合的子估计器模板。

版本 1.2 中新增:

base_estimator_已重命名为estimator_。- estimators_DecisionTreeRegressor 列表

已拟合子估计器的集合。

feature_importances_形状为 (n_features,) 的 ndarray基于杂质的特征重要性。

- n_features_in_int

在 拟合过程中看到的特征数量。

版本 0.24 中新增。

- feature_names_in_形状为 (

n_features_in_,) 的 ndarray 在 拟合过程中看到的特征名称。仅当

X的特征名称全部为字符串时才定义。版本 1.0 中新增。

- n_outputs_int

执行

fit时输出的数量。- oob_score_float

使用包外估计获得的训练数据集得分。仅当

oob_score为 True 时才存在此属性。- oob_prediction_形状为 (n_samples,) 或 (n_samples, n_outputs) 的 ndarray

使用训练集上的包外估计计算的预测值。仅当

oob_score为 True 时才存在此属性。estimators_samples_数组列表每个基础估计器的抽取样本子集。

- estimator_

另请参见

sklearn.tree.DecisionTreeRegressor决策树回归器。

sklearn.ensemble.ExtraTreesRegressor极端随机树回归器集成。

sklearn.ensemble.HistGradientBoostingRegressor基于直方图的梯度提升回归树,对于大型数据集 (n_samples >= 10_000) 速度非常快。

备注

控制树的大小(例如

max_depth、min_samples_leaf等)的参数的默认值会导致完全生长和未修剪的树,这些树在某些数据集上可能非常大。为了减少内存消耗,应通过设置这些参数值来控制树的复杂性和大小。在每次分割时都会随机排列特征。因此,即使使用相同的训练数据、

max_features=n_features和bootstrap=False,如果标准的改进对于在最佳分割搜索期间枚举的几个分割是相同的,则找到的最佳分割也可能会有所不同。为了在拟合过程中获得确定性行为,必须固定random_state。默认值

max_features=1.0使用n_features而不是n_features / 3。后者最初在 [1] 中提出,而前者最近在 [2] 中通过实验证实。参考文献

[1]Breiman,“随机森林”,机器学习,45(1),5-32,2001。

[2]P. Geurts、D. Ernst. 和 L. Wehenkel,“极端随机树”,机器学习,63(1),3-42,2006。

示例

>>> from sklearn.ensemble import RandomForestRegressor >>> from sklearn.datasets import make_regression >>> X, y = make_regression(n_features=4, n_informative=2, ... random_state=0, shuffle=False) >>> regr = RandomForestRegressor(max_depth=2, random_state=0) >>> regr.fit(X, y) RandomForestRegressor(...) >>> print(regr.predict([[0, 0, 0, 0]])) [-8.32987858]

- apply(X)[source]#

将森林中的树应用于 X,返回叶索引。

- 参数:

- X形状为 (n_samples, n_features) 的 {类数组、稀疏矩阵}

输入样本。内部地,其 dtype 将转换为

dtype=np.float32。如果提供稀疏矩阵,它将转换为稀疏csr_matrix。

- 返回:

- X_leaves形状为 (n_samples, n_estimators) 的 ndarray

对于 X 中的每个数据点 x 和森林中的每棵树,返回 x 最终所在的叶的索引。

- decision_path(X)[source]#

返回森林中的决策路径。

版本 0.18 中新增。

- 参数:

- X形状为 (n_samples, n_features) 的 {类数组、稀疏矩阵}

输入样本。内部地,其 dtype 将转换为

dtype=np.float32。如果提供稀疏矩阵,它将转换为稀疏csr_matrix。

- 返回:

- indicator形状为 (n_samples, n_nodes) 的稀疏矩阵

返回一个节点指示矩阵,其中非零元素表示样本经过这些节点。该矩阵采用 CSR 格式。

- n_nodes_ptr形状为 (n_estimators + 1,) 的 ndarray

indicator[n_nodes_ptr[i]:n_nodes_ptr[i+1]] 中的列给出第 i 个估计器的指示值。

- property estimators_samples_#

每个基础估计器的抽取样本子集。

返回一个动态生成的索引列表,用于标识用于拟合集成每个成员的样本,即包内样本。

注意:为了减少对象内存占用,不会存储采样数据,该列表在每次调用属性时都会重新创建。因此,获取属性的速度可能会比预期慢。

- property feature_importances_#

基于杂质的特征重要性。

数值越高,特征越重要。特征的重要性计算为该特征带来的标准(归一化)总减少量。它也称为基尼重要性。

警告:对于高基数特征(许多唯一值),基于杂质的特征重要性可能会产生误导。请参阅

sklearn.inspection.permutation_importance作为替代方案。- 返回:

- feature_importances_形状为 (n_features,) 的 ndarray

此数组的值之和为 1,除非所有树都是仅由根节点组成的单节点树,在这种情况下,它将是一个全零数组。

- fit(X, y, sample_weight=None)[source]#

根据训练集 (X, y) 建立森林。

- 参数:

- X形状为 (n_samples, n_features) 的 {类数组、稀疏矩阵}

训练输入样本。内部会将其 dtype 转换为

dtype=np.float32。如果提供的是稀疏矩阵,则将其转换为稀疏csc_matrix。- y形状为 (n_samples,) 或 (n_samples, n_outputs) 的类数组

目标值(分类中的类别标签,回归中的实数)。

- sample_weight形状为 (n_samples,) 的类数组,默认值为 None

样本权重。如果为 None,则样本权重相等。在搜索每个节点中的分割时,会忽略那些会创建净权重为零或负的子节点的分割。在分类的情况下,如果分割会导致任何单个类别在任一子节点中都带有负权重,则也会忽略这些分割。

- 返回:

- self对象

已拟合的估计器。

- get_metadata_routing()[source]#

获取此对象的元数据路由。

请查看 用户指南,了解路由机制的工作原理。

- 返回:

- routingMetadataRequest

一个

MetadataRequest,封装了路由信息。

- get_params(deep=True)[source]#

获取此估计器的参数。

- 参数:

- deep布尔值,默认为 True

如果为 True,则将返回此估计器和包含的作为估计器的子对象的参数。

- 返回:

- params字典

参数名称与其值的映射。

- predict(X)[source]#

预测 X 的回归目标。

输入样本的预测回归目标计算为森林中树木的平均预测回归目标。

- 参数:

- X形状为 (n_samples, n_features) 的 {类数组、稀疏矩阵}

输入样本。内部地,其 dtype 将转换为

dtype=np.float32。如果提供稀疏矩阵,它将转换为稀疏csr_matrix。

- 返回:

- y形状为 (n_samples,) 或 (n_samples, n_outputs) 的 ndarray

预测值。

- score(X, y, sample_weight=None)[source]#

返回预测的决定系数。

决定系数 \(R^2\) 定义为 \((1 - \frac{u}{v})\),其中 \(u\) 是残差平方和

((y_true - y_pred)** 2).sum(),而 \(v\) 是总平方和((y_true - y_true.mean()) ** 2).sum()。最佳分数为 1.0,它可以为负数(因为模型可以任意差)。始终预测y的期望值的常数模型,忽略输入特征,其 \(R^2\) 分数为 0.0。- 参数:

- X形状为 (n_samples, n_features) 的类数组

测试样本。对于某些估计器,这可能是预计算的核矩阵,或者形状为

(n_samples, n_samples_fitted)的泛型对象列表,其中n_samples_fitted是估计器拟合中使用的样本数。- y形状为 (n_samples,) 或 (n_samples, n_outputs) 的类数组

X 的真值。

- sample_weight形状为 (n_samples,) 的类数组,默认值为 None

样本权重。

- 返回:

- score浮点数

self.predict(X)相对于y的 \(R^2\)。

备注

从 0.23 版本开始,在对回归器调用

score时使用的 \(R^2\) 分数使用multioutput='uniform_average',以保持与r2_score的默认值一致。这会影响所有多输出回归器的score方法(MultiOutputRegressor除外)。

- set_fit_request(*, sample_weight: bool | None | str = '$UNCHANGED$') RandomForestRegressor[source]#

向

fit方法请求传递的元数据。请注意,只有在

enable_metadata_routing=True时(参见sklearn.set_config)此方法才相关。请参阅用户指南了解路由机制的工作原理。每个参数的选项为:

True:请求元数据,如果提供则传递给fit。如果未提供元数据,则忽略请求。False:不请求元数据,元估计器不会将其传递给fit。None:不请求元数据,如果用户提供元数据,元估计器将引发错误。str:元数据应使用此给定的别名而不是原始名称传递给元估计器。

默认值(

sklearn.utils.metadata_routing.UNCHANGED)保留现有的请求。这允许您更改某些参数的请求,而不对其他参数进行更改。版本1.3中新增。

注意

仅当将此估计器用作元估计器的子估计器(例如,在

Pipeline中使用)时,此方法才相关。否则,它无效。- 参数:

- sample_weightstr, True, False 或 None,默认为 sklearn.utils.metadata_routing.UNCHANGED

fit中的sample_weight参数的元数据路由。

- 返回:

- self对象

更新后的对象。

- set_params(**params)[source]#

设置此估计器的参数。

此方法适用于简单的估计器以及嵌套对象(例如

Pipeline)。后者具有<component>__<parameter>形式的参数,因此可以更新嵌套对象的每个组件。- 参数:

- **paramsdict

估计器参数。

- 返回:

- self估计器实例

估计器实例。

- set_score_request(*, sample_weight: bool | None | str = '$UNCHANGED$') RandomForestRegressor[source]#

向

score方法请求传递的元数据。请注意,只有在

enable_metadata_routing=True时(参见sklearn.set_config)此方法才相关。请参阅用户指南了解路由机制的工作原理。每个参数的选项为:

True:请求元数据,如果提供则传递给score。如果未提供元数据,则忽略请求。False:不请求元数据,元估计器不会将其传递给score。None:不请求元数据,如果用户提供元数据,元估计器将引发错误。str:元数据应使用此给定的别名而不是原始名称传递给元估计器。

默认值(

sklearn.utils.metadata_routing.UNCHANGED)保留现有的请求。这允许您更改某些参数的请求,而不对其他参数进行更改。版本1.3中新增。

注意

仅当将此估计器用作元估计器的子估计器(例如,在

Pipeline中使用)时,此方法才相关。否则,它无效。- 参数:

- sample_weightstr, True, False 或 None,默认为 sklearn.utils.metadata_routing.UNCHANGED

score中的sample_weight参数的元数据路由。

- 返回:

- self对象

更新后的对象。