注意

转到结尾 下载完整的示例代码。或者通过 JupyterLite 或 Binder 在您的浏览器中运行此示例。

scikit-learn 1.0 版本亮点#

我们非常高兴地宣布 scikit-learn 1.0 版本的发布!该库已经稳定了一段时间,发布 1.0 版本是对此的认可,并向我们的用户发出信号。此版本不包含任何重大更改,除了通常的两个版本弃用周期之外。未来,我们将尽最大努力保持这种模式。

此版本包含一些新的关键功能以及许多改进和错误修复。我们在下面详细介绍了此版本的一些主要功能。有关所有更改的详尽列表,请参阅发行说明。

要安装最新版本(使用 pip):

pip install --upgrade scikit-learn

或使用 conda:

conda install -c conda-forge scikit-learn

关键字参数和位置参数#

scikit-learn API 公开了许多具有许多输入参数的函数和方法。例如,在此版本之前,可以实例化一个HistGradientBoostingRegressor 为:

HistGradientBoostingRegressor("squared_error", 0.1, 100, 31, None,

20, 0.0, 255, None, None, False, "auto", "loss", 0.1, 10, 1e-7,

0, None)

要理解上述代码,读者需要查看 API 文档,并检查每个参数的位置和含义。为了提高基于 scikit-learn 编写的代码的可读性,现在用户必须使用其名称(作为关键字参数)而不是位置参数来提供大多数参数。例如,上述代码将是:

HistGradientBoostingRegressor(

loss="squared_error",

learning_rate=0.1,

max_iter=100,

max_leaf_nodes=31,

max_depth=None,

min_samples_leaf=20,

l2_regularization=0.0,

max_bins=255,

categorical_features=None,

monotonic_cst=None,

warm_start=False,

early_stopping="auto",

scoring="loss",

validation_fraction=0.1,

n_iter_no_change=10,

tol=1e-7,

verbose=0,

random_state=None,

)

这更易于阅读。位置参数自 0.23 版本以来已被弃用,现在将引发TypeError。在某些情况下仍然允许使用有限数量的位置参数,例如在PCA中,PCA(10)仍然允许,但PCA(10, False)不允许。

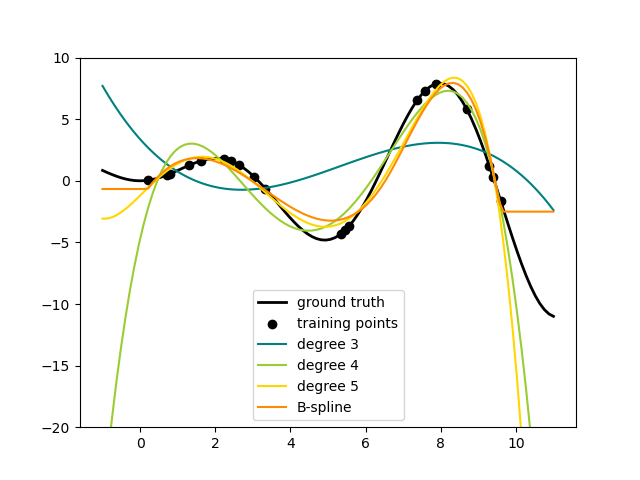

样条变换器#

向数据集的特征集中添加非线性项的一种方法是使用新的SplineTransformer为连续/数值特征生成样条基函数。样条是分段多项式,由其多项式次数和节点位置参数化。SplineTransformer实现了 B 样条基。

以下代码显示了样条的实际应用,更多信息,请参考用户指南。

import numpy as np

from sklearn.preprocessing import SplineTransformer

X = np.arange(5).reshape(5, 1)

spline = SplineTransformer(degree=2, n_knots=3)

spline.fit_transform(X)

array([[0.5 , 0.5 , 0. , 0. ],

[0.125, 0.75 , 0.125, 0. ],

[0. , 0.5 , 0.5 , 0. ],

[0. , 0.125, 0.75 , 0.125],

[0. , 0. , 0.5 , 0.5 ]])

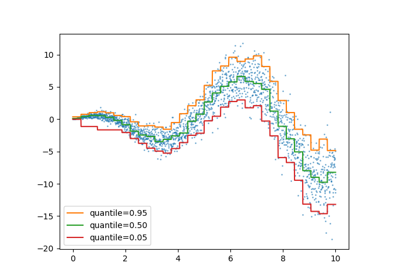

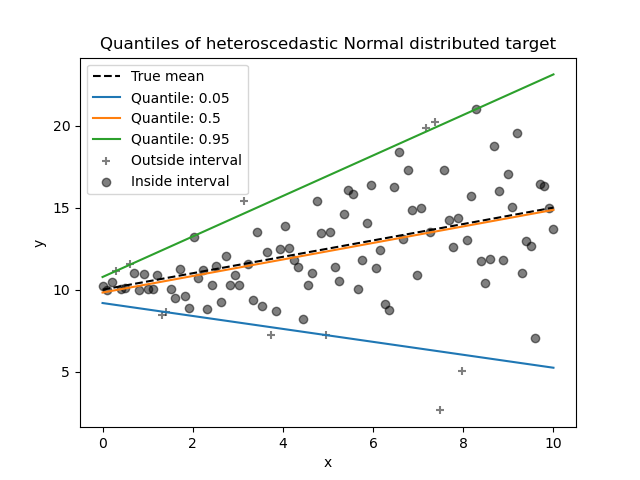

分位数回归器#

分位数回归估计条件于\(X\)的\(y\)的中位数或其他分位数,而普通最小二乘法 (OLS) 估计条件均值。

作为线性模型,新的QuantileRegressor为\(q\)分位数\(q \in (0, 1)\)给出线性预测\(\hat{y}(w, X) = Xw\)。然后通过以下最小化问题找到权重或系数\(w\)

这包括弹球损失(也称为线性损失),另见mean_pinball_loss,

和由参数alpha控制的 L1 惩罚,类似于linear_model.Lasso。

请查看以下示例以了解其工作原理,以及用户指南以了解更多详细信息。

特征名称支持#

当在拟合期间将估计器传递给pandas 的数据框时,估计器将设置一个包含特征名称的feature_names_in_属性。请注意,只有当数据框中的列名全部为字符串时,才启用特征名称支持。feature_names_in_用于检查非拟合(例如预测)中传递的数据框的列名是否与拟合中的特征一致。

from sklearn.preprocessing import StandardScaler

import pandas as pd

X = pd.DataFrame([[1, 2, 3], [4, 5, 6]], columns=["a", "b", "c"])

scalar = StandardScaler().fit(X)

scalar.feature_names_in_

array(['a', 'b', 'c'], dtype=object)

对于已经具有get_feature_names的变换器和输入和输出之间具有一一对应关系的变换器(例如StandardScaler),get_feature_names_out的支持可用。get_feature_names_out支持将在未来的版本中添加到所有其他变换器。此外,compose.ColumnTransformer.get_feature_names_out可用于组合其变换器的特征名称。

from sklearn.compose import ColumnTransformer

from sklearn.preprocessing import OneHotEncoder

import pandas as pd

X = pd.DataFrame({"pet": ["dog", "cat", "fish"], "age": [3, 7, 1]})

preprocessor = ColumnTransformer(

[

("numerical", StandardScaler(), ["age"]),

("categorical", OneHotEncoder(), ["pet"]),

],

verbose_feature_names_out=False,

).fit(X)

preprocessor.get_feature_names_out()

array(['age', 'pet_cat', 'pet_dog', 'pet_fish'], dtype=object)

当此预处理器与管道一起使用时,分类器使用的特征名称通过切片和调用get_feature_names_out获得。

from sklearn.linear_model import LogisticRegression

from sklearn.pipeline import make_pipeline

y = [1, 0, 1]

pipe = make_pipeline(preprocessor, LogisticRegression())

pipe.fit(X, y)

pipe[:-1].get_feature_names_out()

array(['age', 'pet_cat', 'pet_dog', 'pet_fish'], dtype=object)

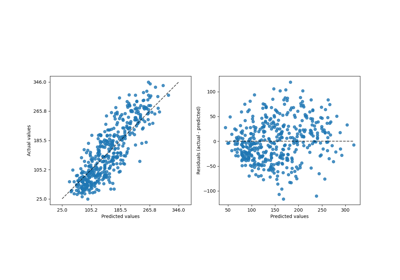

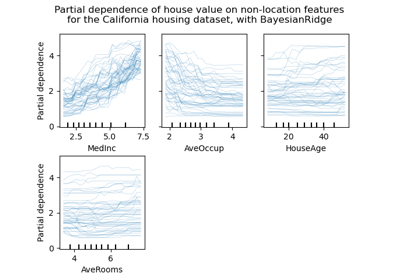

更灵活的绘图API#

metrics.ConfusionMatrixDisplay,metrics.PrecisionRecallDisplay,metrics.DetCurveDisplay和inspection.PartialDependenceDisplay现在公开了两种类方法:from_estimator和from_predictions,允许用户根据预测或估计器创建图表。这意味着相应的plot_*函数已被弃用。请查看示例一和示例二,了解如何使用新的绘图功能。

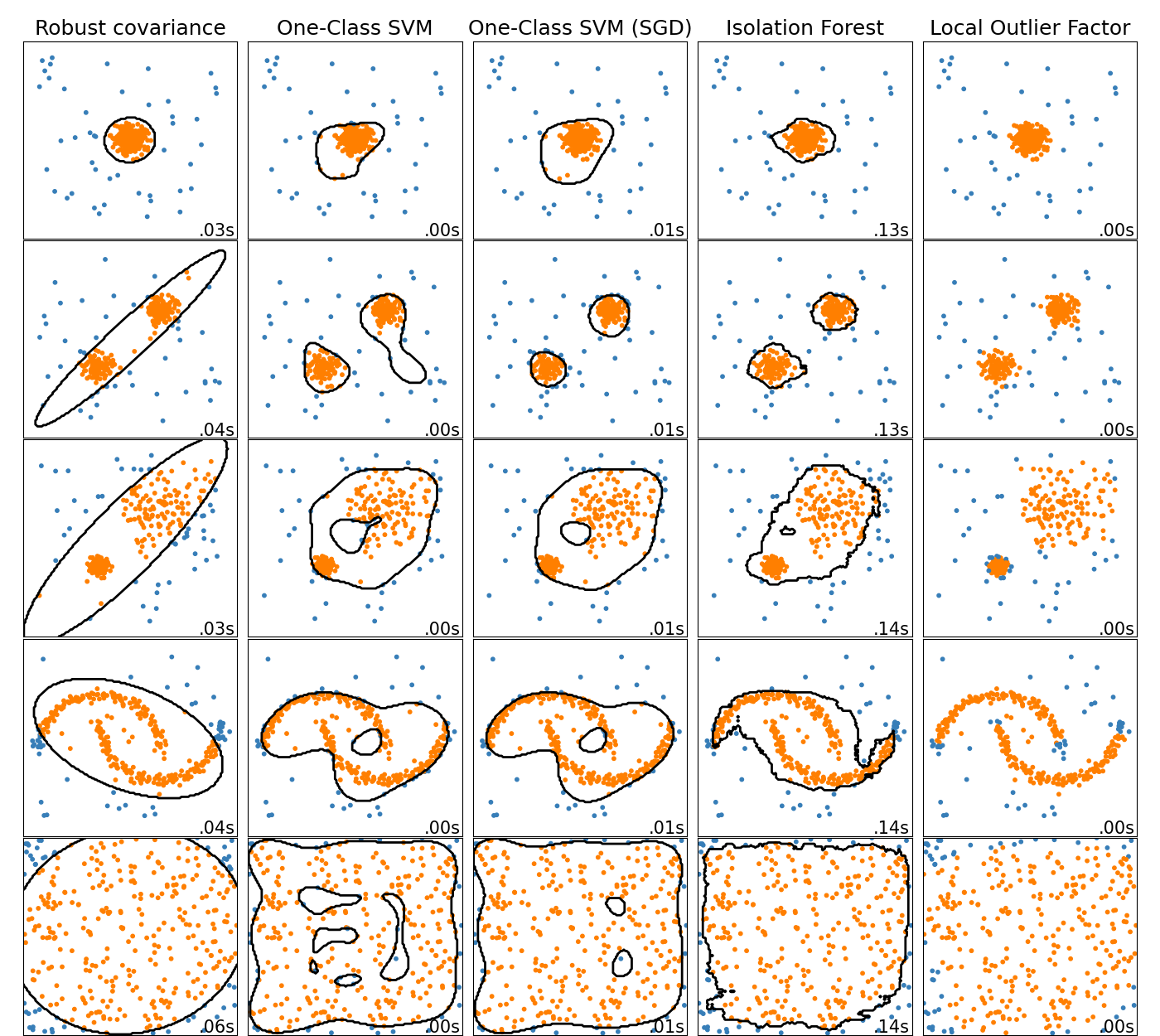

在线单类SVM#

新的类SGDOneClassSVM使用随机梯度下降实现了单类SVM的在线线性版本。结合核近似技术,SGDOneClassSVM可用于逼近在OneClassSVM中实现的核化单类SVM的解,其拟合时间复杂度与样本数量线性相关。请注意,核化单类SVM的复杂度至少与样本数量的平方成正比。SGDOneClassSVM因此非常适合具有大量训练样本(> 10,000)的数据集,对于这些数据集,SGD变体可以快几个数量级。请查看此示例以了解其使用方法,以及用户指南以了解更多详细信息。

基于直方图的梯度提升模型现已稳定#

HistGradientBoostingRegressor和HistGradientBoostingClassifier不再是实验性的,可以直接导入和使用,例如:

from sklearn.ensemble import HistGradientBoostingClassifier

新的文档改进#

此版本包含许多文档改进。在超过2100个合并的拉取请求中,大约800个是对我们文档的改进。

脚本总运行时间:(0分钟0.016秒)

相关示例