注意

跳到末尾 下载完整的示例代码,或通过 JupyterLite 或 Binder 在浏览器中运行此示例

scikit-learn 1.5 的发布亮点#

我们很高兴宣布 scikit-learn 1.5 正式发布!此版本添加了许多错误修复和改进,以及一些关键的新功能。下面我们将详细介绍此版本的亮点。有关所有更改的详尽列表,请参阅发布说明。

通过 pip 安装最新版本

pip install --upgrade scikit-learn

或通过 conda 安装

conda install -c conda-forge scikit-learn

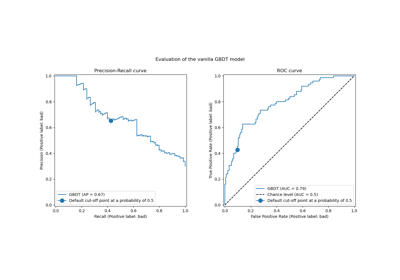

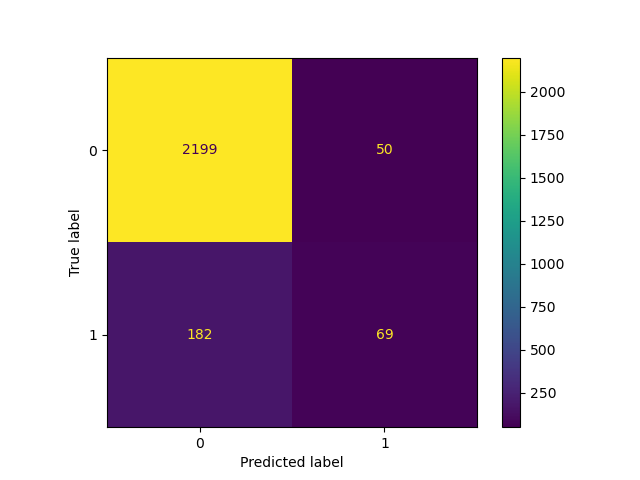

FixedThresholdClassifier:设置二元分类器的决策阈值#

scikit-learn 的所有二元分类器都使用 0.5 的固定决策阈值,将概率估计(即 predict_proba 的输出)转换为类别预测。然而,0.5 几乎从不是给定问题所需的理想阈值。FixedThresholdClassifier 允许包装任何二元分类器并设置自定义决策阈值。

from sklearn.datasets import make_classification

from sklearn.linear_model import LogisticRegression

from sklearn.metrics import ConfusionMatrixDisplay

from sklearn.model_selection import train_test_split

X, y = make_classification(n_samples=10_000, weights=[0.9, 0.1], random_state=0)

X_train, X_test, y_train, y_test = train_test_split(X, y, random_state=0)

classifier_05 = LogisticRegression(C=1e6, random_state=0).fit(X_train, y_train)

_ = ConfusionMatrixDisplay.from_estimator(classifier_05, X_test, y_test)

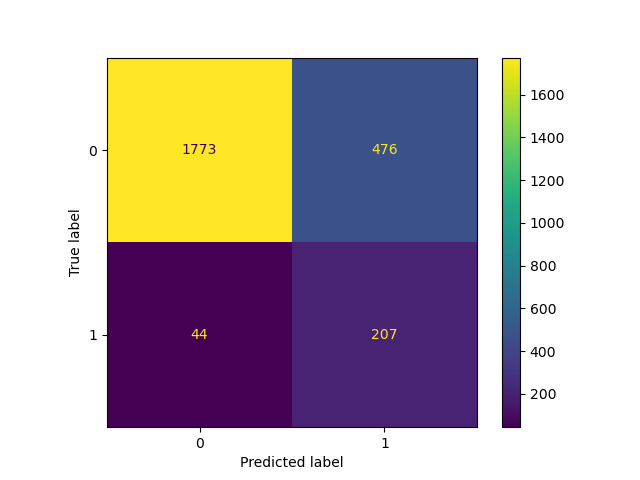

降低阈值,即允许更多样本被分类为正类别,会增加真阳性数量,但代价是增加更多假阳性(正如ROC曲线的凹性所熟知)。

from sklearn.model_selection import FixedThresholdClassifier

classifier_01 = FixedThresholdClassifier(classifier_05, threshold=0.1)

classifier_01.fit(X_train, y_train)

_ = ConfusionMatrixDisplay.from_estimator(classifier_01, X_test, y_test)

TunedThresholdClassifierCV:调整二元分类器的决策阈值#

二元分类器的决策阈值可以使用TunedThresholdClassifierCV进行调整以优化给定指标。

当模型旨在部署到特定应用场景中,我们可以为真阳性、真阴性、假阳性和假阴性分配不同的收益或成本时,找到最佳决策阈值尤其有用。

让我们通过一个任意的例子来说明这一点:

每个真阳性获得1个利润单位,例如欧元、健康生活的年数等;

真阴性无收益或无成本;

每个假阴性成本2;

每个假阳性成本0.1。

我们的指标量化了每个样本的平均利润,它由以下Python函数定义

from sklearn.metrics import confusion_matrix

def custom_score(y_observed, y_pred):

tn, fp, fn, tp = confusion_matrix(y_observed, y_pred, normalize="all").ravel()

return tp - 2 * fn - 0.1 * fp

print("Untuned decision threshold: 0.5")

print(f"Custom score: {custom_score(y_test, classifier_05.predict(X_test)):.2f}")

Untuned decision threshold: 0.5

Custom score: -0.12

有趣的是,每个预测的平均收益是负的,这意味着这个决策系统平均来说是亏损的。

调整阈值以优化此自定义指标会得到一个更小的阈值,允许更多样本被分类为正类别。因此,每个预测的平均收益得到改善。

from sklearn.metrics import make_scorer

from sklearn.model_selection import TunedThresholdClassifierCV

custom_scorer = make_scorer(

custom_score, response_method="predict", greater_is_better=True

)

tuned_classifier = TunedThresholdClassifierCV(

classifier_05, cv=5, scoring=custom_scorer

).fit(X, y)

print(f"Tuned decision threshold: {tuned_classifier.best_threshold_:.3f}")

print(f"Custom score: {custom_score(y_test, tuned_classifier.predict(X_test)):.2f}")

Tuned decision threshold: 0.071

Custom score: 0.04

我们观察到,调整决策阈值可以将平均亏损的机器学习系统转变为一个有益的系统。

在实践中,定义一个有意义的特定于应用的指标可能涉及使这些不良预测的成本和良好预测的收益取决于每个单独数据点的辅助元数据,例如欺诈检测系统中的交易金额。

为实现这一点,TunedThresholdClassifierCV 利用元数据路由支持(元数据路由用户指南),从而能够优化复杂的业务指标,详情请参见成本敏感学习的决策阈值后调。

PCA 的性能改进#

PCA 有一个新的求解器 "covariance_eigh",对于拥有大量数据点和少量特征的数据集,它比其他求解器快一个数量级,并且内存效率更高。

from sklearn.datasets import make_low_rank_matrix

from sklearn.decomposition import PCA

X = make_low_rank_matrix(

n_samples=10_000, n_features=100, tail_strength=0.1, random_state=0

)

pca = PCA(n_components=10, svd_solver="covariance_eigh").fit(X)

print(f"Explained variance: {pca.explained_variance_ratio_.sum():.2f}")

Explained variance: 0.88

新的求解器也支持稀疏输入数据

Explained variance: 0.13

"full" 求解器也得到了改进,内存使用更少,转换速度更快。默认的 svd_solver="auto" 选项利用了新的求解器,现在能够为稀疏数据集选择合适的求解器。

与大多数其他PCA求解器类似,新的"covariance_eigh"求解器可以通过启用数组API的实验性支持,在输入数据作为PyTorch或CuPy数组传递时利用GPU计算。

ColumnTransformer 可下标访问#

ColumnTransformer 的变换器现在可以通过名称索引直接访问。

import numpy as np

from sklearn.compose import ColumnTransformer

from sklearn.preprocessing import OneHotEncoder, StandardScaler

X = np.array([[0, 1, 2], [3, 4, 5]])

column_transformer = ColumnTransformer(

[("std_scaler", StandardScaler(), [0]), ("one_hot", OneHotEncoder(), [1, 2])]

)

column_transformer.fit(X)

print(column_transformer["std_scaler"])

print(column_transformer["one_hot"])

StandardScaler()

OneHotEncoder()

SimpleImputer 的自定义插补策略#

SimpleImputer 现在支持自定义插补策略,使用一个可调用函数从列向量的非缺失值中计算出一个标量值。

from sklearn.impute import SimpleImputer

X = np.array(

[

[-1.1, 1.1, 1.1],

[3.9, -1.2, np.nan],

[np.nan, 1.3, np.nan],

[-0.1, -1.4, -1.4],

[-4.9, 1.5, -1.5],

[np.nan, 1.6, 1.6],

]

)

def smallest_abs(arr):

"""Return the smallest absolute value of a 1D array."""

return np.min(np.abs(arr))

imputer = SimpleImputer(strategy=smallest_abs)

imputer.fit_transform(X)

array([[-1.1, 1.1, 1.1],

[ 3.9, -1.2, 1.1],

[ 0.1, 1.3, 1.1],

[-0.1, -1.4, -1.4],

[-4.9, 1.5, -1.5],

[ 0.1, 1.6, 1.6]])

非数值数组的成对距离#

pairwise_distances 现在可以使用可调用度量计算非数值数组之间的距离。

from sklearn.metrics import pairwise_distances

X = ["cat", "dog"]

Y = ["cat", "fox"]

def levenshtein_distance(x, y):

"""Return the Levenshtein distance between two strings."""

if x == "" or y == "":

return max(len(x), len(y))

if x[0] == y[0]:

return levenshtein_distance(x[1:], y[1:])

return 1 + min(

levenshtein_distance(x[1:], y),

levenshtein_distance(x, y[1:]),

levenshtein_distance(x[1:], y[1:]),

)

pairwise_distances(X, Y, metric=levenshtein_distance)

array([[0., 3.],

[3., 2.]])

脚本总运行时间: (0 分 0.781 秒)

相关示例