注意

转到末尾 下载完整的示例代码。 或者通过 JupyterLite 或 Binder 在浏览器中运行此示例

保序回归#

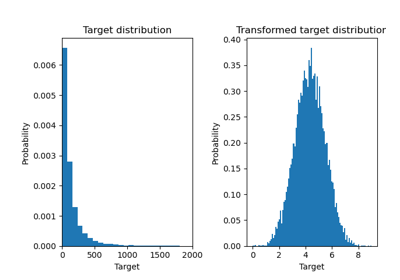

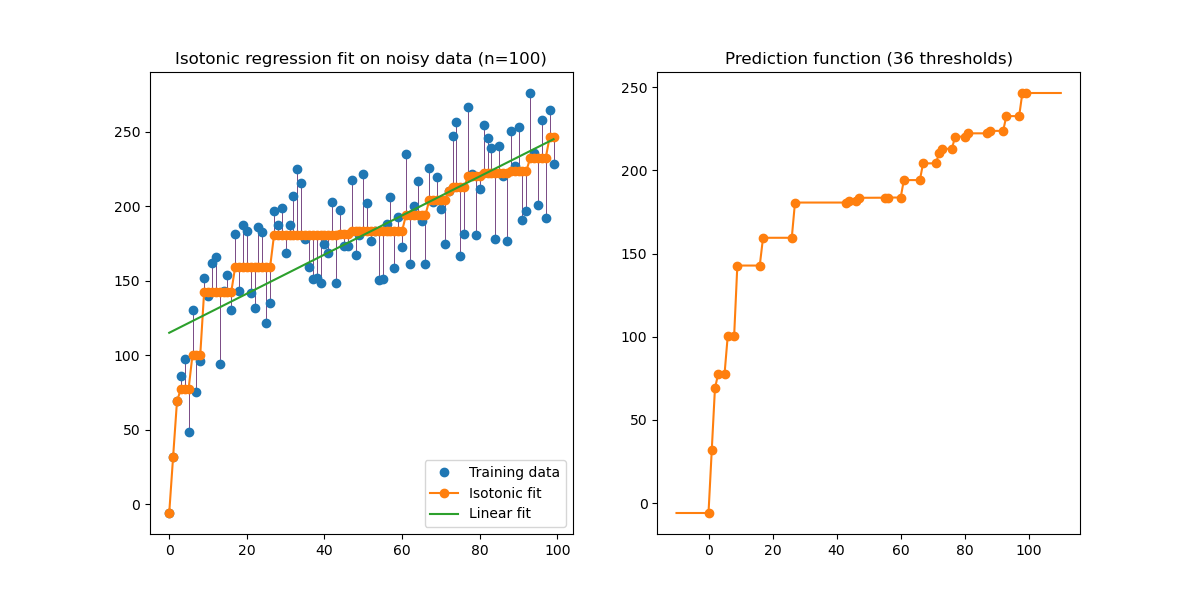

生成数据(具有同方差均匀噪声的非线性单调趋势)上的保序回归图示。

保序回归算法在训练数据上最小化均方误差的同时,找到一个函数的非递减近似。这种非参数模型的好处是,除了单调性之外,它不对目标函数的形状做任何假设。为作比较,这里也展示了线性回归。

右侧图显示了由阈值点的线性插值得到的模型预测函数。阈值点是训练输入观测值的子集,其匹配的目标值通过保序非参数拟合计算得出。

# Authors: The scikit-learn developers

# SPDX-License-Identifier: BSD-3-Clause

import matplotlib.pyplot as plt

import numpy as np

from matplotlib.collections import LineCollection

from sklearn.isotonic import IsotonicRegression

from sklearn.linear_model import LinearRegression

from sklearn.utils import check_random_state

n = 100

x = np.arange(n)

rs = check_random_state(0)

y = rs.randint(-50, 50, size=(n,)) + 50.0 * np.log1p(np.arange(n))

拟合IsotonicRegression和LinearRegression模型

ir = IsotonicRegression(out_of_bounds="clip")

y_ = ir.fit_transform(x, y)

lr = LinearRegression()

lr.fit(x[:, np.newaxis], y) # x needs to be 2d for LinearRegression

绘制结果

segments = [[[i, y[i]], [i, y_[i]]] for i in range(n)]

lc = LineCollection(segments, zorder=0)

lc.set_array(np.ones(len(y)))

lc.set_linewidths(np.full(n, 0.5))

fig, (ax0, ax1) = plt.subplots(ncols=2, figsize=(12, 6))

ax0.plot(x, y, "C0.", markersize=12)

ax0.plot(x, y_, "C1.-", markersize=12)

ax0.plot(x, lr.predict(x[:, np.newaxis]), "C2-")

ax0.add_collection(lc)

ax0.legend(("Training data", "Isotonic fit", "Linear fit"), loc="lower right")

ax0.set_title("Isotonic regression fit on noisy data (n=%d)" % n)

x_test = np.linspace(-10, 110, 1000)

ax1.plot(x_test, ir.predict(x_test), "C1-")

ax1.plot(ir.X_thresholds_, ir.y_thresholds_, "C1.", markersize=12)

ax1.set_title("Prediction function (%d thresholds)" % len(ir.X_thresholds_))

plt.show()

请注意,我们明确地将 out_of_bounds="clip" 传递给 IsotonicRegression 的构造函数,以控制模型在训练集中观察到的数据范围之外进行外推的方式。这种“剪切”外推可以在右侧的决策函数图中看到。

脚本总运行时间: (0 分钟 0.136 秒)

相关示例