注意

转到末尾 下载完整示例代码,或通过 JupyterLite 或 Binder 在浏览器中运行此示例

异常值检测估计器的评估#

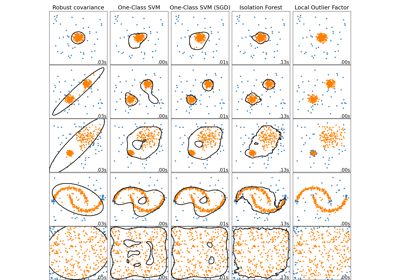

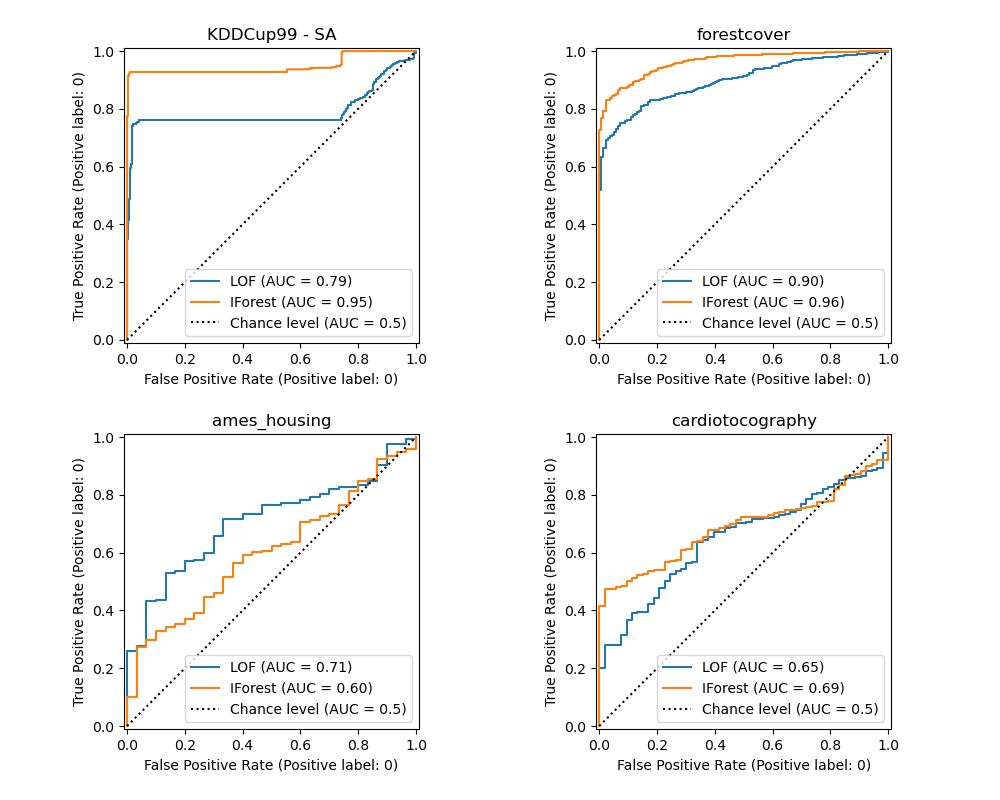

本示例比较了两种异常值检测算法,即局部异常因子 (LOF) 和隔离森林 (IForest),它们在sklearn.datasets中提供的真实世界数据集上进行比较。目标是展示不同算法在不同数据集上的良好表现,并对比它们的训练速度和对超参数的敏感性。

这些算法(无标签)在假定包含异常值的整个数据集上进行训练。

1. ROC 曲线是利用真实标签知识计算的,并使用RocCurveDisplay显示。

性能以 ROC-AUC 进行评估。

# Authors: The scikit-learn developers

# SPDX-License-Identifier: BSD-3-Clause

数据集预处理和模型训练#

不同的异常值检测模型需要不同的预处理。在存在分类变量的情况下,OrdinalEncoder 对于像IsolationForest这样的基于树的模型通常是一个好的策略,而像LocalOutlierFactor这样的基于邻居的模型会受到序数编码引入的顺序的影响。为了避免引入顺序,应该使用OneHotEncoder。

基于邻居的模型可能还需要对数值特征进行缩放(例如参见重缩放在 k-近邻模型上的影响)。在存在异常值的情况下,一个好的选择是使用RobustScaler。

from sklearn.compose import ColumnTransformer

from sklearn.ensemble import IsolationForest

from sklearn.neighbors import LocalOutlierFactor

from sklearn.pipeline import make_pipeline

from sklearn.preprocessing import (

OneHotEncoder,

OrdinalEncoder,

RobustScaler,

)

def make_estimator(name, categorical_columns=None, iforest_kw=None, lof_kw=None):

"""Create an outlier detection estimator based on its name."""

if name == "LOF":

outlier_detector = LocalOutlierFactor(**(lof_kw or {}))

if categorical_columns is None:

preprocessor = RobustScaler()

else:

preprocessor = ColumnTransformer(

transformers=[("categorical", OneHotEncoder(), categorical_columns)],

remainder=RobustScaler(),

)

else: # name == "IForest"

outlier_detector = IsolationForest(**(iforest_kw or {}))

if categorical_columns is None:

preprocessor = None

else:

ordinal_encoder = OrdinalEncoder(

handle_unknown="use_encoded_value", unknown_value=-1

)

preprocessor = ColumnTransformer(

transformers=[

("categorical", ordinal_encoder, categorical_columns),

],

remainder="passthrough",

)

return make_pipeline(preprocessor, outlier_detector)

以下 fit_predict 函数返回 X 的平均异常值分数。

from time import perf_counter

def fit_predict(estimator, X):

tic = perf_counter()

if estimator[-1].__class__.__name__ == "LocalOutlierFactor":

estimator.fit(X)

y_score = estimator[-1].negative_outlier_factor_

else: # "IsolationForest"

y_score = estimator.fit(X).decision_function(X)

toc = perf_counter()

print(f"Duration for {model_name}: {toc - tic:.2f} s")

return y_score

在示例的其余部分,我们每节处理一个数据集。加载数据后,目标被修改为包含两个类别:0 代表正常值,1 代表异常值。由于 scikit-learn 文档的计算限制,某些数据集的样本大小使用分层train_test_split进行缩减。

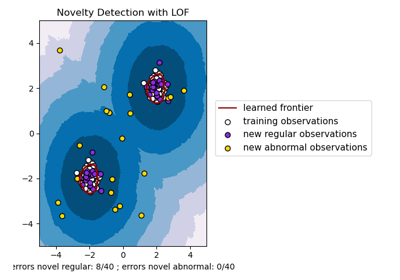

此外,我们将 n_neighbors 设置为与预期异常值数量 expected_n_anomalies = n_samples * expected_anomaly_fraction 匹配。只要异常值的比例不是很低,这是一个很好的启发式方法,因为 n_neighbors 应该至少大于人口较少簇中的样本数量(参见使用局部异常因子 (LOF) 进行异常值检测)。

KDDCup99 - SA 数据集#

Kddcup 99 数据集是使用封闭网络和手动注入攻击生成的。SA 数据集是其子集,通过简单地选择所有正常数据和大约 3% 的异常比例获得。

import numpy as np

from sklearn.datasets import fetch_kddcup99

from sklearn.model_selection import train_test_split

X, y = fetch_kddcup99(

subset="SA", percent10=True, random_state=42, return_X_y=True, as_frame=True

)

y = (y != b"normal.").astype(np.int32)

X, _, y, _ = train_test_split(X, y, train_size=0.1, stratify=y, random_state=42)

n_samples, anomaly_frac = X.shape[0], y.mean()

print(f"{n_samples} datapoints with {y.sum()} anomalies ({anomaly_frac:.02%})")

10065 datapoints with 338 anomalies (3.36%)

SA 数据集包含 41 个特征,其中 3 个是分类特征:“protocol_type”、“service”和“flag”。

y_true = {}

y_score = {"LOF": {}, "IForest": {}}

model_names = ["LOF", "IForest"]

cat_columns = ["protocol_type", "service", "flag"]

y_true["KDDCup99 - SA"] = y

for model_name in model_names:

model = make_estimator(

name=model_name,

categorical_columns=cat_columns,

lof_kw={"n_neighbors": int(n_samples * anomaly_frac)},

iforest_kw={"random_state": 42},

)

y_score[model_name]["KDDCup99 - SA"] = fit_predict(model, X)

Duration for LOF: 1.89 s

Duration for IForest: 0.28 s

森林覆盖类型数据集#

森林覆盖类型是一个多类数据集,其目标是给定森林地块中的主要树种。它包含 54 个特征,其中一些(“Wilderness_Area”和“Soil_Type”)已进行二进制编码。虽然最初旨在作为分类任务,但可以将标签为 2 的样本视为正常值,将标签为 4 的样本视为异常值。

from sklearn.datasets import fetch_covtype

X, y = fetch_covtype(return_X_y=True, as_frame=True)

s = (y == 2) + (y == 4)

X = X.loc[s]

y = y.loc[s]

y = (y != 2).astype(np.int32)

X, _, y, _ = train_test_split(X, y, train_size=0.05, stratify=y, random_state=42)

X_forestcover = X # save X for later use

n_samples, anomaly_frac = X.shape[0], y.mean()

print(f"{n_samples} datapoints with {y.sum()} anomalies ({anomaly_frac:.02%})")

14302 datapoints with 137 anomalies (0.96%)

y_true["forestcover"] = y

for model_name in model_names:

model = make_estimator(

name=model_name,

lof_kw={"n_neighbors": int(n_samples * anomaly_frac)},

iforest_kw={"random_state": 42},

)

y_score[model_name]["forestcover"] = fit_predict(model, X)

Duration for LOF: 2.10 s

Duration for IForest: 0.23 s

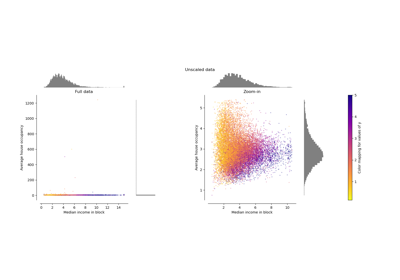

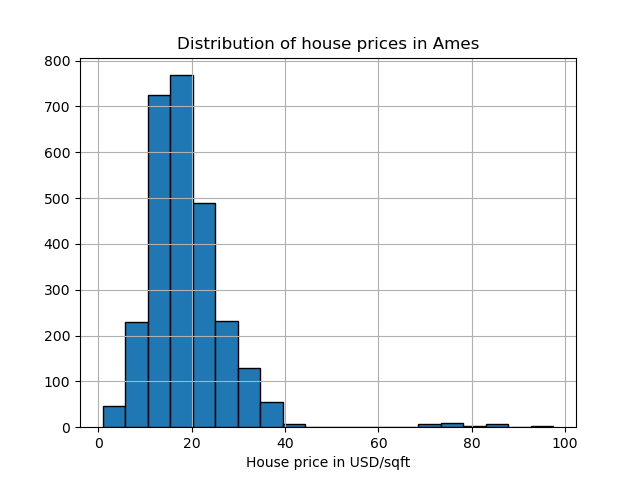

Ames 住房数据集#

Ames 住房数据集最初是一个回归数据集,目标是爱荷华州 Ames 房屋的销售价格。在这里,我们将其转换为异常值检测问题,将每平方英尺价格超过 70 美元的房屋视为异常值。为了简化问题,我们去掉了 40 到 70 美元/平方英尺之间的中间价格。

import matplotlib.pyplot as plt

from sklearn.datasets import fetch_openml

X, y = fetch_openml(name="ames_housing", version=1, return_X_y=True, as_frame=True)

y = y.div(X["Lot_Area"])

# None values in pandas 1.5.1 were mapped to np.nan in pandas 2.0.1

X["Misc_Feature"] = X["Misc_Feature"].cat.add_categories("NoInfo").fillna("NoInfo")

X["Mas_Vnr_Type"] = X["Mas_Vnr_Type"].cat.add_categories("NoInfo").fillna("NoInfo")

X.drop(columns="Lot_Area", inplace=True)

mask = (y < 40) | (y > 70)

X = X.loc[mask]

y = y.loc[mask]

y.hist(bins=20, edgecolor="black")

plt.xlabel("House price in USD/sqft")

_ = plt.title("Distribution of house prices in Ames")

y = (y > 70).astype(np.int32)

n_samples, anomaly_frac = X.shape[0], y.mean()

print(f"{n_samples} datapoints with {y.sum()} anomalies ({anomaly_frac:.02%})")

2714 datapoints with 30 anomalies (1.11%)

该数据集包含 46 个分类特征。在这种情况下,使用make_column_selector来查找它们比手动传递列表更容易。

from sklearn.compose import make_column_selector as selector

categorical_columns_selector = selector(dtype_include="category")

cat_columns = categorical_columns_selector(X)

y_true["ames_housing"] = y

for model_name in model_names:

model = make_estimator(

name=model_name,

categorical_columns=cat_columns,

lof_kw={"n_neighbors": int(n_samples * anomaly_frac)},

iforest_kw={"random_state": 42},

)

y_score[model_name]["ames_housing"] = fit_predict(model, X)

Duration for LOF: 0.81 s

Duration for IForest: 0.23 s

胎心宫缩图数据集#

胎心宫缩图数据集是一个胎心宫缩图的多类数据集,类别是胎心率 (FHR) 模式,用 1 到 10 的标签编码。这里我们将类别 3(少数类别)设置为代表异常值。它包含 30 个数值特征,其中一些是二进制编码的,一些是连续的。

X, y = fetch_openml(name="cardiotocography", version=1, return_X_y=True, as_frame=False)

X_cardiotocography = X # save X for later use

s = y == "3"

y = s.astype(np.int32)

n_samples, anomaly_frac = X.shape[0], y.mean()

print(f"{n_samples} datapoints with {y.sum()} anomalies ({anomaly_frac:.02%})")

2126 datapoints with 53 anomalies (2.49%)

y_true["cardiotocography"] = y

for model_name in model_names:

model = make_estimator(

name=model_name,

lof_kw={"n_neighbors": int(n_samples * anomaly_frac)},

iforest_kw={"random_state": 42},

)

y_score[model_name]["cardiotocography"] = fit_predict(model, X)

Duration for LOF: 0.06 s

Duration for IForest: 0.17 s

绘制并解释结果#

算法性能与真阳性率 (TPR) 在低假阳性率 (FPR) 值下的表现有关。最好的算法在图的左上角有曲线,并且曲线下面积 (AUC) 接近 1。对角虚线表示异常值和正常值的随机分类。

import math

from sklearn.metrics import RocCurveDisplay

cols = 2

pos_label = 0 # mean 0 belongs to positive class

datasets_names = y_true.keys()

rows = math.ceil(len(datasets_names) / cols)

fig, axs = plt.subplots(nrows=rows, ncols=cols, squeeze=False, figsize=(10, rows * 4))

for ax, dataset_name in zip(axs.ravel(), datasets_names):

for model_idx, model_name in enumerate(model_names):

display = RocCurveDisplay.from_predictions(

y_true[dataset_name],

y_score[model_name][dataset_name],

pos_label=pos_label,

name=model_name,

ax=ax,

plot_chance_level=(model_idx == len(model_names) - 1),

chance_level_kw={"linestyle": ":"},

)

ax.set_title(dataset_name)

_ = plt.tight_layout(pad=2.0) # spacing between subplots

我们观察到,一旦邻居数量经过调整,LOF 和 IForest 在 forestcover 和胎心宫缩图数据集上的 ROC AUC 方面表现相似。IForest 在 SA 数据集上的得分略好,而 LOF 在 Ames 住房数据集上的表现明显优于 IForest。

然而,请记住,在样本数量大的数据集上,隔离森林的训练速度往往比 LOF 快得多。LOF 需要计算成对距离来查找最近邻,这相对于观测数量具有二次复杂度。这使得该方法在大型数据集上可能无法使用。

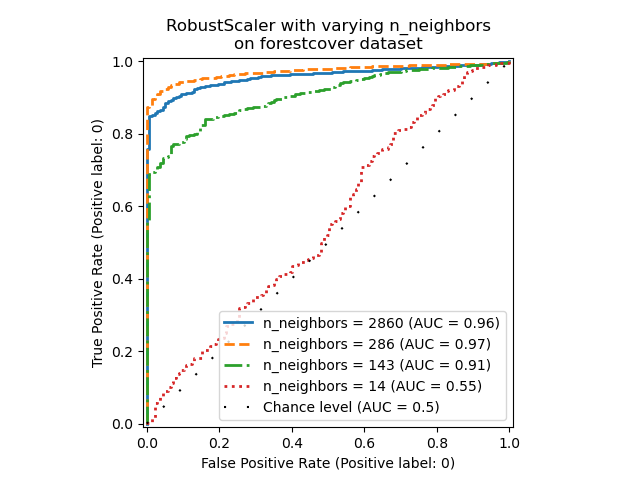

消融研究#

在本节中,我们探讨了超参数 n_neighbors 和数值变量缩放选择对 LOF 模型的影响。这里我们使用森林覆盖类型数据集,因为二进制编码的类别在 0 和 1 之间引入了欧几里得距离的自然尺度。然后我们想要一种缩放方法,以避免赋予非二进制特征特权,并且该方法对异常值足够鲁棒,以便查找它们的任务不会变得过于困难。

X = X_forestcover

y = y_true["forestcover"]

n_samples = X.shape[0]

n_neighbors_list = (n_samples * np.array([0.2, 0.02, 0.01, 0.001])).astype(np.int32)

model = make_pipeline(RobustScaler(), LocalOutlierFactor())

linestyles = ["solid", "dashed", "dashdot", ":", (5, (10, 3))]

fig, ax = plt.subplots()

for model_idx, (linestyle, n_neighbors) in enumerate(zip(linestyles, n_neighbors_list)):

model.set_params(localoutlierfactor__n_neighbors=n_neighbors)

model.fit(X)

y_score = model[-1].negative_outlier_factor_

display = RocCurveDisplay.from_predictions(

y,

y_score,

pos_label=pos_label,

name=f"n_neighbors = {n_neighbors}",

ax=ax,

plot_chance_level=(model_idx == len(n_neighbors_list) - 1),

chance_level_kw={"linestyle": (0, (1, 10))},

curve_kwargs=dict(linestyle=linestyle, linewidth=2),

)

_ = ax.set_title("RobustScaler with varying n_neighbors\non forestcover dataset")

我们观察到邻居数量对模型性能有很大影响。如果能够访问(至少部分)真实标签,那么相应地调整 n_neighbors 就很重要。一种方便的方法是探索与预期污染量级相同的 n_neighbors 值。

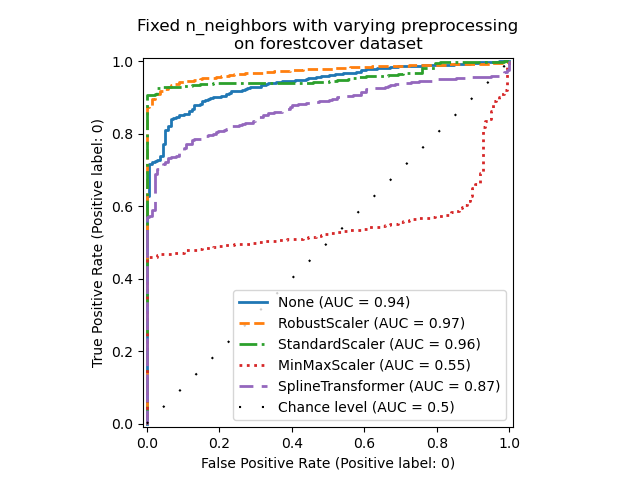

from sklearn.preprocessing import MinMaxScaler, SplineTransformer, StandardScaler

preprocessor_list = [

None,

RobustScaler(),

StandardScaler(),

MinMaxScaler(),

SplineTransformer(),

]

expected_anomaly_fraction = 0.02

lof = LocalOutlierFactor(n_neighbors=int(n_samples * expected_anomaly_fraction))

fig, ax = plt.subplots()

for model_idx, (linestyle, preprocessor) in enumerate(

zip(linestyles, preprocessor_list)

):

model = make_pipeline(preprocessor, lof)

model.fit(X)

y_score = model[-1].negative_outlier_factor_

display = RocCurveDisplay.from_predictions(

y,

y_score,

pos_label=pos_label,

name=str(preprocessor).split("(")[0],

ax=ax,

plot_chance_level=(model_idx == len(preprocessor_list) - 1),

chance_level_kw={"linestyle": (0, (1, 10))},

curve_kwargs=dict(linestyle=linestyle, linewidth=2),

)

_ = ax.set_title("Fixed n_neighbors with varying preprocessing\non forestcover dataset")

一方面,RobustScaler 默认使用四分位距 (IQR) 独立缩放每个特征,IQR 是数据 25% 和 75% 百分位数之间的范围。它通过减去中位数来使数据居中,然后除以 IQR 进行缩放。IQR 对异常值具有鲁棒性:中位数和四分位距受极端值的影响小于范围、均值和标准差。此外,与StandardScaler相反,RobustScaler 不会压缩边缘异常值。

另一方面,MinMaxScaler 独立缩放每个特征,使其范围映射到零和一之间的范围。如果数据中存在异常值,它们可能会使数据偏向最小值或最大值,导致数据分布完全不同,存在较大的边缘异常值:所有非异常值都可能因此几乎完全坍缩在一起。

我们还评估了完全不进行预处理(通过向管道传递 None)、StandardScaler 和 SplineTransformer。有关更多详细信息,请参阅它们各自的文档。

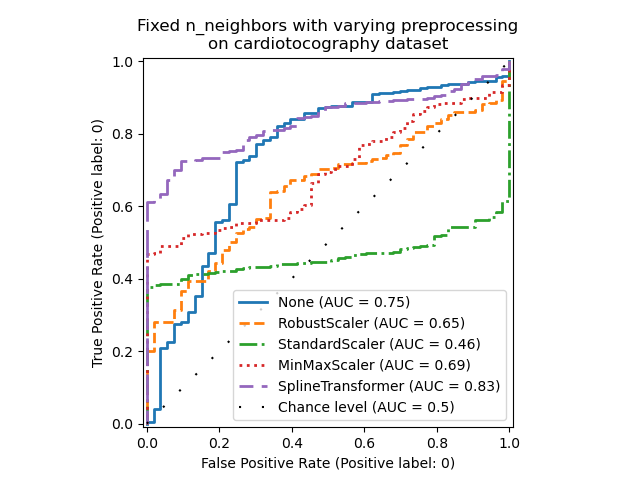

请注意,最佳预处理取决于数据集,如下所示

X = X_cardiotocography

y = y_true["cardiotocography"]

n_samples, expected_anomaly_fraction = X.shape[0], 0.025

lof = LocalOutlierFactor(n_neighbors=int(n_samples * expected_anomaly_fraction))

fig, ax = plt.subplots()

for model_idx, (linestyle, preprocessor) in enumerate(

zip(linestyles, preprocessor_list)

):

model = make_pipeline(preprocessor, lof)

model.fit(X)

y_score = model[-1].negative_outlier_factor_

display = RocCurveDisplay.from_predictions(

y,

y_score,

pos_label=pos_label,

name=str(preprocessor).split("(")[0],

ax=ax,

plot_chance_level=(model_idx == len(preprocessor_list) - 1),

chance_level_kw={"linestyle": (0, (1, 10))},

curve_kwargs=dict(linestyle=linestyle, linewidth=2),

)

ax.set_title(

"Fixed n_neighbors with varying preprocessing\non cardiotocography dataset"

)

plt.show()

脚本总运行时间: (0 分 44.039 秒)

相关示例